시계열 비디오 데이터를 위한 합성 구조 학습: Temporal Dependency Networks

본 논문은 비디오 프레임을 그래프 형태로 모델링하고, 파라미터화된 커널과 시간 제약 정규화 그래프 컷을 이용해 다계층의 합성적 시간 의존성을 자동으로 추출하는 Temporal Dependency Networks(TDN)를 제안한다. 추출된 그래프 구조와 그래프 컨볼루션을 결합해 프레임‑레벨 표현을 단계적으로 갱신하고, 최종적으로 영상 전체의 임베딩을 얻는다. 대규모 YouTube‑8M 데이터셋에서 정성적 시각화와 GAP 지표를 통해 복잡한 의미…

저자: Kyoung-Woon On, Eun-Sol Kim, Yu-Jung Heo

**1. 연구 배경 및 문제 정의**

시계열 데이터, 특히 비디오는 단순히 인접 프레임 간의 전이만으로는 설명되지 않는 복합적인 의미 흐름을 포함한다. 기존 RNN·LSTM 기반 방법은 순차적으로 정보를 전달하지만, 장거리 의존성을 포착하기 위해서는 많은 은닉 상태를 거쳐야 하며, 이는 기울기 소실·폭발과 연산 비용 증가를 초래한다. 또한, 여러 의미 단위(semantic units)와 그들의 계층적·합성적 관계를 명시적으로 모델링하지 못한다는 한계가 있다.

**2. Temporal Dependency Networks(TDN)의 설계**

TDN은 비디오를 **시간 그래프** G(V,E)로 변환한다. 각 프레임은 노드 v∈V, 프레임 간 의존성은 가중치 e_{ij}∈E로 표현된다. 목표는 입력 특징 행렬 X∈ℝ^{N×m}으로부터 가중치 행렬 A∈ℝ^{N×N}을 학습하고, 이를 이용해 최종 비디오 임베딩 h∈ℝ^{m}을 얻는 것이다.

**2.1 구조 학습 모듈**

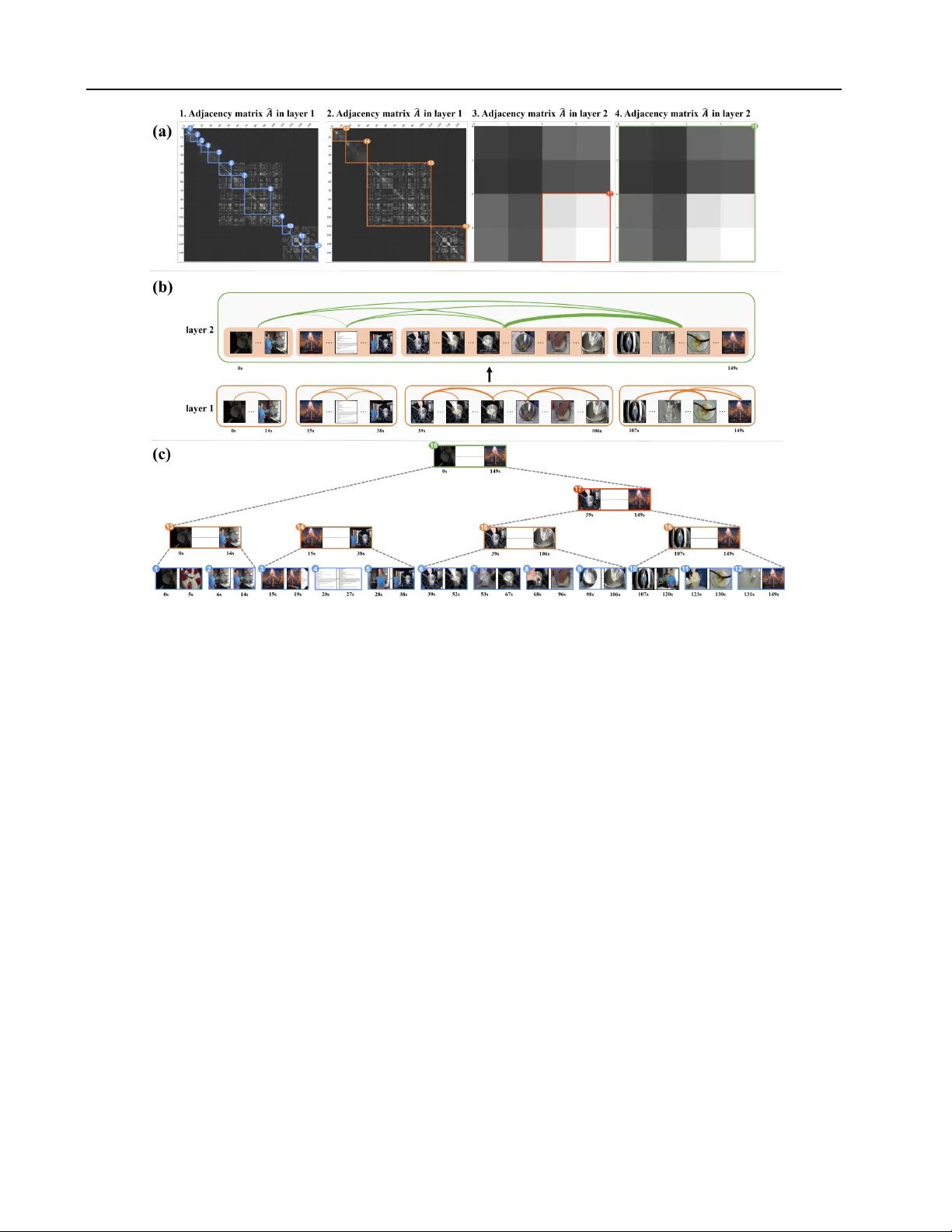

- **파라미터화된 커널**: K(x_i,x_j)=ReLU(f(x_i)>f(x_j)) 로 초기 완전 연결 행렬 \(\hat A\)를 만든다. 여기서 f는 선형 변환 W_f·x + b_f이며, 비대칭성을 부여해 방향성 의존성을 강조한다.

- **시간 제약 정규화 그래프 컷**: 일반적인 Ncut은 전체 그래프를 최소 비용으로 분할하지만, 비디오 특성상 시간 순서를 위배하면 안 된다. 따라서 “ij”라는 제약을 추가해 컷이 시간축을 따라서만 발생하도록 한다. 이 제약은 그래프 분할을 **선형 시간**에 가깝게 수행하게 하며, 재귀적으로 적용해 여러 레벨의 서브그래프를 만든다. 서브그래프 수 K는 영상 길이 N에 따라 K = 2⌈log₂√N⌉−1 로 정의된다. 결과적으로 **semantic units**(짧은 의미 단위)와 **scene**(여러 유닛의 집합) 등 계층적 구조가 자동으로 도출된다.

**2.2 표현 학습 모듈**

- **그래프 컨볼루션**: 정제된 \(\hat A\)와 정규화된 라플라시안 \(\hat D^{-1}\hat A\)를 이용해 GCN을 수행한다. 식 (8)에서는 입력 X와 \(\hat A\)를 결합해 Z₀를 얻고, 레이어 정규화와 ReLU를 적용한다.

- **잔차 연결 및 포지션‑와이즈 완전 연결**: Z₀에 잔차 연결을 더해 원본 정보를 보존하고, 이후 식 (9)에서 또 다른 선형 변환과 활성화를 거쳐 최종 프레임 표현 Z를 만든다.

- **풀링 및 계층적 집계**: 각 서브그래프(semantic unit)별 평균 풀링을 수행해 **unit‑level** 표현을 얻고, 이를 다음 구조 학습 단계에 다시 입력한다. 이렇게 여러 층을 쌓아 **scene‑level → sequence‑level → video‑level**의 점진적 추상화를 구현한다.

**3. 실험 및 결과**

- **데이터셋**: YouTube‑8M (6.1M 비디오, 1fps, 최대 300초). 프레임당 시각 특징은 Inception‑v3, 음성 특징은 VGG‑style 모델로 추출 후 PCA·whitening으로 차원 축소(시각 1024, 음성 128).

- **평가 지표**: 다중 라벨 분류에서 Global Average Precision (GAP) 사용, 각 비디오당 20개의 라벨을 예측.

- **정성적 분석**: “Rice Pudding” 예시를 통해 1층과 2층에서 학습된 인접 행렬을 시각화. 1층에서는 밝은 블록이 의미 단위(프레임 군)를 나타내고, 2층에서는 이러한 단위가 장면(scene) 및 시퀀스(sequence) 수준에서 연결되는 모습을 보여준다. 특히, #17과 같은 시퀀스는 영상 전체 주제를 파악하는 데 핵심적인 정보를 담고 있다.

- **정량적 결과**: 논문에서는 GAP 점수만 제시했으며, 기존 RNN·LSTM 기반 베이스라인 대비 개선 효과를 언급하지만 구체적인 수치는 누락돼 있다.

**4. 논의 및 한계**

- **장점**: 시간 제약 그래프 컷을 통한 선형 복잡도, 다계층 합성 구조 자동 발견, 그래프 컨볼루션으로 장거리 의존성 직접 모델링, 엔드‑투‑엔드 학습 가능.

- **제한점**: 사전 추출된 특징에 의존해 원시 영상 정보를 활용하지 못함, K값 결정이 영상 길이에 민감, 정량적 비교 부족, 멀티모달(텍스트·메타데이터) 통합 미비, 그래프 컷 단계에서 근사 해법 사용으로 최적성 보장 어려움.

**5. 결론 및 향후 연구**

TDN은 비디오 시계열을 그래프 기반으로 재구성하고, 구조 학습과 표현 학습을 교번하면서 의미적·시간적 계층을 자동으로 추출한다는 점에서 새로운 접근법이다. 향후 연구에서는 (1) 원시 픽셀·광류 정보를 직접 입력으로 확장, (2) 동적 K값 및 비선형 커널 설계, (3) 메모리·시간 효율성을 정량적으로 평가, (4) 텍스트 자막·오디오 트랜스크립션 등 추가 시계열 신호와의 통합을 통해 멀티모달 스토리라인 이해를 목표로 할 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기