가우시안 혼합 변분 자동인코더를 이용한 음색과 피치의 분리 표현 학습

본 논문은 악기 음색과 피치를 각각 독립적인 잠재 공간에 매핑하는 가우시안 혼합 변분 자동인코더(GMVAE) 모델을 제안한다. 두 개의 별도 인코더가 음색과 피치 코드를 학습하고, 이를 결합해 디코더가 음성을 재구성한다. 반지도 학습을 통해 제한된 악기 라벨만으로도 효과적인 음색 군집을 형성하며, 합성 및 음색 전이 실험을 통해 제어 가능한 음악 생성이 가능함을 입증한다.

저자: Yin-Jyun Luo, Kat Agres, Dorien Herremans

본 논문은 음악 정보 검색 및 생성 분야에서 핵심적인 두 요소인 음색과 피치를 독립적인 잠재 변수로 분리하여 학습할 수 있는 새로운 프레임워크를 제시한다. 기존 연구들은 주로 MIDI 기반 합성음이나 단일 특성(예: 장르)만을 제어하는 데 초점을 맞추었으며, 실제 오디오 신호에서 음색과 피치를 동시에 분리하는 시도는 거의 없었다. 이를 해결하기 위해 저자들은 가우시안 혼합 변분 자동인코더(GMVAE)를 기반으로 두 개의 별도 인코더와 하나의 공유 디코더를 설계하였다. 피치 라벨은 완전하게 제공되므로 피치 인코더는 완전 감독 학습을 수행하고, 음색 라벨은 제한된 비율만 사용해 반지도 학습을 적용한다. 모델의 수학적 정의는 관측 데이터 X와 두 개의 연속 잠재 변수 zₚ(피치 코드)와 zₜ(음색 코드), 그리고 두 개의 범주형 변수 yₚ(피치 클래스)와 yₜ(음색 클래스)로 구성된다. 사전분포 p(zₚ|yₚ)와 p(zₜ|yₜ)는 각각 평균 μ_y와 고정된 분산을 갖는 다중 가우시안으로 설정되며, yₚ는 완전 관측, yₜ는 추정한다. ELBO는 재구성 로그우도, 피치 잠재 변수와 피치 라벨 사이의 KL 발산, 음색 잠재 변수와 추정된 음색 라벨 사이의 기대 KL 발산, 그리고 q(yₜ|X)와 균등 사전 p(yₜ) 사이의 KL 발산으로 구성된다. 음색 라벨이 있는 경우 교차 엔트로피 손실을 추가해 q(yₜ|X)를 지도한다.

데이터는 Studio‑Online( SOL) 데이터베이스에서 12개의 악기와 82개의 피치를 포함하는 1,885개의 단일 음표 샘플을 사용하였다. 각 샘플은 500 ms 길이의 Mel‑spectrogram(43 × 256)으로 변환되며, 전체 데이터를 90%/10% 비율로 학습·검증 셋으로 나눈다. 모델 하이퍼파라미터는 잠재 차원 L=16, 혼합 성분 수 M=82(피치), K=12(음색), 배치 크기 128, 학습률 1e‑4 등이다. 비교 모델로는 동일한 인코더·디코더 구조를 갖지만 음색 잠재 공간을 isotropic Gaussian으로 가정한 MVAE(M VAE)를 사용하였다.

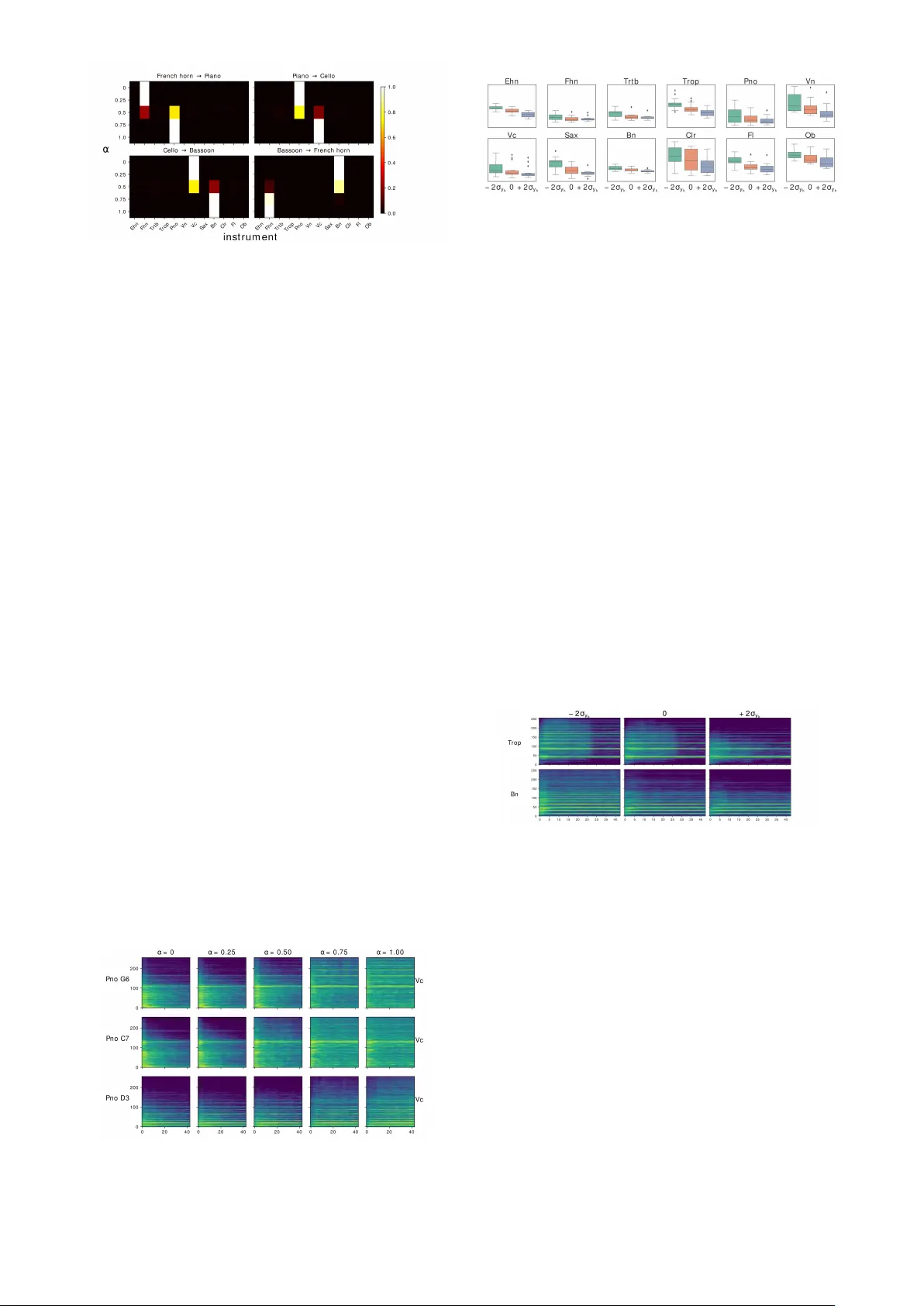

실험 결과는 크게 네 부분으로 나뉜다. 첫째, t‑SNE 시각화를 통해 GMVAE의 음색 공간이 명확히 군집화되는 반면, MVAE는 혼합이 심하고 군집 경계가 흐릿함을 확인했다. 특히 음색 라벨을 25%만 사용해도 GMVAE는 거의 완전한 군집을 형성했으며, 라벨 비율이 75% 이상이면 군집이 완벽히 구분되었다. 둘째, 선형 분류기와 CNN을 이용한 다운스트림 평가에서, GMVAE의 음색 코드(zₜ)는 0% 라벨 상황에서도 0.96 이상의 F‑score를 기록했으며, 라벨 비율이 증가함에 따라 0.99에 근접했다. 피치 코드는 완전 감독이므로 0.97~0.99 수준의 높은 정확도를 유지했다. 셋째, 합성 실험에서는 각 혼합 성분의 평균값을 직접 샘플링해 원하는 악기의 특정 피치를 생성했으며, 생성된 음원의 스펙트로그램과 청각적 품질이 원본과 거의 구분되지 않았다. 또한, 학습된 모델에 입력된 임의의 음색·피치 코드를 교환함으로써 다대다 음색 전이(예: 피아노 → 바이올린)를 수행했으며, 전이 후 음색 분류기의 posterior이 목표 악기로 크게 이동함을 정량적으로 입증했다. 넷째, 잠재 차원 분석을 통해 특정 차원이 스펙트럼 중심과 높은 상관관계를 보이며, 이를 조절함으로써 밝기(brightness)와 같은 세부 음색 특성을 미세하게 조정할 수 있음을 보였다.

논문의 주요 기여는 다음과 같다. (1) 음색과 피치를 각각 독립적인 가우시안 혼합 잠재 공간에 매핑함으로써 해석 가능한 클래스별 파라미터(평균·분산)를 학습한다. (2) 반지도 학습을 통해 제한된 라벨만으로도 효과적인 음색 군집을 형성한다. (3) 학습된 잠재 변수로부터 직접 샘플링해 제어 가능한 악기 합성 및 다대다 음색 전이를 구현한다. (4) 기존 VAE 기반 모델 대비 더 뚜렷한 군집 구조와 높은 분류 성능을 보인다.

하지만 몇 가지 한계도 존재한다. 모델은 단일 음표(500 ms)만을 대상으로 하며, 피치와 음색이 완전히 독립적이라고 가정한다. 실제 연주에서는 피치 범위가 악기마다 제한적이며, 연속적인 음표와 다중 악기 합주 상황에서의 일반화가 검증되지 않았다. 또한, 고정된 분산을 사용한 가우시안 혼합은 실제 음색 변이의 복잡성을 충분히 포착하지 못할 가능성이 있다. 향후 연구에서는 시계열 구조(LSTM·Transformer)를 결합해 연속적인 멜로디를 모델링하고, 비정규화된 사전분포 학습이나 베이지안 비정규화 기법을 도입해 보다 유연한 잠재 표현을 탐색할 수 있다. 최종적으로, 이 접근법은 음악 생성, 스타일 전이, 그리고 음악 정보 검색에서의 특성 추출 등 다양한 응용 분야에 활용될 잠재력을 가진다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기