공정한 순위 학습을 위한 정책 기반 접근

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

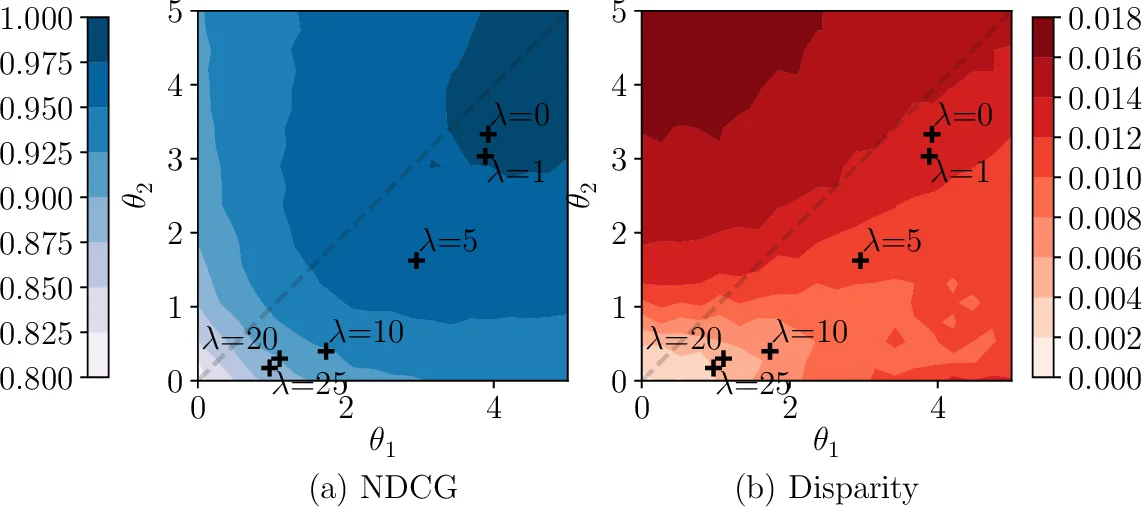

본 논문은 전통적인 학습‑순위(LTR) 방법이 사용자 효용만을 최적화하고 아이템에 미치는 영향을 무시한다는 문제를 지적한다. 이를 해결하기 위해 노출 공정성 제약을 포함한 확률적 순위 정책을 학습하는 프레임워크와, 정책‑그라디언트 기반 알고리즘 Fair‑PG‑Rank를 제안한다. 실험을 통해 개인·그룹 공정성 모두를 만족시키면서 NDCG 등 기존 효용 지표도 유지함을 보인다.

상세 분석

이 논문은 “공정성”을 순위 시스템에서 핵심 자원인 노출(exposure)의 배분 문제로 재정의한다. 기존 LTR은 사용자 만족을 위한 NDCG·DCG와 같은 순위 지표만을 최적화했으며, 아이템이 받는 노출량은 암묵적으로 결정돼 불공정한 결과를 초래한다. 저자들은 이를 해결하기 위해 순위 함수를 확률적 정책 π∈Π 로 확장한다. 정책 π(r|q)는 질의 q에 대해 모든 가능한 순열 r에 확률을 할당하며, 기대 노출 vπ(di)=E_{r∼π}

댓글 및 학술 토론

Loading comments...

의견 남기기