스펙트로그램 특징 손실을 이용한 음악 소스 분리

초록

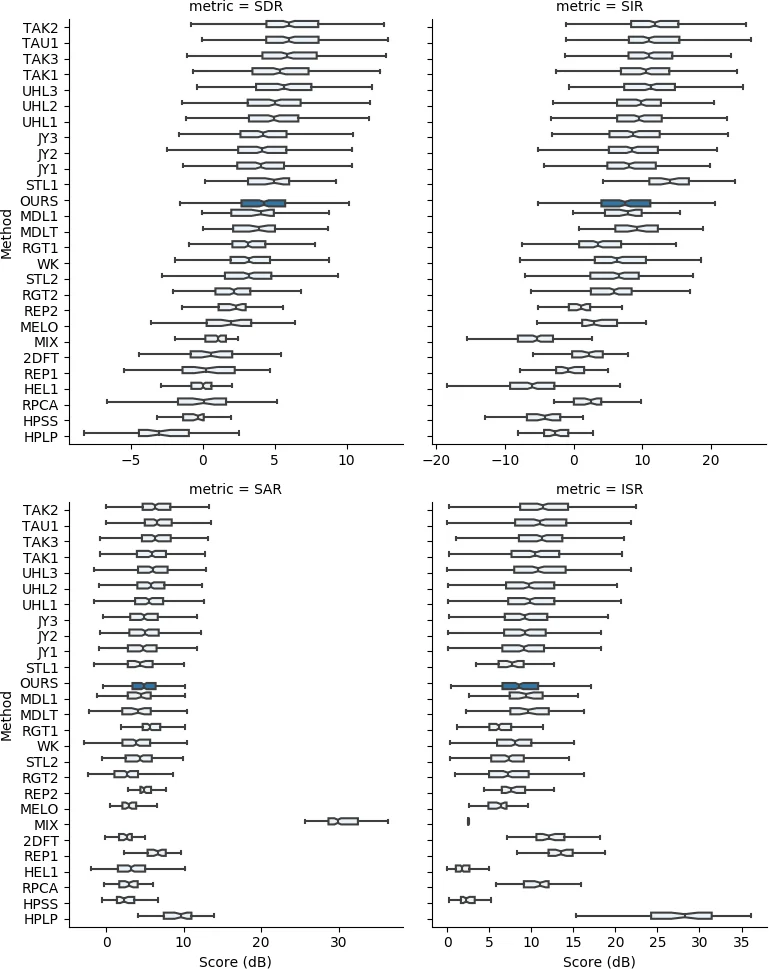

본 논문은 기존의 픽셀‑레벨 L2 손실 대신 VGG 네트워크로 추출한 고수준 스펙트로그램 특징 손실을 결합한 복합 손실을 사용하여 MMDenseNet 기반 음악 소스 분리 성능을 향상시켰음을 보인다. musdb18 데이터셋의 보컬, 드럼, 베이스 3가지 소스에 대해 실험했으며, 통계적으로 유의미한 SDR 향상을 확인하였다.

상세 분석

이 연구는 음악 소스 분리 분야에서 손실 함수 설계가 성능에 미치는 영향을 정량적으로 분석한다는 점에서 의미가 크다. 기존의 대부분 방법은 스펙트로그램을 이미지처럼 취급하고 각 시간‑주파수 셀(픽셀) 간 L2 차이를 최소화하는 픽셀‑레벨 손실을 사용한다. 그러나 이러한 손실은 스펙트로그램의 구조적 패턴, 예를 들어 드럼의 수직선형 에너지 분포나 보컬의 수평적 하모닉 라인과 같은 고수준 특징을 반영하지 못한다. 논문은 이러한 한계를 보완하기 위해 이미지 분야에서 널리 사용되는 VGG 기반 퍼셉추얼 손실을 차용한다. 구체적으로 VGG‑19의 여러 층에서 추출한 피처 맵을 이용해 ‘피처 손실’과 ‘스타일 손실’ 두 가지를 계산하고, 이를 픽셀‑레벨 L2 손실과 각각 0.25씩 가중치를 두어 합산한다. 이렇게 구성된 복합 손실은 저주파‑고주파 대역별로 별도 DenseNet 서브밴드를 사용하는 MMDenseNet 구조와 자연스럽게 결합된다.

실험 설계는 매우 체계적이다. 먼저 musdb18 데이터셋을 100곡 학습, 50곡 테스트로 나누어 기본 MMDenseNet 모델을 구현하고, 동일한 하이퍼파라미터(FFT 길이 2048, hop 1024, RMSProp 등) 하에서 픽셀‑레벨 손실만 사용한 모델과 복합 손실을 적용한 모델을 각각 4번씩 독립 실행한다. 이는 GPU 병렬 처리에 따른 난수성을 최소화하고, 결과의 통계적 유의성을 검증하기 위한 t‑test를 수행하기 위함이다.

결과는 보컬, 드럼, 베이스 각각에 대해 SDR(신호‑왜곡 비율) 향상이 관측되었다. 보컬에서는 평균 0.27 dB, 드럼에서는 0.24 dB, 베이스에서는 0.18 dB 정도의 개선을 보였으며, 특히 보컬과 드럼에서는 5% 유의수준 이하의 p‑value를 기록해 통계적으로 유의함을 입증했다. 또한, 단일 채널(스테레오 평균) 입력에서도 복합 손실이 동일하게 효과적임을 확인했다.

이 논문의 한계점도 명확히 제시한다. VGG는 이미지 전용 네트워크이므로 오디오 특성에 최적화된 피처 추출기로서의 적합성이 떨어진다. 저자는 향후 오디오 전용 CNN 혹은 변형된 VGG를 구축해 손실 함수를 더욱 정교화할 필요성을 강조한다. 또한 데이터 증강, LSTM 결합, 소스별 맞춤 서브밴드 설계 등 기존 최첨단 모델이 적용한 추가 기법들을 도입하지 않아 절대적인 성능 차이는 제한적이다.

전반적으로 이 연구는 손실 함수 차원에서 음악 소스 분리 성능을 끌어올릴 수 있음을 실증적으로 보여주며, 퍼셉추얼 손실을 오디오 분야에 적용하는 초기 시도로서 향후 연구 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기