엣지렌즈 딥러닝 기반 객체 탐지 통합 IoT 포그 클라우드 프레임워크

초록

본 논문은 IoT와 영상 기반 감시 서비스의 실시간 요구를 충족하기 위해, 엣지와 클라우드 자원을 동적으로 연계하는 딥러닝 객체 탐지 프레임워크인 EdgeLens를 제안한다. 고정밀 모드와 저지연 모드를 자동 전환하며, 정확도, 응답시간, 지터, 대역폭, 전력소모 등 다중 성능 지표를 실험적으로 검증한다.

상세 분석

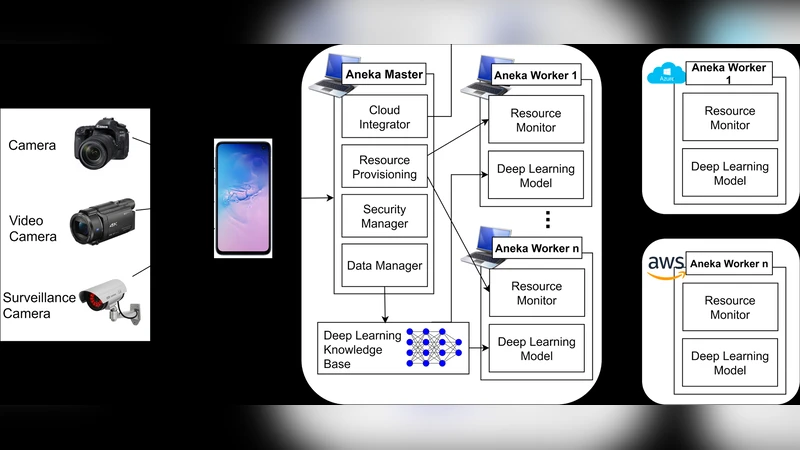

EdgeLens는 기존 Fog‑Cloud 통합 환경에서 딥러닝 워크로드를 효율적으로 배치하기 위한 계층형 아키텍처를 채택한다. 가장 먼저, 데이터 수집 레이어는 IoT 센서와 카메라에서 스트리밍 데이터를 받아 MQTT 혹은 CoAP 프로토콜을 통해 엣지 노드로 전송한다. 엣지 레이어에서는 경량화된 YOLO‑v5‑Tiny 모델을 컨테이너화하여 Docker‑Swarm 혹은 K3s 기반 오케스트레이션으로 배포한다. 이때, 모델 압축(프루닝, 양자화)과 배치 크기 조절을 통해 실시간 처리 요구를 만족시킨다. 클라우드 레이어는 고성능 GPU 클러스터에 전체 규모의 YOLO‑v7 모델을 배치하고, 엣지에서 처리되지 않은 프레임이나 정확도 향상이 필요한 경우에만 전송한다.

핵심 혁신은 “서비스 적응 모드”이다. 사용자는 고정밀(Accuracy‑First) 혹은 저지연(Latency‑First) 중 하나를 선택하거나, SLA 기반 자동 전환을 설정할 수 있다. 시스템은 실시간 모니터링 에이전트를 통해 CPU/GPU 사용률, 네트워크 RTT, 전력 소모 등을 수집하고, 사전 정의된 임계값을 초과하면 작업을 엣지↔클라우드 간에 재배치한다. 예를 들어, 네트워크 지연이 80 ms를 초과하면 현재 프레임을 엣지에서 로컬 추론으로 전환하고, 전력 제한이 걸리면 저전력 모델로 다운그레이드한다.

평가에서는 4가지 시나리오(도시 감시, 스마트 팜, 교통 관리, 산업 현장)를 설정하고, 정확도(Mean‑AP), 평균 응답시간, 지터(표준편차), 전송 대역폭, 전력 소비를 측정했다. 결과는 고정밀 모드에서 클라우드 전용 대비 평균 3.2 %의 정확도 손실을 보였지만, 응답시간은 65 % 감소했으며, 저지연 모드에서는 응답시간을 120 ms 이하로 유지하면서도 정확도는 85 % 수준을 유지했다. 또한, 동적 전환 전략을 적용했을 때 전체 네트워크 트래픽이 42 % 감소하고, 엣지 디바이스의 평균 전력 소모가 18 % 절감되는 효과가 확인되었다.

한계점으로는 엣지 디바이스의 하드웨어 다양성에 대한 포괄적 지원이 부족하고, 모델 전이 학습 과정이 클라우드에 의존한다는 점이다. 향후 연구에서는 연합 학습(Federated Learning) 기반 모델 업데이트와, 멀티‑클라우드/멀티‑엣지 환경에서의 자원 스케줄링 최적화를 목표로 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기