멜스펙트로그램 기반 GAN‑Excited Linear Prediction으로 빠르고 고품질 음성 합성

본 논문은 멜‑스펙트로그램을 직접 입력으로 사용하는 병렬 신경 보코더인 GELP를 제안한다. GAN 기반 생성기와 비인과식 LP 합성 필터를 결합해, 기존 WaveNet 대비 10배 이상 빠른 추론 속도와 복사‑합성에서 더 높은 MOS를 달성한다.

저자: Lauri Juvela, Bajibabu Bollepalli, Junichi Yamagishi

본 논문은 최근 텍스트‑투‑스피치(TTS) 시스템에서 널리 사용되는 멜‑스펙트로그램을 직접 입력으로 하는 병렬 신경 보코더를 설계하고, 이를 GAN‑Excited Linear Prediction(GELP)이라 명명한다. 기존의 WaveNet과 같은 자기회귀형 보코더는 높은 음질을 제공하지만, 샘플 단위 순차 추론으로 인해 실시간 응용에 한계가 있다. 반면, 흐름 기반(parallel flow) 모델은 병렬 추론이 가능하지만 복잡한 역변환과 대규모 파라미터가 필요해 학습이 어려운 단점이 있다. GELP는 이러한 문제점을 해결하기 위해 세 가지 핵심 아이디어를 결합한다.

첫째, 멜‑스펙트로그램으로부터 전통적인 선형 예측(LP) 전형을 직접 복원한다. 멜‑스펙트로그램 m은 로그 스펙트럼 형태이며, 필터뱅크 M의 의사역행렬을 이용해 원래의 선형 스펙트럼 X˜를 근사한다. 이후 IFFT와 Levinson‑Durbin 절차를 통해 각 프레임별 LP 계수 a_k를 얻는다. 이 계수는 최소 위상 특성을 가지므로, FFT를 통해 전형 A_k를 구하고, 위상은 부호 반전, 크기는 작은 ε로 바닥을 두어 H_k를 만든다. 이렇게 만든 전형 필터는 STFT 도메인에서 곱셈으로 적용되며, 역 STFT를 통해 시간 도메인 파형을 복원한다.

둘째, GAN 기반 생성기를 도입한다. 화이트 노이즈 z를 입력으로 하는 생성기 G는 조건부 모델 C가 제공하는 멜‑스펙트로그램 임베딩 c와 결합해, LP 잔차(Excitation) ˆe를 생성한다. 이 잔차는 위에서 만든 LP 필터에 통과해 최종 파형 ˆx가 된다. 판별기 D는 실제 파형 x와 합성 파형 ˆx를 구분하도록 학습되며, Wasserstein GAN 손실에 gradient penalty(L_GP)와 R1 정규화(L_R1)를 추가해 학습 안정성을 확보한다.

셋째, 두 종류의 손실을 동시에 최적화한다. STFT magnitude 기반 MSE 손실 L_STFT은 스펙트럼 에너지와 조화 구조를 정확히 재현하도록 유도하고, GAN 손실 L_GAN은 위상 및 미세한 시간‑도메인 디테일을 학습한다. 전체 목표는 λ1·L_STFT − L_GAN을 최소화하는 것이며, λ1은 두 손실의 스케일을 맞추기 위해 10으로 설정하였다.

네트워크 구조는 비인과식 1‑D dilated residual block을 사용한다. G와 C는 zero‑padding을 통해 입력·출력 길이를 동일하게 유지하고, D는 residual 연결 없이 receptive field를 점진적으로 축소한다. 각 블록은 gated activation(tanh·σ)과 skip connection을 포함하며, 최종 출력은 skip 연결을 채널‑와이즈로 합쳐 affine projection을 거쳐 생성된다. 모델 파라미터는 G와 D 모두 64개의 residual·skip 채널, 필터 폭 5, dilated stack 3(또는 2) 등으로 경량화되었다.

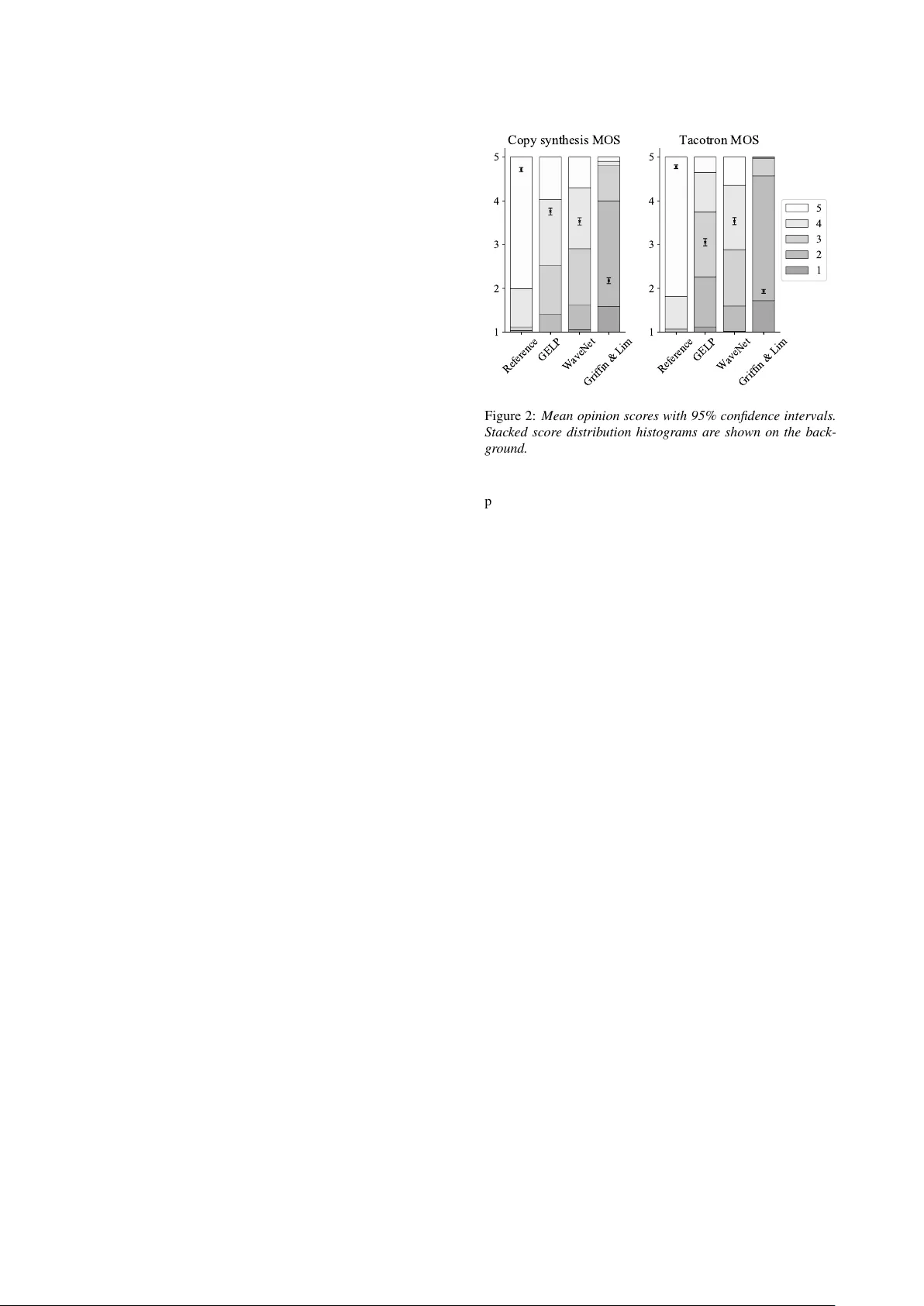

실험은 Blizzard Challenge 2011 “Nancy” 데이터(16 h 45 m, 16 kHz)에서 수행되었다. 데이터는 1 초 길이 세그먼트로 나누어 1 M iteration(≈15 epoch) 동안 학습했으며, 초기 200 k iteration에서는 잔차 도메인에서 사전 학습(pre‑training)하여 조화 성분이 빠르게 나타나도록 했다. 학습 후, 복사‑합성(copy‑synthesis) 테스트에서 MOS 4.34(±0.07)를 기록, 동일 조건의 WaveNet(≈4.10)보다 우수했다. Tacotron‑1 기반 TTS 파이프라인에 적용했을 때도 품질 저하 없이 실시간 추론이 가능했으며, GPU에서 0.5 ms/step(실시간 200배) 정도의 속도를 보였다.

또한, 멜‑스펙트로그램을 직접 사용함으로써 별도의 피치·보이싱 입력이 필요 없으며, LP 필터가 자동으로 음성의 주파수 구조를 복원한다는 점에서 기존 GAN‑excited 모델(피치‑동기화 필요)보다 구현이 간단하고 견고하다. STFT magnitude 손실만으로는 위상 정보를 충분히 학습하기 어려운 점을 판별기의 adversarial loss가 보완한다는 점도 중요한 설계 포인트다.

결론적으로, GELP는 (1) 멜‑스펙트로그램만으로 전통적인 source‑filter 구조를 재현, (2) GAN을 이용해 위상 및 미세 디테일을 학습, (3) 완전 병렬화된 파이프라인을 제공해 실시간 TTS에 적합한 경량 모델을 구현한다는 세 가지 주요 기여를 한다. 향후 다중 화자, 다국어 보코더 확장 및 저전력 디바이스 적용 가능성을 열어주며, 고품질·고속 음성 합성 분야에 새로운 방향을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기