연결성 최적화 표현 학습을 위한 영속 동형론

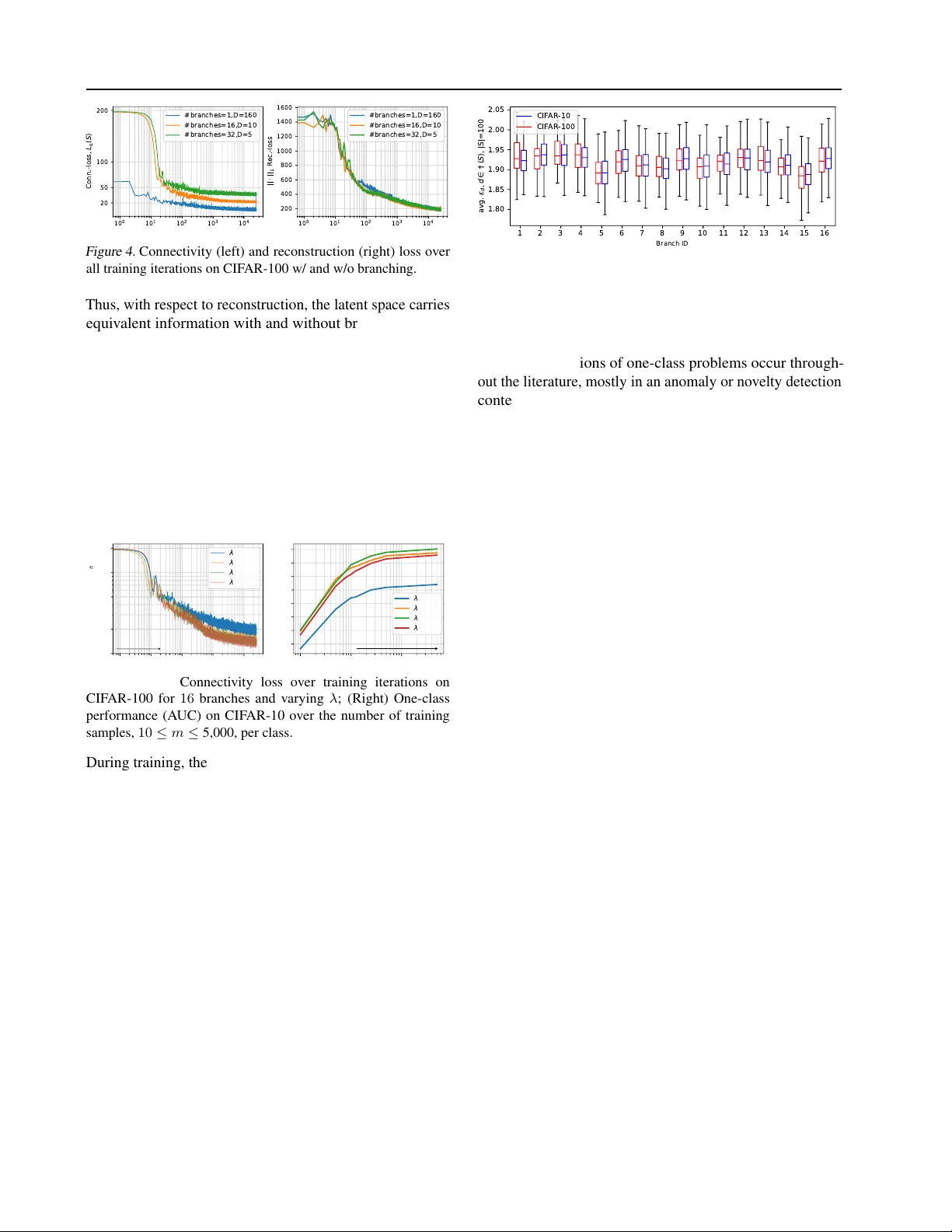

본 논문은 자동인코더의 잠재공간에 연결성을 강제하는 새로운 손실함수인 “연결성 손실”을 제안한다. 영속 동형론(persistent homology)으로부터 얻은 0‑차 바코드를 이용해 배치 내 점들의 병합 시점을 균일하게 만들며, 이 손실은 미분 가능성을 보장한다. 이를 통해 저차원 잠재표현을 얻고, 커널 밀도 추정 기반의 원클래스 학습에 적용해 적은 샘플에서도 기존 방법을 크게 앞선 성능을 기록한다.

저자: Christoph Hofer, Rol, Kwitt

본 논문은 **표현 학습**에서 잠재공간의 **연결성**을 직접 제어함으로써, 상위 작업인 **원클래스 학습**에 유리한 구조를 만들고자 한다. 저자들은 먼저 자동인코더(AE)의 기본 구조를 소개하고, 기존 연구들이 재구성 손실 외에 **희소성, 잡음 저항성, 변분 정규화** 등을 통해 잠재공간에 다양한 제약을 가해 왔음을 정리한다. 그러나 이러한 제약은 주로 **분포** 혹은 **정규화** 수준에 머물러, **연결성**이라는 위상적 특성을 직접 다루지는 못한다는 점을 지적한다.

이를 해결하기 위해 **영속 동형론(persistent homology)**을 도입한다. 데이터 포인트 집합 S 에 대해 Vietoris‑Rips 복합체를 반경 r 에 따라 확장하면서, 0‑차 호몰로지(연결 성분)의 사망 시점(merge events)을 기록한다. 이 사망 시점들의 집합 †(S) 을 바코드 형태로 추출하고, 모든 사망 시점이 목표값 η 에 가깝도록 하는 **연결성 손실** L_η 을 정의한다. 수식적으로는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기