딥러닝 기반 확장 심도 영상으로 말라리아 진단 효율 극대화

초록

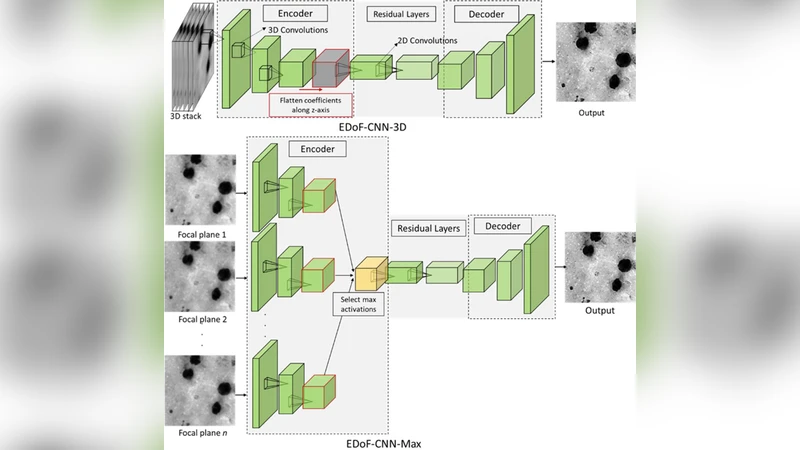

본 논문은 두꺼운 혈액 필름의 다중 초점 이미지(z‑stack)를 빠르게 융합해 확장 심도(EDoF) 영상을 생성하고, 동시에 공간 해상도를 향상시키는 CNN 모델(EDoF‑CNN)을 제안한다. 3D‑컨볼루션 기반과 최대값 선택 기반 두 가지 아키텍처를 설계하고, 저해상도·큰 z‑step·픽셀 이진화·저배율 시뮬레이션 환경에서 기존 웨이브렛 기반 방법과 비교하였다. SSIM, Dice, 말라리아 기생충 검출 정확도 및 연산 시간에서 모두 우수한 성능을 보이며, 특히 저배율(40×)에서도 높은 검출 재현율을 달성한다.

상세 분석

이 연구는 말라리아 진단에 필수적인 두꺼운 혈액 필름의 미세 구조를 관찰하기 위해 고배율(100×, NA 1.4) 오일 렌즈를 사용하지만, 얕은 심도 때문에 다수의 초점면을 촬영해야 하는 문제를 해결하고자 한다. 기존의 다중 스케일 웨이브렛(MSD) 기반 EDoF는 연산량이 많아 고처리량 현장에 부적합하였다. 저자들은 이를 대체하기 위해 두 가지 CNN 기반 아키텍처를 설계하였다. 첫 번째인 EDoF‑CNN‑3D는 입력 z‑stack을 3차원 볼륨으로 취급해 3D 컨볼루션을 적용하고, 이후 평균 풀링을 통해 차원을 축소한다. 두 번째인 EDoF‑CNN‑Max는 각 초점면을 개별적으로 인코더에 통과시킨 뒤, 활성값의 최대값을 선택해 잔차 블록에 전달한다. 두 모델 모두 인코더‑디코더 구조에 9개의 Residual 레이어를 삽입해 깊은 특징 학습을 가능하게 하였으며, 최종 tanh 활성화를 통해 정규화된 출력 영상을 얻는다.

학습 데이터는 100× 고해상도 현미경으로 촬영한 14개의 초점면을 갖는 z‑stack을 기반으로, 낮은 해상도 시나리오(큰 z‑step, 4×4 픽셀 이진화, 40× 저배율) 를 인위적으로 생성해 준비하였다. 목표는 시뮬레이션된 저해상도 스택을 입력으로 받아, 고해상도 웨이브렛 기반 EDoF 영상을 ‘그라운드 트루스’로 삼아 회귀 손실(MSE)로 학습하는 것이었다. 총 3900개의 FOV를 사용해 512×512 픽셀 크기의 이미지로 학습하였다.

평가에서는 SSIM, Dice 계수, 그리고 별도 학습된 말라리아 기생충 검출 CNN(R‑FCN)의 재현율·정밀도를 활용하였다. 결과는 3·5개의 초점면을 사용했을 때, SSIM이 기존 웨이브렛 방식(0.74‑0.77)보다 0.77‑0.81까지 상승했으며, Dice 점수도 0.56‑0.66에서 0.60‑0.66으로 개선되었다. 특히 4×4 픽셀 이진화와 40× 저배율 시뮬레이션에서 Dice 점수가 0.58→0.66, 0.48→0.66으로 크게 향상되었다. 기생충 검출 재현율은 40× 저배율·5초점면 조건에서 38 %에서 73 %로 상승했으며, 이는 100× 고배율과 거의 동등한 수준이다. 연산 시간 측면에서도 GPU 기반 CNN은 MATLAB CPU 구현 웨이브렛 대비 3배~11배 빠르게 100개의 스택을 처리하였다.

이러한 결과는 CNN이 단순히 초점면을 융합하는 것을 넘어, 저해상도·저배율 영상에서도 미세한 기생충 형태를 복원하고, 실시간 혹은 준실시간 수준의 처리 속도를 제공함을 보여준다. 다만 현재는 흑백 이미지와 시뮬레이션된 저해상도에 한정되었으며, 실제 저배율 현미경에서 발생하는 색상 왜곡·노이즈 등에 대한 검증이 필요하다. 향후 컬러 영상 적용, 실제 저배율 현미경 데이터 수집, 그리고 현장용 모바일/임베디드 디바이스에 최적화된 경량 모델 개발이 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기