CT 이미지 합성 방법 평가 아틀라스 기반 등록부터 딥러닝까지

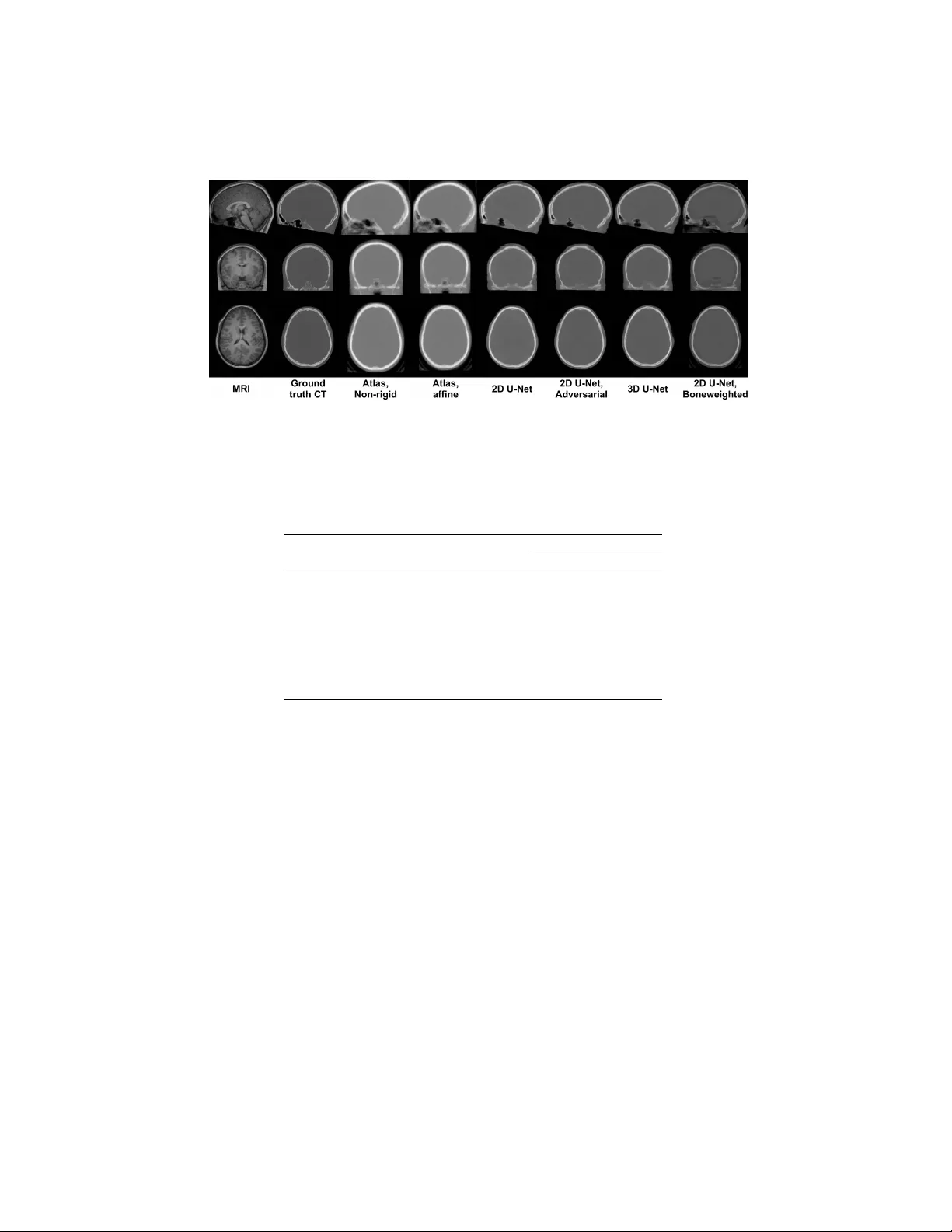

본 논문은 동일 피험자의 MRI로부터 실제 CT와 유사한 합성 CT를 생성하는 네 가지 방법을 비교한다. 기존의 다중 아틀라스 기반 등록, 2‑D·3‑D U‑Net 회귀, 조건부 GAN, 그리고 아틀라스 결과를 사전 정보로 활용한 잔차 학습 프레임워크를 제안한다. 30명의 소아 피험자 데이터를 이용해 PSNR, MAE, SSIM, PCC 및 골분할 Dice 점수를 평가했으며, 딥러닝 기반 방법이 전통적 등록보다 전반적으로 우수하지만, 골 영역에…

저자: Andreas D. Lauritzen, Xenophon Papademetris, Sergei Turovets

본 논문은 전산화 단층 촬영(CT)과 자기공명영상(MRI) 사이의 상호 보완적 정보를 활용해, 방사선 피폭 없이도 정확한 골 구조를 제공할 수 있는 합성 CT 생성 방법을 체계적으로 비교·평가한다. 연구 배경으로는 EEG와 같은 뇌 전기활동 모델링에서 CT가 제공하는 골 밀도와 위치 정보가 필수적이며, CT 촬영이 이온화 방사선을 동반해 특히 소아에게 위험이 크다는 점을 들었다. 따라서 MRI만으로 CT와 동등한 정보를 복원하는 이미지 합성 기술이 임상적 가치를 가진다.

연구에서는 30명의 소아 피험자(6개월~16년)에서 획득한 3D T1‑가중 MRI와 대응 CT 쌍을 사용했다. 모든 영상은 MNI Colin‑27 템플릿에 1 mm³ 등방성 해상도로 정규화하고, MRI는 뇌 내부 평균·표준편차로 정규화하였다. 아틀라스는 성인 3명·소아 2명으로 구성된 5쌍을 사용했으며, 각각의 MRI‑CT와 골·뇌·연부 조직 마스크를 포함한다.

네 가지 합성 방법을 제안한다.

1) **다중 아틀라스 기반 합성**: 표면 매칭을 이용해 각 아틀라스의 뇌 표면을 대상 MRI의 뇌 표면에 정합하고, 변환된 CT를 평균화한다. 정합은 affine와 non‑rigid(Fixed‑Form Deformation, 30 mm B‑spline) 두 단계로 수행한다.

2) **U‑Net 회귀**: 23‑layer 변형 U‑Net을 사용해 MRI→CT 매핑을 회귀 문제로 정의한다. L2 손실과 이미지 그라디언트 차이 손실(GDL)을 결합해 고주파 정보를 보존한다. 학습은 2‑D(128×128)와 3‑D(48×48×24) 패치를 각각 6‑fold 교차 검증으로 진행했으며, ADAM optimizer(learning rate = 1e‑4)로 650 epoch 학습한다.

3) **조건부 GAN(cGAN)**: 생성기로 동일한 U‑Net을 사용하고, 판별기로 최소제곱형 CNN을 두어 실제 CT와 합성 CT를 구분하도록 학습한다. 전체 손실은 회귀 손실(L2+GDL)과 adversarial loss를 합산한다.

4) **아틀라스 사전 잔차 학습**: 첫 단계에서 다중 아틀라스 합성(S_atlas)를 구하고, 이를 DNN이 예측하는 잔차(S_DNN)와 가중합한다. 가중치는 골 마스크를 Gaussian‑smooth한 후 선형 변환(W = α·W_bone + β)으로 정의해, 골 영역에 높은 비중을 부여한다.

평가 지표는 전체 머리와 골 전용 마스크 두 영역에 대해 PSNR, MAE, MSSIM, Pearson Correlation Coefficient(PCC)를 계산하고, 골 마스크의 Dice coefficient를 추가로 측정한다. 골 마스크는 k‑means(1024 bins)로 3‑클래스(공기, 골, 연부 조직)로 분할한다.

**실험 결과**

- 전체 머리 영역에서는 2‑D U‑Net이 가장 높은 PSNR(28.01 ± 2.04 dB)과 SSIM(0.951 ± 0.023)을 기록했으며, 3‑D U‑Net과 2‑D adversarial U‑Net도 비슷한 수준을 보였다.

- 골 전용 마스크에서는 딥러닝 모델이 전반적으로 높은 PSNR(≈41.5 dB)과 낮은 MAE(≈41 HU)를 달성했지만, Dice 점수는 0.90 ~ 0.91 수준에 머물렀다.

- 아틀라스 기반 비강체(affine)와 비강체(non‑rigid) 방법은 PSNR이 25.8~26 dB, MAE가 25.8~26 HU로 낮은 성능을 보였지만, 골 마스크 Dice가 0.90에 가까워 골 형태를 비교적 잘 보존한다.

- **아틀라스 사전 잔차 학습**(bone‑weighted U‑Net)은 골 마스크 Dice가 0.91 ± 0.03으로 가장 높은 점수를 얻었으며, PSNR도 27.38 dB(전체)와 38.8 dB(골)로 중간 수준이지만, 골 영역에서의 정밀도가 가장 뛰어나다.

이러한 결과는 딥러닝이 전반적인 영상 재현에서는 우수하지만, 골과 같이 고대비·고밀도 영역에서는 해부학적 사전 정보가 결합될 때 최적의 성능을 낸다는 점을 시사한다. 또한, 2‑D 패치 기반 학습이 3‑D보다 약간 높은 PSNR을 보였으며, 이는 메모리 제한과 데이터 증강 효율성 때문으로 해석된다.

**논문의 의의와 한계**

- 기존 연구에서 주로 2‑D 혹은 3‑D 단일 딥러닝 모델만을 평가했으나, 본 연구는 아틀라스 기반 전통 방법과 최신 GAN, 그리고 두 접근법을 결합한 새로운 프레임워크까지 포괄적으로 비교함으로써 실용적 선택지를 제공한다.

- 데이터셋이 30명으로 제한적이며, 주로 소아 환자에 국한돼 있어 성인 혹은 다양한 병변을 포함한 일반화 연구가 필요하다.

- 골 마스크 분할에 k‑means를 사용했는데, 이는 임계값에 민감하고 CT 스케일이 맞지 않을 경우 오류가 발생할 수 있다. 향후에는 학습 기반 골 분할 모델을 도입하면 더 정확한 정량화가 가능할 것이다.

**향후 연구 방향**

1) 더 큰 코호트와 다기관 데이터를 활용해 모델의 일반화 성능을 검증한다.

2) 멀티모달 합성(PET‑CT, MR‑PET 등) 및 다시간점(Time‑Series) 데이터를 포함해 동적 변화를 추정한다.

3) 아틀라스 사전의 가중치 학습을 자동화하고, 비선형 결합(예: attention 메커니즘)으로 잔차 학습을 확장한다.

4) 임상 적용을 위해 실시간 추론 속도와 메모리 효율성을 최적화하고, 합성 CT를 이용한 실제 EEG 헤드 모델링 및 방사선 치료 계획에 대한 효과를 검증한다.

결론적으로, 본 논문은 MRI‑CT 합성 분야에서 전통적인 이미지 등록과 최신 딥러닝 기술을 비교·통합한 포괄적 벤치마크를 제공하며, 특히 골 구조 복원에 있어 아틀라스 기반 사전이 딥러닝과 결합될 때 최상의 성능을 달성한다는 중요한 인사이트를 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기