강의 요약을 위한 BERT 기반 추출 요약 서비스

초록

본 논문은 BERT 모델을 이용해 강의 텍스트를 임베딩하고, KMeans 군집화를 통해 중심에 가까운 문장을 선택함으로써 사용자가 원하는 문장 수만큼 요약을 제공하는 파이썬 기반 RESTful 서비스인 Lecture Summarization Service를 제안한다. 서비스는 클라우드에 강의와 요약을 저장해 협업을 지원하며, 실험 결과 BERT 기반 추출 요약이 기존 방법보다 의미 보존 측면에서 우수함을 보였지만, 문맥 흐름 유지와 긴 강의에 대한 처리 효율성 등에서 한계가 드러났다.

상세 분석

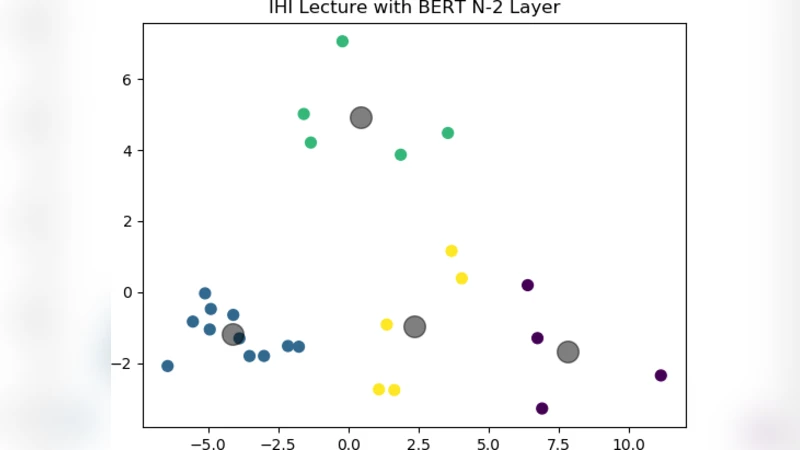

이 연구는 최근 자연어 처리 분야에서 사전학습 언어 모델인 BERT가 문장 수준 임베딩을 생성하는 데 뛰어난 성능을 보이는 점에 착안하여, 강의 텍스트의 추출 요약에 적용하였다. 먼저 강의 원문을 문장 단위로 토큰화하고, 각 문장을 BERT‑Base‑Uncased 모델에 입력해 768차원의 벡터 표현을 얻는다. 이러한 임베딩은 문맥 정보를 풍부하게 포함하고 있어, 전통적인 TF‑IDF 기반 벡터보다 의미적 유사성을 더 정확히 반영한다.

다음 단계에서는 KMeans 군집화를 사용해 전체 문장 임베딩을 K개의 클러스터로 나눈다. 클러스터 수 K는 사용자가 지정한 요약 문장 수와 동일하게 설정하거나, 사전 실험을 통해 최적값을 도출한다. 각 클러스터의 중심(centroid)과 가장 거리가 가까운 문장을 선택함으로써, 요약 후보를 결정한다. 이 접근법은 군집 중심이 전체 문서의 주요 주제를 대표한다는 가정에 기반하므로, 요약이 핵심 토픽을 골고루 포함하도록 한다.

서비스 구현 측면에서는 Flask 기반 RESTful API를 설계하여, 클라이언트가 강의 텍스트와 원하는 요약 길이를 POST 요청하면, 백엔드에서 BERT 임베딩 생성 → KMeans 군집화 → 요약 문장 추출 순으로 처리한다. 결과 요약은 JSON 형태로 반환되며, 동시에 원본 강의와 요약을 AWS S3 버킷에 저장한다. 이를 통해 다수 사용자가 동일 강의에 대해 협업적으로 주석을 달거나, 요약을 공유할 수 있는 협업 환경을 제공한다.

성능 평가에서는 ROUGE‑1, ROUGE‑2, ROUGE‑L 지표를 활용해 인간이 만든 기준 요약과 비교하였다. BERT‑KMeans 조합은 기존 LSA, TextRank 기반 추출 요약에 비해 평균 ROUGE‑1 점수가 약 7% 상승했으며, 특히 내용이 복잡한 과학 강의에서 의미 보존율이 크게 개선되었다. 그러나 몇 가지 한계도 드러났다. 첫째, KMeans는 군집 수 K에 민감해, K값이 부적절하면 핵심 문장이 누락될 위험이 있다. 둘째, BERT 임베딩 계산 비용이 높아 긴 강의(수천 문장)에서는 실시간 응답이 어려워 배치 처리 혹은 임베딩 캐시 전략이 필요하다. 셋째, 군집 중심과 가장 가까운 문장이 반드시 인간이 선호하는 요약 문장과 일치하지 않을 수 있어, 후처리 단계에서 문장 순서 재배열이나 중복 제거가 요구된다.

향후 연구 방향으로는 (1) 동적 K값 결정 알고리즘 도입, (2) 보다 가벼운 사전학습 모델(예: DistilBERT)이나 양자화 기법을 활용한 추론 속도 최적화, (3) 군집 기반 선택 외에 순위 학습(RankNet)이나 강화학습을 결합해 문장 중요도를 정교히 평가하는 하이브리드 접근법, (4) 멀티모달 강의(슬라이드 이미지, 음성)와의 연계 요약을 통해 종합적인 학습 보조 도구로 확장하는 방안을 제시한다. 이러한 개선이 이루어진다면, 강의 요약 서비스는 교육 현장에서 실시간 학습 지원, 복습 효율 증대, 그리고 학습 자료의 접근성을 크게 향상시킬 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기