머신이 만든 패치와 개발자 패치의 차이는 얼마나 클까

초록

본 연구는 Defects4J 벤치마크에서 최신 자동 프로그램 복구(APR) 기법이 생성한 177개의 정답 패치를 분석한다. 머신이 만든 정답 패치가 개발자가 제공한 패치와 문법적으로 다를 수 있음을 25.4% 비율로 확인했으며, 프로젝트·기법별 분포 차이와 버그 특성(패치 규모)과의 연관성을 제시한다. 이를 통해 패치 정확성 평가 시 “개발자와 동일한 수정 방식”을 강제할 필요가 없으며, 평가 기준 설계에 새로운 시사점을 제공한다.

상세 분석

이 논문은 자동 프로그램 복구(Automated Program Repair, APR) 분야에서 가장 논란이 되는 문제 중 하나인 ‘패치 정확성 평가’를 재조명한다. 기존에 널리 사용되던 두 가지 평가 방법, 즉 인간 전문가의 주관적 검토와 자동 생성 테스트를 통한 검증은 각각 편향성과 낮은 정밀도라는 한계를 가지고 있다. 저자들은 이러한 한계를 보완하고자, Defects4J 데이터셋에 대해 최신 APR 기법들이 생성한 정답 패치를 체계적으로 수집·검증하였다. 먼저 문헌조사를 통해 보고된 정답 패치를 모두 모은 뒤, 177개의 패치를 선정하기 위해 ‘sanity check’ 과정을 거쳤다. 여기에는 패치가 실제 버그를 해결하고, 동일한 테스트 스위트를 통과하는지 확인하는 절차가 포함된다.

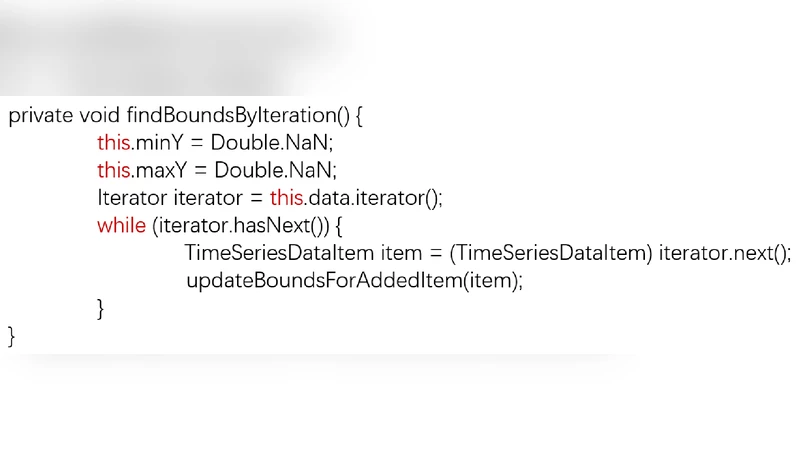

핵심 분석은 세 가지 축으로 전개된다. 첫째, 머신이 만든 정답 패치와 개발자가 제공한 패치 사이의 문법적 차이를 조사했다. 결과는 45개(25.4%)가 완전히 다른 코드 구조를 가지고 있음을 보여준다. 이는 “버그를 정확히 같은 방식으로 고쳐야 한다”는 기존의 가정이 과도하게 제한적임을 의미한다. 둘째, 프로젝트와 APR 기법별로 정답 패치의 분포가 어떻게 달라지는지를 살폈다. 일부 프로젝트에서는 특정 기법이 높은 정답률을 보였지만, 다른 프로젝트에서는 전혀 다른 기법이 우수한 성과를 냈다. 이는 버그 유형·프로젝트 특성이 APR 기법 선택에 큰 영향을 미친다는 점을 시사한다. 셋째, 버그의 특성, 특히 패치 크기와 복잡도가 정답 패치의 형태에 미치는 영향을 분석했다. 버그가 큰 경우(패치 라인 수가 많을수록) APR 기법이 개발자와 다른 접근법을 선택할 확률이 높았다. 이는 자동화된 도구가 인간이 선호하는 “간결하고 직관적인” 수정보다, 테스트 통과에 초점을 맞춘 보다 복합적인 변형을 시도하기 때문으로 해석된다.

연구 결과는 기존 연구와 일치하는 부분도 많다. 예를 들어, APR 기법이 종종 ‘overfitting’된 패치를 생성한다는 비판이 있었지만, 이 논문은 실제로 많은 정답 패치가 개발자와 다른 방식으로 버그를 해결하면서도 테스트를 성공적으로 통과한다는 점을 강조한다. 따라서 패치 정확성 평가 시, “동일한 코드 변경”을 기준으로 삼는 대신, “동일한 기능적 동등성”을 검증하는 방향으로 평가 프레임워크를 재구성할 필요가 있다.

마지막으로, 저자들은 향후 연구를 위한 실용적인 가이드라인을 제시한다. 첫째, 정답 패치의 다양성을 인정하고, 다양한 변형을 허용하는 평가 메트릭을 설계해야 한다. 둘째, 프로젝트·버그 특성을 고려한 맞춤형 APR 기법 선택이 필요하며, 이를 위해 메타데이터 기반의 사전 분석이 유용할 것이다. 셋째, 자동 생성 테스트의 품질을 높이기 위해, 정적 분석·동적 탐색을 결합한 하이브리드 테스트 생성 기법을 도입하는 것이 바람직하다. 이러한 제언은 APR 커뮤니티가 보다 실용적이고 신뢰할 수 있는 패치 평가 체계를 구축하는 데 기여할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기