동적 계층형 변분 네트워크로 구현한 다채로운 음성 합성

CHiVE는 언어 구조를 반영한 동적 계층형 조건부 변분 오토인코더로, 문장 수준의 프로소디 임베딩을 학습한다. 이를 통해 F0·에너지·길이와 같은 프로소디 특징을 다양하게 샘플링하거나, 한 문장의 프로소디를 다른 문장에 전이시켜 자연스러운 억양 변화를 구현한다. 계층별 RNN을 동적으로 클럭하고, 변분 레이어에서 다변량 가우시안 공간을 형성함으로써 비계층적 베이스라인보다 우수한 성능을 보인다.

저자: Vincent Wan, Chun-an Chan, Tom Kenter

본 논문은 현재 텍스트‑투‑스피치(TTS) 시스템이 텍스트와 프로소디 사이에 일대일 매핑을 가정함으로써 억양이 평균화되고 다양성이 결여되는 문제를 해결하고자 한다. 이를 위해 저자들은 CHiVE(Clockwork Hierarchical Variational auto‑Encoder)라는 새로운 모델을 제안한다. CHiVE는 언어적 입력을 단어, 음절, 음소, 프레임 수준의 계층적 구조로 표현하고, 각각에 맞는 RNN을 동적으로 클럭하여 입력 시퀀스의 구조적 특성을 그대로 반영한다. 인코더는 프레임‑레이트와 폰‑레이트 RNN을 병렬로 실행해 각 음절 경계에서 은닉 상태를 출력하고, 이 두 출력을 음절‑레이트 RNN과 결합해 최종 은닉 벡터를 만든다. 이 은닉 벡터는 완전 연결층을 거쳐 평균 μ와 분산 σ를 추정하는 변분 레이어에 전달되며, 여기서 다변량 정규분포 N(μ,σ)에서 샘플 s를 뽑는다. 이 s는 문장 수준의 프로소디 임베딩으로, 디코더에 전달되어 동일한 언어적 특징과 결합된다. 디코더는 문장‑레벨에서 시작해 음절‑레벨, 폰‑레벨, 프레임‑레이트 RNN을 차례로 거치며, 각 레벨에서 s와 언어적 특징을 조건으로 하여 F0, c0(에너지) 및 duration을 재구성한다. 손실 함수는 프레임‑레벨 F0·c0와 폰‑레벨 duration에 대한 L2 손실과 변분 레이어의 KL 발산을 가중합한 형태이며, λ 파라미터로 각 손실 항목의 비중을 조절한다.

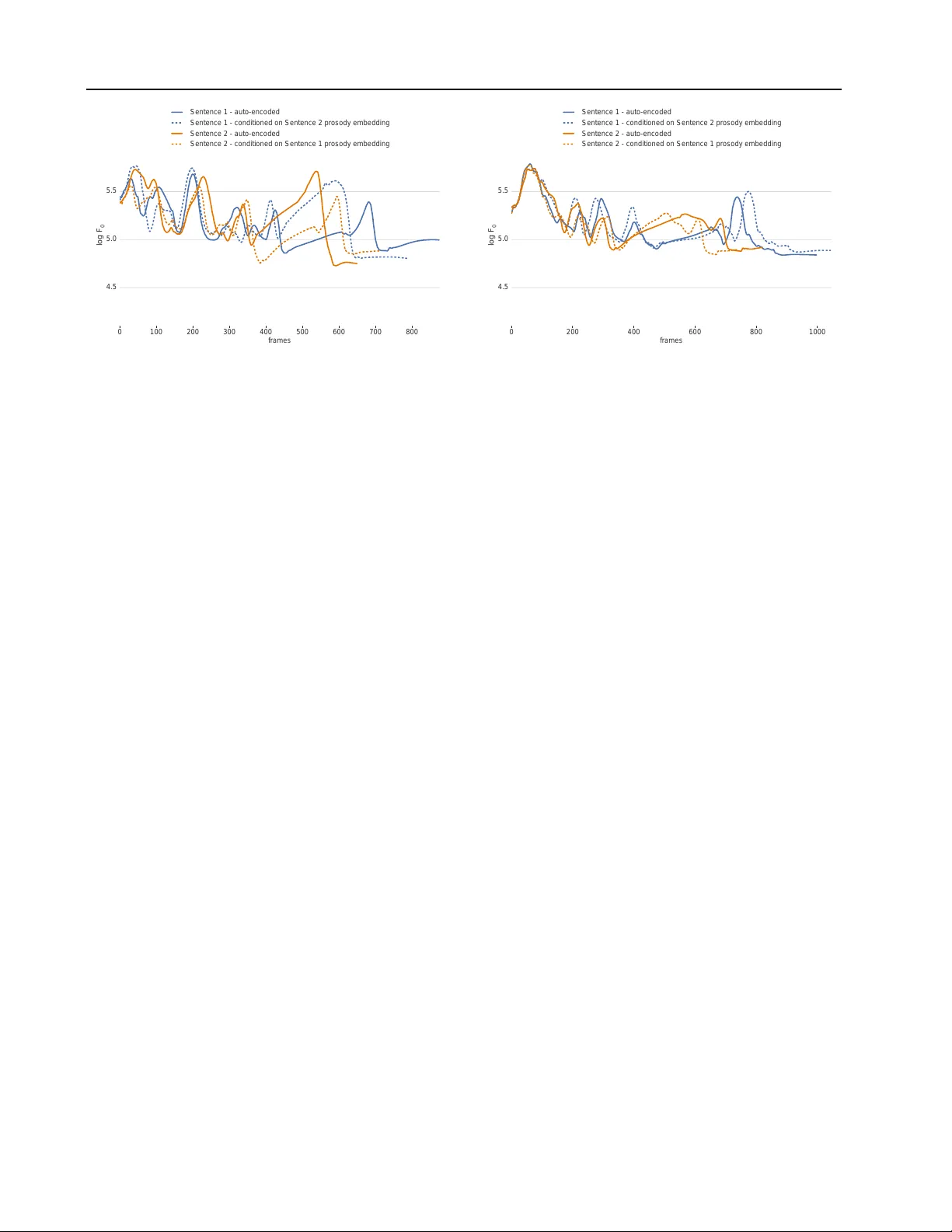

학습 과정에서는 인코더‑디코더가 입력 프로소디를 정확히 복원하도록 학습하면서, 변분 레이어는 프로소디의 다양성을 포괄하는 잠재 공간을 형성한다. 추론 시 두 가지 시나리오가 가능하다. 첫 번째는 인코더를 사용하지 않고, 사전 학습된 정규분포에서 임의의 s를 샘플링하거나 평균(제로) 벡터를 사용해 평균적인 억양을 생성하는 방법이다. 두 번째는 다른 문장의 s를 이용해 프로소디 전이를 수행하는 방법으로, 목표 문장의 언어적 내용은 유지하면서 참조 문장의 억양을 그대로 적용할 수 있다.

실험에서는 비계층적 최신 베이스라인과 비교하여 CHiVE가 L2 오차와 MOS(Mean Opinion Score)에서 모두 우수한 결과를 보였다. 특히, 프로소디 전이 실험에서 청취자는 원문장의 억양 특성이 목표 문장에 정확히 전달된 것을 인지했으며, 스타일 토큰 기반 방법보다 더 직관적이고 세밀한 억양 제어가 가능함을 확인하였다. 또한, 동적 클럭 메커니즘이 입력 문장의 길이와 구조에 따라 RNN이 적절히 재설정되도록 함으로써, 고정 클럭 모델이 겪는 정보 손실을 최소화한다는 점도 강조된다.

결론적으로, CHiVE는 언어적 계층 구조와 변분 학습을 결합해 프로소디의 다변성을 효과적으로 모델링하고, 샘플링 기반 억양 다양성 및 프로소디 전이 기능을 제공한다. 이는 향후 자연스러운 멀티‑스피커 TTS, 감정 표현 및 사용자 맞춤형 음성 합성 등에 활용될 수 있는 강력한 기반 기술로 평가된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기