병원 규모 흉부 영상 데이터로 학습한 특징이 결핵 검출에 미치는 효과

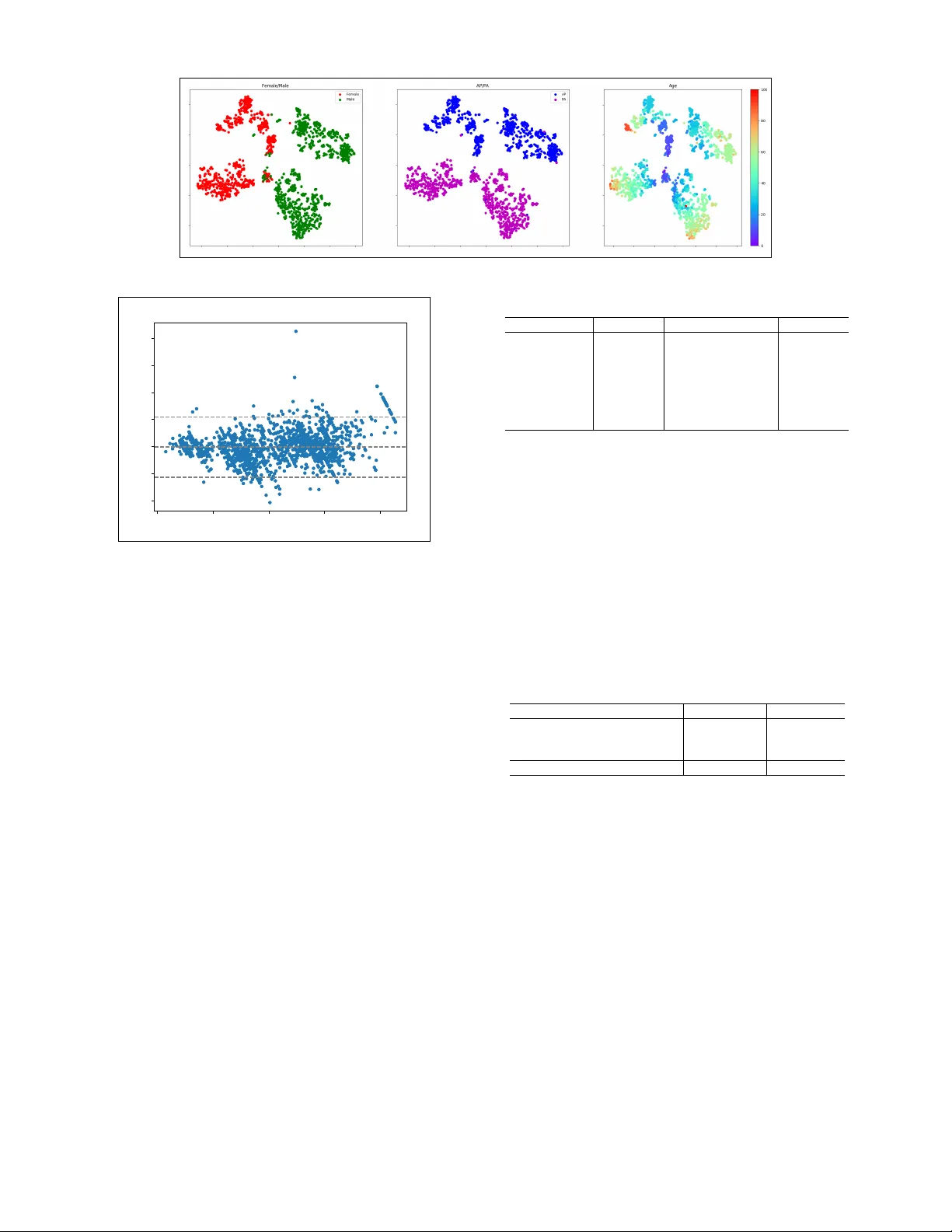

본 연구는 NIH ChestXray14 데이터(112 천 장)를 이용해 DenseNet‑121 기반의 MetaChexNet을 학습하고, 이를 소규모 결핵 데이터셋에 전이함으로써 ImageNet 사전학습 대비 높은 AUC와 일반화 능력을 달성했음을 보여준다. 또한 환자 연령·성별·촬영 자세와 같은 메타데이터를 함께 학습시켜 연령 추정 오차 4.3 년, 성별·자세 분류 정확도 99 % 이상을 기록하였다.

저자: Ophir Gozes, Hayit Greenspan

본 논문은 흉부 X‑ray 영상 분석에 특화된 특징 학습이 기존 ImageNet 사전학습 모델보다 소규모 결핵 검출 작업에서 뛰어난 성능과 일반화 능력을 제공한다는 가설을 검증한다. 연구는 두 단계(Phase I, Phase II)로 구성된다.

Phase I에서는 NIH가 제공한 ChestXray14 데이터셋(112 천 장, 14가지 병변 라벨)과 함께 환자 메타데이터(연령, 성별, 촬영 자세)를 활용한다. 기본 구조는 DenseNet‑121이며, ChexNet에서 사용된 14‑차원 병변 출력에 메타데이터를 위한 2개의 이진 출력과 연령 회귀를 위한 1개의 연속 출력이 추가된 MetaChexNet을 설계한다. 손실은 병변·메타데이터에 대해 각각 바이너리 교차 엔트로피와 평균 절대 오차를 결합한다. 학습은 Nadam 옵티마이저와 1 e‑3 초기 학습률, 배치 크기 32로 진행하며, 검증 손실이 정체될 경우 학습률을 10배 감소시키는 스케줄을 적용한다. 이미지 전처리는 224×224 리사이즈, 3채널 복제, ImageNet 평균·표준편차 정규화이며, 연령은

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기