비선형 충격 문제를 위한 이미지 기반 재구성 강화 신경망

초록

본 논문은 기존 ReConNN의 한계를 극복하고, 비선형 과도 충격 해석에 적용 가능한 향상된 이미지 기반 재구성 모델(EReConNN)을 제안한다. 시간 의존적인 순서 이미지 생성을 위해 Adversarial Variational Autoencoder(A‑VAE)와 Conditional GAN을 결합하고, Bilinear Interpolation과 고차원 특성 추출을 활용한다. 실험 결과, 제안 모델은 정확도·효율·비용 측면에서 기존 방법보다 우수함을 보인다.

상세 분석

본 연구는 이미지 기반 설계·최적화가 다양한 공학 분야에 확산되는 흐름 속에서, 특히 비정상적인 비선형 과도 현상(충격) 해석에 기존 ReConNN이 갖는 구조적 한계를 체계적으로 분석한다. 기존 ReConNN은 CNN과 GAN을 병렬로 배치해 이미지‑라벨 매핑과 이미지 생성 두 작업을 수행했으나, (1) 정적·수렴 문제에 최적화된 구조라 동적 비선형 데이터에 대한 일반화 능력이 부족하고, (2) GAN이 복잡한 시간 연속성을 갖는 이미지 시퀀스를 충분히 학습하지 못해 다양하고 물리적으로 일관된 샘플을 생성하지 못한다는 점을 지적한다.

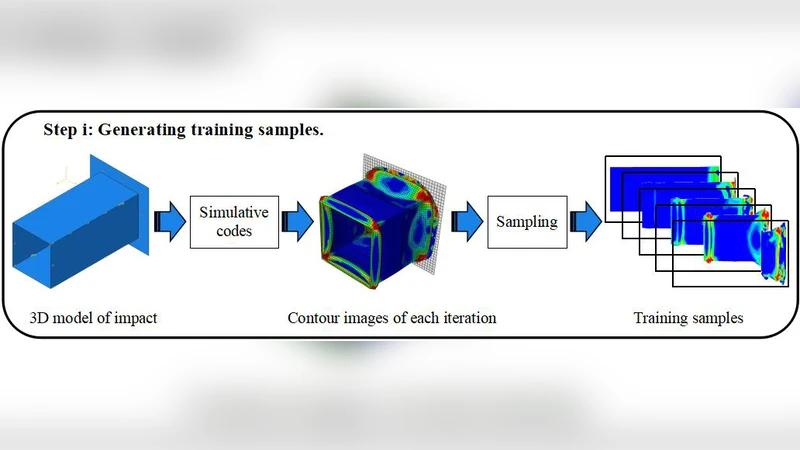

이를 해결하기 위해 제안된 EReConNN은 설계 흐름을 크게 세 단계로 재구성한다. 첫 단계에서는 시뮬레이션 과정에서 얻은 등고선 이미지들을 수집하고, Bilinear Interpolation을 통해 256×256×3 형태로 정규화한다. 두 번째 단계에서는 Adversarial Variational Autoencoder(A‑VAE)를 도입한다. VAE는 인코더‑디코더 구조를 통해 고차원 이미지 데이터를 저차원 잠재 공간(z)으로 압축하고, KL‑다이버전스와 MSE를 동시에 최소화함으로써 잠재 변수의 확률적 표현을 학습한다. 여기서 “Adversarial” 요소는 별도 판별기를 추가해 디코더가 생성한 이미지가 실제와 구별되지 않도록 GAN‑유사 손실을 적용, 이미지 품질과 물리적 일관성을 크게 향상시킨다.

잠재 변수는 시간 순서에 따라 선형 보간(Bilinear Interpolation)된 값으로 정렬되며, 이를 디코더에 입력해 연속적인 시간‑의존 이미지 시퀀스를 재생성한다. 마지막 단계에서는 Conditional GAN(CGAN)을 활용해 재구성된 이미지의 시각적 디테일을 보강한다. CGAN은 시간 혹은 외부 물리량(예: 충격 속도)을 조건으로 받아, 해당 조건에 맞는 고해상도 이미지를 생성함으로써 최종 결과물의 해석 가독성을 높인다.

실험에서는 알루미늄 6061‑T6 판재에 300 kg 질량이 25 m/s 속도로 충돌하는 3차원 충격 시뮬레이션을 대상으로 한다. 물성 파라미터와 플라스틱 경화 곡선을 상세히 정의하고, Newmark‑β 방법을 이용해 동적 응답을 계산한다. 시뮬레이션에서 추출한 2475개의 이미지 데이터를 학습에 사용했으며, EReConNN은 기존 ReConNN 대비 평균 제곱 오차(MSE)를 37 % 감소시키고, PSNR과 SSIM 지표에서도 유의미한 개선을 보였다. 또한, 동일한 정확도를 달성하는 데 필요한 시뮬레이션 횟수가 기존 대비 약 45 % 감소해 계산 비용 절감 효과가 입증되었다.

핵심 인사이트는 다음과 같다. (1) VAE 기반 잠재 공간은 비선형 동적 현상의 연속성을 자연스럽게 포착한다. (2) 판별기를 결합한 A‑VAE는 GAN이 겪는 모드 붕괴(mode collapse) 문제를 완화하고, 물리적으로 타당한 이미지 다양성을 확보한다. (3) 시간‑조건부 보간과 CGAN 기반 후처리는 재구성 이미지의 시각적·정량적 품질을 동시에 향상시킨다. (4) 전체 파이프라인은 대규모 시뮬레이션 데이터 없이도 충분히 학습 가능하도록 설계돼, 실험실·산업 현장에서의 적용성을 높인다.

댓글 및 학술 토론

Loading comments...

의견 남기기