정적 입력 RNN에서 시간 역전파와 동등한 평형 전파 업데이트

초록

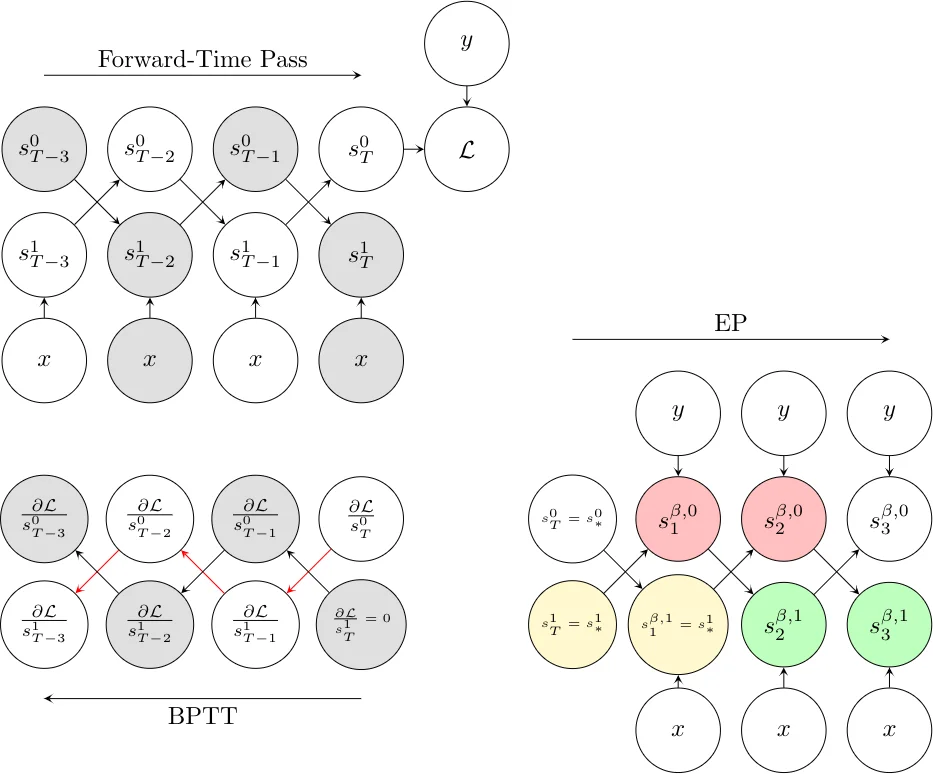

이 논문은 정적 입력을 받는 수렴형 RNN에 대해 연속 시간 대신 이산 시간 형태의 평형 전파(Equilibrium Propagation, EP)를 제안하고, 특정 조건 하에서 EP의 단계별 가중치·활성 업데이트가 역전파를 통한 시간 역전파(BPTT)와 정확히 일치함을 이론·실험적으로 증명한다. 또한 EP를 활용한 합성곱 신경망을 MNIST에 적용해 약 1%의 테스트 오류를 달성, EP가 실제 머신러닝 과제에서도 BPTT와 동등한 성능을 낼 수 있음을 보여준다.

상세 분석

본 연구는 먼저 수렴형 RNN을 정의하고, 전통적인 BPTT와 비교했을 때 EP가 어떻게 역전파와 동일한 기울기를 제공하는지를 수학적으로 증명한다. 핵심은 전이 함수 F가 어떤 원시 함수 Φ의 편미분 형태, 즉 F(x,s,θ)=∂Φ/∂s 로 표현될 수 있을 때이다. 이 경우 시스템은 에너지 기반 동역학으로 해석될 수 있으며, 첫 번째(예측) 단계에서 정적 입력 x에 대해 고정점 s에 도달한다. 두 번째(학습) 단계에서는 손실 ℓ에 대한 외부 힘 β∂ℓ/∂s 를 추가해 시스템을 미세하게 변형시키고, 이때 발생하는 상태 변화 Δs와 파라미터 변화 Δθ 를 β 로 나누어 정의한다. 논문은 β→0 한계에서 Δθ가 손실에 대한 정확한 기울기 -∂L/∂θ 로 수렴함을 보이며, 더 나아가 각 시간 단계 t에 대해 ΔEP_s(t) = -∇_BPTT s(t), ΔEP_θ(t) = -∇_BPTT θ(t) 가 성립함을 정리 1(Gradient‑Descending Updates, GDU)로 제시한다. 이 정리는 고정점이 충분히 오래 유지되고, 전이 함수가 원시 함수에서 유도된 경우에 엄격히 성립한다.

실험에서는 두 가지 설정을 검증한다. 첫 번째는 Φ를 명시적으로 정의한 에너지 기반 모델로, 연속 시간 EP의 오일러 근사와 동일한 이산화 형태를 사용한다. 두 번째는 전형적인 비선형 활성화 σ를 갖는 단순 RNN (s_{t+1}=σ(W·s_t)) 로, 원시 함수가 없지만 Φ≈½ sᵀWs 로 근사할 수 있기에 GDU 특성이 근사적으로 유지된다. 다양한 깊이(13 은닉층)와 완전 연결, 합성곱 구조에 대해 RMSE(ΔEP, -∇BPTT)를 측정했으며, 에너지 기반 설정에서는 10⁻² 수준, 전형적 설정에서도 가중치 업데이트에 대해서는 10⁻²10⁻¹ 수준의 일치도를 보였다. 특히 합성곱 아키텍처에서는 MNIST 실험에서 EP가 BPTT와 거의 동일한 학습 곡선을 나타내며, 테스트 오류 1% 수준을 달성했다. 이는 기존 EP 연구에서 보고된 최고 성능을 넘어서는 결과이며, EP가 실제 대규모 딥러닝 모델에도 적용 가능함을 시사한다.

또한 논문은 EP의 두 단계(예측·학습)에서 필요한 반복 횟수를 기존 실시간 EP 대비 3~5배 감소시켜 시뮬레이션 비용을 크게 절감한다. 이는 β와 T, K 같은 하이퍼파라미터를 적절히 튜닝함으로써 가능했으며, 실험적으로도 성능 저하 없이 빠른 수렴을 확인했다. 전체적으로 이 연구는 EP와 BPTT 사이의 수학적 동등성을 명확히 밝히고, EP를 실용적인 머신러닝 도구로 전환하기 위한 구체적 설계 원칙과 구현 방법을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기