전립선 슬라이드 이미지 분류와 병변 위치 탐지를 위한 주의 기반 다중해상도 모델

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

본 논문은 전립선 조직 슬라이드 전체를 대상으로, 슬라이드 수준 라벨만으로 학습하는 두 단계 주의 기반 다중인스턴스 학습(MIL) 프레임워크를 제안한다. 5배 배율에서 암·비암을 구분하고, 주의 맵과 인스턴스 특징을 이용해 정보를 함유한 타일을 선택한 뒤 10배 배율에서 악성 등급(양성, 저등급, 고등급)으로 세분화한다. 3,521장의 바이옵시 슬라이드(718명)로 학습·검증한 결과, 독립 테스트 셋에서 85.11% 정확도를 달성하며 기존 모델들을 능가한다.

상세 분석

이 연구는 전립선 병리학에서 가장 핵심적인 Gleason 등급 판정을 자동화하기 위해, 기존의 ROI 기반 혹은 대규모 세밀 라벨에 의존하는 접근법의 한계를 극복하고자 한다. 핵심 아이디어는 슬라이드를 ‘bag’, 각 타일을 ‘instance’로 보는 다중인스턴스 학습(MIL) 구조에 주의(attention) 메커니즘을 결합한 것이다.

- Attention‑based MIL: VGG‑11bn을 백본으로 사용해 각 타일에서 1024‑차원 특징 벡터를 추출하고, MLP 기반 주의 모듈이 각 인스턴스에 가중치 α를 할당한다. Softmax를 통해 전체 bag‑level 예측에 기여하는 중요도를 학습한다. 기존 주의 기반 MIL이 특정 몇 개 인스턴스에 과도하게 집중하는 문제를 완화하기 위해, 학습 시 ‘instance dropout’(픽셀을 평균값으로 대체) 기법을 도입해 다양한 영역을 탐색하도록 강제한다.

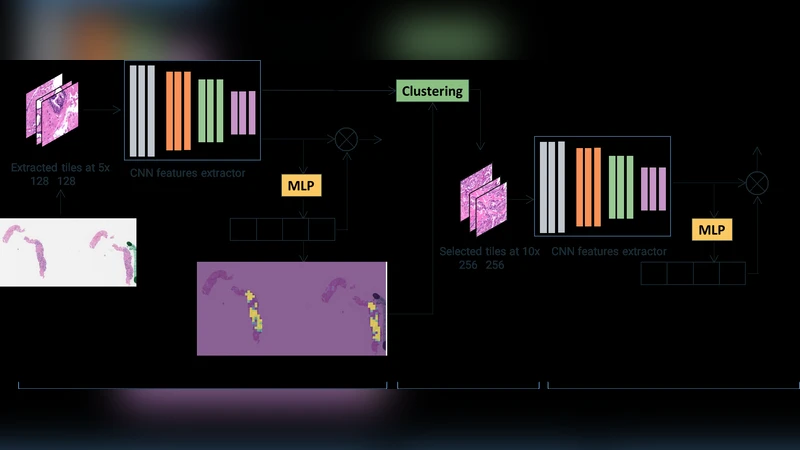

- 두 단계 구조: 첫 단계에서는 5× 배율(128×128 픽셀) 타일을 이용해 이진 암/비암 분류를 수행한다. 여기서 얻은 주의 맵과 특징 벡터를 기반으로 클러스터링(PCA→K‑means, 클러스터 수=4) 후, 평균 주의값이 높은 클러스터에서 상위 타일을 선택한다. 두 번째 단계에서는 동일 위치의 10× 배율 타일을 입력으로 하여 양성, 저등급, 고등급 3‑클래스 분류를 수행한다. 이렇게 하면 병리학자가 저배율로 전체 슬라이드를 스캔하고, 의심 부위만 고배율로 확대해 진단하는 과정을 모델이 모방한다.

- 데이터와 전처리: 두 개의 데이터셋을 활용한다. Cedars‑Sinai에서 얻은 픽셀‑레벨 라벨이 있는 소규모 타일 데이터(≈12k 타일)로 사전학습 후, UCLA에서 수집한 3,521장의 슬라이드(슬라이드‑레벨 라벨만)로 MIL을 학습한다. 배경·펜 마커 제거를 위해 HSV 색공간에서 조직 마스크를 생성하고, 80% 이상 조직을 포함하는 타일만 사용한다. 색상 정규화와 블루 비율 기반 ROI 사전선택(br‑two‑stage)을 비교 실험에 포함시켰다.

- 성능: 독립 테스트 셋(860 슬라이드, 227명)에서 85.11% 정확도를 기록했으며, 기존 연구(Zhou 75%, Xu 79%, Nagpal 70%)를 크게 앞선다. 혼동 행렬 분석에 따르면 저등급·고등급 구분에서 특히 개선된 것으로 보인다. 또한, 주의 맵을 시각화함으로써 모델이 실제 암 병변을 잘 포착했음을 정성적으로 확인했다.

- 의의와 한계: 슬라이드‑레벨 라벨만으로도 높은 정확도와 병변 위치 추정을 가능하게 한 점이 가장 큰 기여이다. 다만, 클러스터 수와 k‑percentile 선택 등 하이퍼파라미터가 데이터셋에 민감할 수 있으며, 5×→10× 두 단계가 고정된 배율에 의존한다는 점에서 다양한 확대 배율이나 멀티스케일 피라미드 구조로 확장할 여지가 있다. 또한, 현재는 전립선 바이옵시만을 대상으로 했으므로 다른 장기·암종에 대한 일반화 검증이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기