데이터 열 의미 유형 자동 인식을 위한 딥러닝 모델 Sherlock

초록

Sherlock은 78개의 의미 유형을 대상으로 686 765개의 실제 데이터 열을 학습한 다중 입력 딥러닝 모델이다. 1 588개의 통계·문자·워드 임베딩·문단 벡터 특징을 활용해 열의 의미 유형을 예측하며, 지원 가중 F1 점수 0.89로 기존 머신러닝, 정규식·사전 매칭, 크라우드 라벨링 대비 우수한 성능을 보인다.

상세 분석

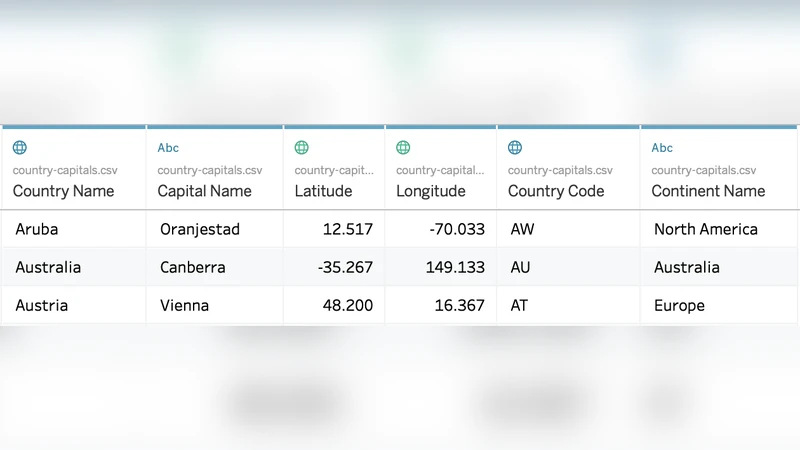

본 논문은 의미 유형 검출을 다중 클래스 분류 문제로 정의하고, 대규모 실세계 컬럼 데이터를 활용한 지도 학습 파이프라인을 제시한다. 먼저 DBpedia와 T2Dv2 골드 스탠다드에서 정의된 275개의 속성을 78개의 최종 유형으로 축소하고, VizNet 저장소에서 헤더와 정확히 일치하는 컬럼을 추출해 686 765개의 학습 샘플을 확보한다. 컬럼당 1 588개의 특징을 4가지 카테고리(전역 통계 27개, 문자 분포 960개, 사전 학습 워드 임베딩 200개, 자체 학습 문단 벡터 400개)로 구성한다. 전역 통계는 엔트로피, 고유값 비율, 숫자·문자 비중 등 기본적인 데이터 분포 정보를 제공하고, 문자 분포는 ASCII 96문자에 대한 빈도와 그 통계량을 통해 정규식 기반 탐지와 유사한 신호를 학습한다. 워드 임베딩은 GloVe 50차원을 사용해 각 값의 의미적 유사성을 수치화하며, 문단 벡터(PV‑DBOW)는 컬럼 전체를 하나의 “문단”으로 취급해 토픽 수준의 표현을 얻는다.

모델 아키텍처는 다중 입력 신경망으로, 각 특징 그룹을 별도의 서브 네트워크에 입력한 뒤 최종 전결합 층에서 통합한다. 이는 서로 다른 스케일과 특성을 가진 피처들을 효과적으로 학습하도록 돕는다. 학습은 60% 데이터를 훈련, 20%를 검증, 20%를 테스트 셋으로 나누어 진행했으며, 손실 함수는 다중 클래스 교차 엔트로피, 최적화는 Adam을 사용한다.

성능 평가는 지원 가중 F1 점수와 클래스별 정밀·재현율을 기준으로 진행했으며, 베이스라인으로 결정 트리와 랜덤 포레스트를 포함한 전통 머신러닝 모델, 정규식·사전 매칭 기반 시스템, 그리고 크라우드 라벨링 합의를 사용했다. Sherlock은 전반적으로 0.89의 F1 점수를 기록했으며, 특히 이름, 국가, 날짜와 같은 텍스트 중심 유형에서 높은 정확도를 보였다. 반면, 값이 매우 불규칙하거나 희소한 유형(예: 고유 식별자)에서는 성능이 다소 낮았다.

특징 중요도 분석에서는 문자 분포와 전역 통계가 기본적인 구분에 크게 기여했으며, 워드 임베딩과 문단 벡터는 의미적 차이를 포착하는 데 핵심 역할을 했다. 오류-거부 곡선 분석을 통해 모델이 자신감이 낮은 예측을 인간 검증에 넘기는 전략이 전체 시스템 정확도를 향상시킬 수 있음을 제시한다. 마지막으로, 데이터 품질 평가, 특징 확장, 공동 벤치마크 구축 등을 향후 연구 과제로 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기