단일 이미지에서 HDR 및 초고해상도 동시 복원

초록

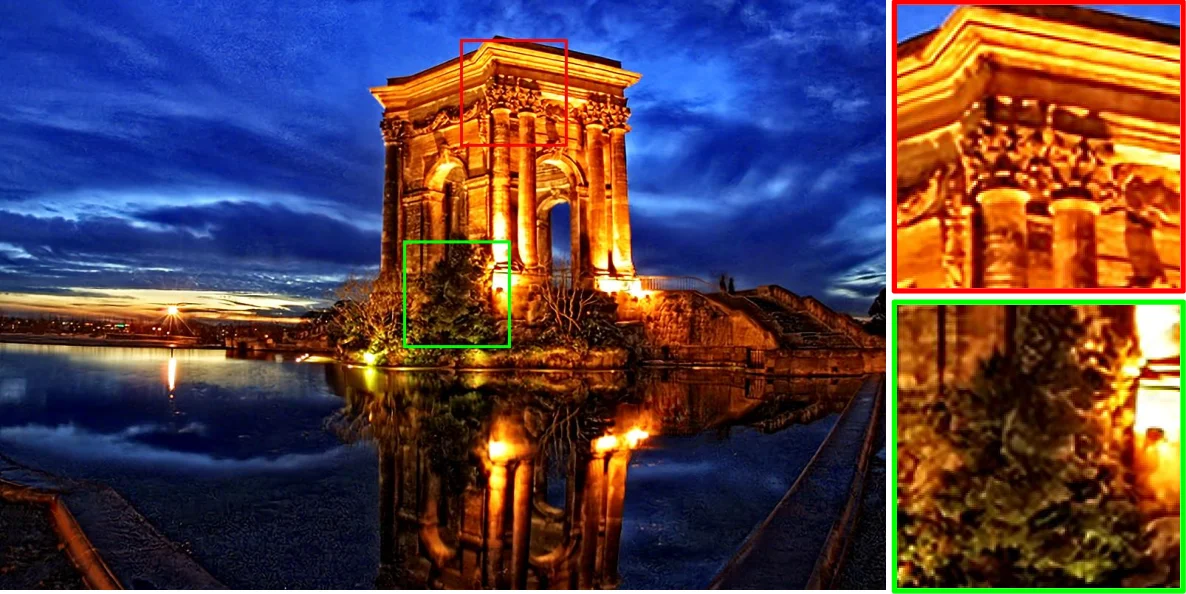

본 논문은 저해상도·저다이내믹 레인지(LDR‑LR) 이미지 하나만을 입력으로 받아, 고해상도·고다이내믹 레인지(HDR‑HR) 이미지를 동시에 생성하는 통합 프레임워크를 제안한다. 이미지의 저주파 성분인 조명(illumination)과 고주파 성분인 반사율(reflectance)을 Retinex 기반으로 분해한 뒤, 조명은 전통적인 보간·감마 보정으로 처리하고, 반사율만을 CNN(REF‑Net)으로 학습한다. 손실 함수는 MAE 기반 재구성 손실과, 세부 디테일 강화를 위한 RaGAN 기반 적대적 손실을 결합한다. 실험 결과, 별도 SR·HDR 네트워크를 순차적으로 적용한 방식보다 더 높은 시각적 품질과 적은 파라미터 수를 달성한다.

상세 분석

본 연구는 HDR 이미지와 초고해상도(SR) 이미지를 동시에 복원하기 위해, 두 과제가 공통으로 요구하는 “고주파 디테일 복원”에 초점을 맞춘다. 핵심 아이디어는 Retinex 이론에 기반한 이미지 분해이다. 입력 LDR‑LR 이미지 Y를 조명 I와 반사율 R로 분리하고, I는 저주파 성분이므로 단순히 bicubic 보간 후 감마 보정(γ=½)으로 HDR‑HR 수준으로 확대한다. 반면 R는 로그 도메인에서 조명과의 비율로 정의되며, 무한대 범위를 가질 수 있어 직접 CNN에 입력하면 학습이 불안정해진다. 이를 해결하기 위해 tanh 함수를 적용해 (‑1,1) 구간으로 정규화하고, 정규화된 R를 입력으로 하는 두 단계의 hourglass‑U‑Net 구조(REF‑Net)를 설계하였다. 첫 번째 hourglass‑U‑Net의 출력은 skip‑connection을 통해 두 번째 hourglass‑U‑Net에 전달되며, 최종 출력은 sub‑pixel convolution을 통해 고해상도로 복원된다.

손실 함수는 두 부분으로 구성된다. ① 재구성 손실 L_recon은 MAE(Mean Absolute Error) 형태로, 예측된 반사율 tanh(Ŕ_HH)와 실제 HDR‑HR 반사율 tanh(R_HH) 사이의 절대 차이를 최소화한다. ② 적대적 손실 L_G는 RaGAN( relativistic average GAN) 방식을 채택해, 생성된 반사율이 실제 반사율보다 더 “진짜”처럼 보이도록 학습한다. 판별자는 실제와 생성된 반사율을 동시에 비교해 상대적 확률을 출력한다. 전체 손실은 L = L_recon + μ·L_G (μ=10⁻³) 로 정의되며, 기본 모델(HDRI‑SR‑B)은 L_recon만 사용하고, 복합 모델(HDRI‑SR‑C)은 두 손실을 모두 사용한다.

학습 데이터는 MMPSG 데이터셋의 멀티노출 이미지와 그로부터 생성된 HDR 이미지 쌍을 활용한다. 입력은 표준 노출 이미지의 다운샘플링(LDR‑LR)이며, 출력은 해당 이미지의 HDR‑HR 반사율이다. 카메라 응답 함수(CRF)의 비선형성을 보정하기 위해 γ<1인 감마 함수의 역함수(f⁻¹(x)=x^{2.2})를 적용해 선형화한다. 이렇게 함으로써 서로 다른 카메라와 톤매핑 방식에 대한 의존성을 크게 감소시킨다.

실험에서는 기존의 SR·HDR 단일 네트워크를 순차적으로 적용한 파이프라인과 비교했을 때, 제안 방법이 PSNR/SSIM은 물론, LPIPS와 같은 비참조 품질 지표에서도 우수함을 보였다. 또한 파라미터 수가 약 30% 정도 감소해 실시간 응용 가능성도 제시한다. 한계점으로는 조명 성분을 단순 보간에 의존함으로써 극단적인 조명 변동이 있는 장면에서 잔여 잡음이 남을 수 있다는 점과, HDR‑HR 라벨이 제한적이어서 일반화 성능 검증이 추가 데이터셋에서 필요하다는 점을 들 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기