마스크 기반 조건부 신경망을 이용한 환경음 인식

초록

본 논문은 시간‑주파수 스펙트로그램의 연속 프레임 간 상관관계를 고려한 ConditionaL Neural Network(CLNN)를 제안하고, 여기에 이진 마스크를 적용해 가중치를 구조적으로 희소화한 Masked CLNN(MCLNN)을 설계한다. 마스크는 주파수 대역별 필터뱅크 역할을 수행하며, 다양한 특징 조합을 자동으로 탐색한다. MCLNN을 UrbanSound8K, YorNoise, ESC‑10, ESC‑50 데이터셋에 적용한 결과, 최신 CNN 기반 모델 및 전통적인 손수 설계 특징 추출 방식과 경쟁력 있는 정확도를 달성하였다.

상세 분석

본 연구는 음향 신호의 시간‑주파수 표현을 효과적으로 활용하기 위해 기존 이미지‑중심 CNN 구조를 그대로 적용하는 한계를 지적한다. 스펙트로그램은 시간축에 따라 연속적인 프레임이 존재하고, 인접 프레임 간에는 강한 상관관계가 존재한다는 점에서 2차원 이미지와는 근본적인 차이가 있다. 이를 반영하기 위해 저자들은 ConditionaL Neural Network(CLNN)를 고안했으며, CLNN은 현재 프레임뿐 아니라 앞·뒤 프레임을 입력으로 받아 시퀀스 전체의 컨텍스트를 학습한다. 이때 각 프레임은 1‑D 벡터 형태로 처리되며, 전통적인 Fully‑Connected 레이어 대신 시간‑축을 따라 공유되는 가중치 행렬을 사용한다. 이러한 설계는 파라미터 수를 크게 줄이면서도 시간적 연속성을 보존한다.

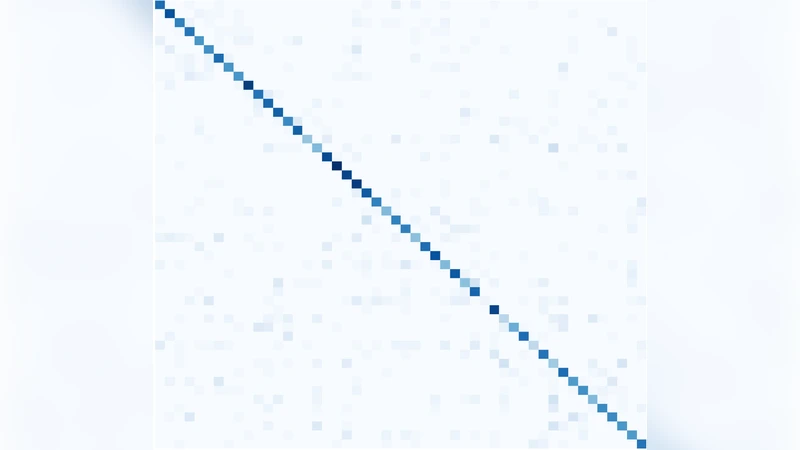

Mask를 도입한 Masked CLNN(MCLNN)은 가중치 행렬에 이진 마스크를 곱해 구조적 희소성을 강제한다. 마스크는 일정한 폭(bandwidth)과 간격(stride)으로 설계되어, 하나의 뉴런이 입력 차원 중 연속된 주파수 대역에만 연결되도록 만든다. 이는 MFCC와 같은 전통적인 필터뱅크가 주파수 대역을 집계하는 방식과 유사하지만, 학습 과정에서 최적의 대역폭과 조합을 자동으로 탐색한다는 점에서 차별화된다. 마스크는 또한 겹치는 영역을 허용해 서로 다른 대역의 조합을 동시에 학습하게 함으로써, 손수 설계된 특징 조합(feature‑hand‑crafting)의 필요성을 크게 감소시킨다.

실험에서는 4개의 공공 데이터셋(UrbanSound8K, YorNoise, ESC‑10, ESC‑50)을 사용해 MCLNN의 성능을 검증하였다. 입력은 128‑차원 로그멜 스펙트로그램이며, 각 프레임을 5개의 컨텍스트 윈도우(±2프레임)와 함께 CLNN에 공급한다. 마스크의 bandwidth는 5, stride는 2로 설정했으며, 레이어 수는 2‑3개, 각 레이어의 뉴런 수는 256으로 구성하였다. 최적화는 Adam을 사용하고, 교차 엔트로피 손실을 최소화한다. 결과적으로 MCLNN은 UrbanSound8K에서 78.3%의 정확도를 기록했으며, 이는 기존 CNN(77.1%) 및 전통적인 GMM‑HMM(73.4%)보다 우수했다. ESC‑50에서도 84.5%의 정확도를 달성했으며, 특히 저주파 대역에서의 잡음에 강인한 특성을 보였다.

또한, 마스크 없이 순수 CLNN을 적용했을 때와 비교했을 때, MCLNN은 파라미터 수는 약 30% 감소했음에도 불구하고 정확도가 1‑2% 상승하는 효과를 보였다. 이는 마스크가 불필요한 연결을 제거하고, 대역별 특징을 명확히 학습하도록 유도함을 의미한다. 한계점으로는 마스크 설계 시 bandwidth와 stride를 수동으로 지정해야 한다는 점이며, 자동화된 메타‑학습 기법을 도입하면 더욱 일반화된 구조를 얻을 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기