오디오 스타일 전이 텍스처 기반 프레임워크와 청각 모델 활용

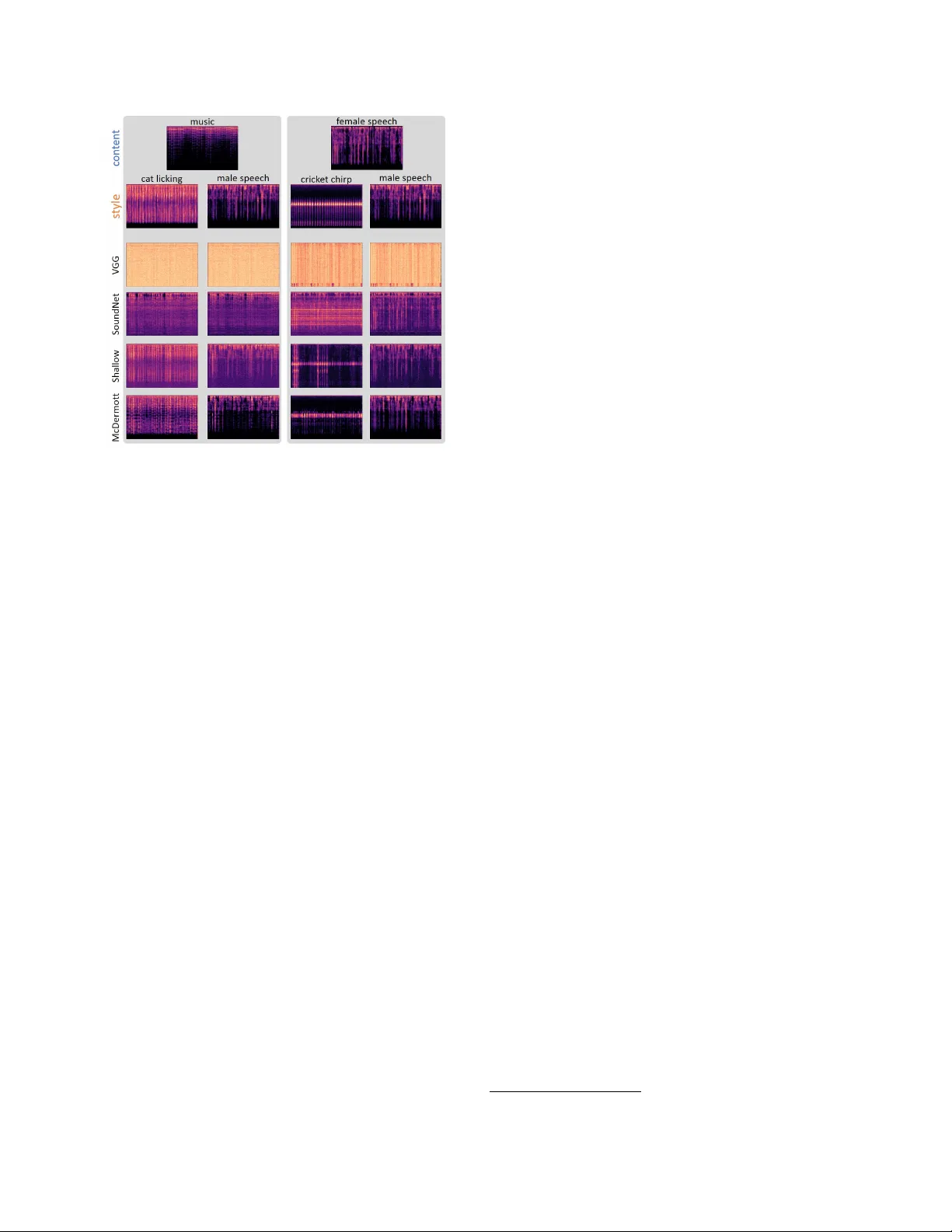

본 논문은 이미지 스타일 전이에서 영감을 받아, 오디오 신호의 “스타일”(텍스처)만을 추출·전송하는 새로운 프레임워크를 제안한다. 콘텐츠 신호를 초기값으로 사용하고, 콘텐츠 손실을 배제한 순수 스타일 손실을 최소화함으로써 구조는 유지하면서 텍스처를 변형한다. VGG‑19, SoundNet, 무작위 얕은 CNN, 그리고 인간 청각 시스템을 모방한 McDermott 모델 네 가지를 비교 실험했으며, 특히 무작위 얕은 CNN과 청각 기반 모델이 가장…

저자: Eric Grinstein, Ngoc Duong, Alexey Ozerov

본 논문은 이미지 분야에서 성공을 거둔 신경망 기반 스타일 전이 기법을 오디오 영역에 적용하려는 시도로 시작한다. 이미지 스타일 전이는 콘텐츠 이미지의 구조를 유지하면서 스타일 이미지의 텍스처와 색상 팔레트를 전이하는데, 이를 위해 사전 학습된 CNN(VGG‑19 등)에서 추출한 깊은 특징의 Gram 행렬을 손실 함수에 포함하고, 무작위 노이즈를 초기값으로 삼아 두 손실(콘텐츠·스타일)을 동시에 최소화한다. 그러나 같은 방법을 오디오에 그대로 적용하면, 결과가 콘텐츠와 스타일이 섞인 혼합음으로 끝나는 문제가 발생한다.

이에 저자들은 오디오 특성에 맞는 새로운 프레임워크를 제안한다. 전체 흐름은 크게 두 단계로 나뉜다. 첫 번째 단계에서는 콘텐츠와 스타일 신호를 필요에 따라 STFT 등으로 2‑D 스펙트로그램 형태로 변환한다. 두 번째 단계에서는 선택된 “오디오 텍스처 모델”을 이용해 두 신호의 통계량을 추출한다. 텍스처 모델은 (1) 사전 학습된 CNN(VGG‑19, SoundNet), (2) 무작위 얕은 CNN, (3) 인간 청각 시스템을 모방한 McDermott 모델 네 가지가 실험에 포함된다. 각 모델은 입력을 다르게 처리한다. VGG‑19는 스펙트로그램을 RGB 3채널로 복제해 이미지와 동일하게 입력하고, 최종 결과는 Griffin‑Lim 알고리즘을 통해 위상을 복원한다. SoundNet은 원시 파형을 직접 입력으로 받아 Gram 행렬을 계산한다. 무작위 얕은 CNN은 1‑계층, 4096개의 랜덤 필터를 사용해 시간 축에만 컨볼루션을 수행한다. McDermott 모델은 코클리어 필터링 → 엔벨로프 추출·비선형 압축 → 모듈레이션 필터링이라는 3‑단계 파이프라인을 거치며, 각 단계에서 평균·분산·왜도·교차 상관 등 다양한 통계량을 수집한다.

핵심 설계 차이는 두 가지이다. 첫째, 최적화 초기값을 무작위 노이즈가 아니라 콘텐츠 신호 자체로 설정한다. 이는 오디오가 시간적 연속성을 갖는 신호이므로, 초기부터 구조적 정보를 보존할 수 있게 한다. 둘째, 손실 함수를 스타일 손실만으로 제한한다. 스타일 손실은 선택된 텍스처 모델이 제공하는 통계(예: Gram 행렬, 변동·공분산, 모듈레이션 파워 등)와 스타일 신호의 통계 간 차이를 L2 노름으로 측정한다. 콘텐츠 손실을 배제함으로써 최적화가 콘텐츠 구조를 파괴하지 않으며, 오히려 초기값이 이미 구조를 담고 있기 때문에 자연스럽게 보존된다.

실험에서는 피아노 곡(Pachelbel’s Canon)과 프랑스어 여성 음성(콘텐츠) 그리고 남성 음성, 고양이 우유 핥기 소리, 귀뚜라미 울음소리(스타일) 등 다양한 조합을 테스트했다. 결과는 다음과 같다. VGG‑19 기반 전이는 높은 차원에서 잡음이 크게 증폭돼 청감적으로 부정적인 결과를 낸다. SoundNet은 어느 정도 스타일 삽입에 성공하지만 여전히 잡음이 섞여 있다. 무작위 얕은 CNN은 콘텐츠의 전반적인 구조를 유지하면서 스타일 텍스처를 정확히 삽입한다. 특히 피아노 어택 시점에 스타일 사운드가 정확히 맞춰지는 현상이 관찰된다. McDermott 모델은 인간 청각 메커니즘을 직접 모방했기 때문에 가장 자연스러운 결과를 제공한다. 스타일 텍스처가 전체 신호에 고르게 퍼지면서도 원본 리듬과 어택을 보존한다. 예를 들어, “고양이 우유 핥기” 소리를 피아노에 적용하면 각 피아노 음표 시작 시점에 짧은 핥는 소리가 삽입되어, 청취자는 마치 고양이가 피아노를 연주하는 듯한 느낌을 받는다. 또, 말소리를 스타일로 사용할 경우 멜로디가 말소리의 억양에 따라 흥얼거리는 효과가 나타난다.

결론적으로, 오디오 스타일 전이에서 중요한 것은 (1) 콘텐츠 초기화, (2) 스타일 전용 손실, (3) 텍스처 통계 추출을 위한 적절한 모델 선택이다. 특히 인간 청각을 모방한 McDermott 모델과 무작위 얕은 CNN이 가장 실용적인 결과를 보여준다. 향후 연구는 (a) 비정상적인 시간‑주파수 상관을 포함한 더 풍부한 통계량 도입, (b) 실시간 최적화 및 GPU 가속을 통한 인터랙티브 편집, (c) 멀티채널(스테레오·5.1) 및 음악 구조 인식을 결합한 고차원 스타일 전이 등으로 확장될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기