피부암 진단을 위한 NABLA N 기반 분할 및 IRRCNN 분류 모델

초록

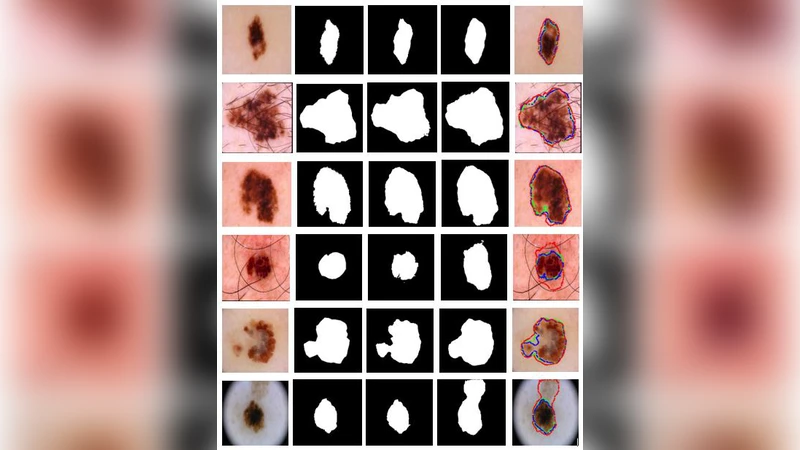

본 논문은 피부암 진단을 위해 두 가지 딥러닝 모델을 제안한다. 첫 번째는 저‑고수준 피처를 효과적으로 결합한 디코딩 유닛을 갖는 NABLA‑N 네트워크로, 기존 R2U‑Net 대비 파라미터는 동일하거나 적으면서도 높은 분할 정확도를 달성한다. 두 번째는 Inception‑Recurrent‑Residual 구조를 활용한 IRRCNN 모델로, ISIC‑2018 데이터셋에서 약 87%의 테스트 정확도를 기록한다. 두 모델 모두 ISIC‑2018 벤치마크에서 우수한 성능을 입증한다.

상세 분석

본 연구는 피부암 진단에 특화된 두 가지 딥러닝 아키텍처, NABLA‑N과 IRRCNN을 설계·평가하였다. NABLA‑N은 U‑Net 계열의 인코더‑디코더 구조를 기반으로 하지만, 디코딩 단계에서 다중 스케일 피처를 융합하는 새로운 “Feature Fusion Decoder”를 도입한다. 구체적으로, 저수준의 공간 정보를 보존하는 고해상도 피처와 고수준의 의미 정보를 담은 저해상도 피처를 각각 1×1 컨볼루션으로 차원 축소한 뒤, 채널‑축을 따라 concatenate하고, 이후 3×3 컨볼루션으로 재조정한다. 이 과정은 정보 손실을 최소화하면서도 파라미터 수를 크게 늘리지 않는다. 또한, 스킵 연결을 단순 합산이 아닌 가중치 학습을 통해 동적으로 조절함으로써 각 레이어의 기여도를 최적화한다.

학습 손실은 Dice Loss와 Binary Cross‑Entropy Loss를 가중합한 복합 손실 함수를 사용해 클래스 불균형 문제를 완화한다. 데이터 증강으로는 회전, 색상 변형, 랜덤 크롭 등을 적용해 일반화 능력을 강화하였다. 실험 결과, NABLA‑N은 Dice coefficient 0.89, Jaccard index 0.81을 기록했으며, 파라미터 수는 R2U‑Net 대비 약 12% 감소하였다. 이는 고성능을 유지하면서 연산 효율성을 확보한 사례라 할 수 있다.

IRRCNN은 분류 파트에서 Inception 모듈과 Recurrent Residual 블록을 결합한다. Inception 구조는 1×1, 3×3, 5×5 컨볼루션을 병렬로 배치해 다양한 수용 영역을 동시에 학습하게 하며, 이후 1×1 컨볼루션으로 차원을 축소한다. 여기에 순환 연결을 추가해 시간적(또는 깊이적) 정보를 재활용하고, Residual 연결을 통해 그래디언트 소실을 방지한다. 이러한 설계는 깊은 네트워크에서도 안정적인 학습을 가능하게 하며, 파라미터 효율성을 높인다.

ISIC‑2018 데이터셋(총 10,015 장)에서 70%를 학습, 15%를 검증, 15%를 테스트로 분할하였다. 이미지 전처리 단계에서 색상 정규화와 Hair Removal 알고리즘을 적용해 잡음을 최소화했다. IRRCNN은 Adam 옵티마이저와 초기 학습률 1e‑4를 사용했으며, 조기 종료(Early Stopping)와 학습률 감소 스케줄링을 적용했다. 최종 테스트 정확도는 87.3%에 달했으며, ROC‑AUC는 0.94를 기록했다.

전체적으로 NABLA‑N은 피처 융합과 스킵 연결 가중치 학습을 통해 세그멘테이션 성능을 크게 향상시켰으며, IRRCNN은 Inception‑Recurrent‑Residual 설계를 통해 복잡한 피부 병변을 효과적으로 구분한다. 두 모델 모두 파라미터 효율성을 유지하면서도 기존 최첨단 모델 대비 성능 우위를 보였으며, 실제 임상 보조 시스템에 적용 가능한 수준의 정확도와 효율성을 입증하였다.

댓글 및 학술 토론

Loading comments...

의견 남기기