딥 멀티모달 클러스터링을 통한 무감독 시청각 학습

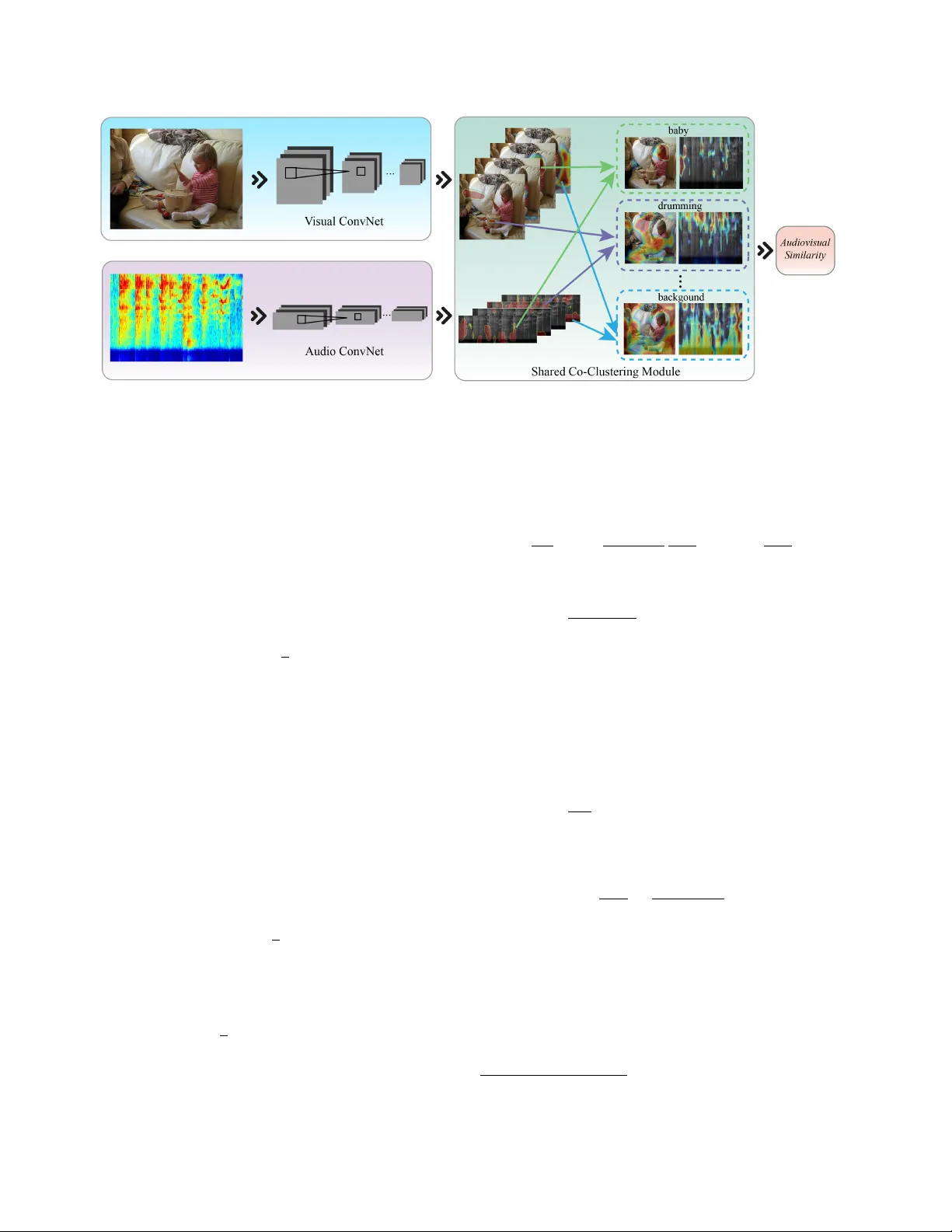

본 논문은 영상과 오디오의 컨볼루션 피처를 K‑means 기반의 소프트 클러스터링으로 분리하고, 각 클러스터에 공유 프로젝션을 적용해 다중 시청각 대응 관계를 학습한다. 클러스터링은 미분 가능한 소프트맥스 근사와 EM‑유사 업데이트로 구현되며, 최종적으로 최대 마진(트리플릿) 손실을 통해 엔드‑투‑엔드로 최적화한다. 실험 결과, 단일 모달 표현이 인간 수준을 넘어서는 분류 정확도를 보이며, 소리 위치 추정·다중 소스 감지·시청각 이해 등 다양한…

저자: Di Hu, Feiping Nie, Xuelong Li

**1. 서론**

시청각 데이터는 자연스럽게 동시 발생하는 시각·청각 신호를 포함한다. 인간은 이러한 동시성을 이용해 사물과 소리를 연결하고, 복잡한 환경에서도 의미를 파악한다. 기존 무감독 시청각 학습 연구는 두 스트림을 단일 네트워크에 입력하고, “같은 비디오인가?”라는 이진 판단을 통해 교차 모달 supervision을 제공한다. 그러나 이러한 전역 일치 판단은 (1) 영상에 다중 객체가 존재하고, (2) 오디오가 다중 소스 혼합인 실제 상황에서 정확한 매칭을 방해한다. 따라서 각 모달을 구성 요소 수준으로 분해하고, 그 구성 요소 간의 정교한 대응 관계를 학습하는 방법이 필요하다.

**2. 관련 연구**

시청각 학습은 크게 (i) 교사‑학생 방식(한 모달의 사전 학습 모델을 다른 모달에 전이), (ii) 순수 무감독 방식(두 스트림의 일치 여부를 학습), (iii) 응용 과제(소리 위치 추정, 소스 분리)로 구분된다. 기존 무감독 방법은 전역 일치 손실만 사용해 단일 소스·단일 객체 상황에 적합했으며, 다중 객체·다중 소스 환경에서는 성능이 급격히 저하된다. 최근 attention 기반 모델이 시각적 영역을 강조했지만, 여전히 소리 혼합 문제를 완전히 해결하지 못한다.

**3. 제안 모델**

본 논문은 “Deep Multimodal Clustering(DMC)”이라는 새로운 프레임워크를 제시한다.

- **3.1. 두 스트림 서브넷**

- *영상 서브넷*: VGG‑16(FC와 Softmax 제외)을 사용해 256×256 입력을 8×8×512 피처 맵으로 변환한다. 각 공간 위치(8×8=64)마다 512‑차원 벡터 uᵥᵢ를 얻는다.

- *오디오 서브넷*: VGGish을 기반으로 496프레임(10 ms) 로그‑멜 스펙트로그램을 입력하고, 최종 31×4×512 피처 맵을 124개의 512‑차원 벡터 uₐᵢ로 재구성한다.

- **3.2. 멀티모달 클러스터링 모듈**

- 각 모달의 피처 집합 {u₁,…,uₚ}에 대해 k개의 클러스터 중심 C={c₁,…,c_k}를 학습한다. 전통적인 K‑means의 hard assignment은 미분 불가능하므로, 논문은 최대값 근사를 로그‑합 형태로 변형하고 softmax를 이용해 부드러운 할당 sᵢⱼ=softmax(−dᵢⱼ/ζ) 를 정의한다. 여기서 dᵢⱼ는 거리 함수이며, 내적 기반 dᵢⱼ=−⟨Wⱼuᵢ, cⱼ⟩ 로 설정한다.

- 클러스터 중심은 sᵢⱼ에 대한 가중 평균으로 업데이트한다: cⱼ←∑ᵢ sᵢⱼ Wⱼuᵢ. 이 과정은 EM 알고리즘의 E‑step·M‑step을 연상시킨다.

- 각 클러스터마다 공유 프로젝션 행렬 Wⱼ∈ℝ^{m×n}를 적용해 영상·오디오 피처를 동일 차원의 “멀티모달 중심” 공간에 매핑한다. 이렇게 하면 동일 j에 대해 영상 클러스터와 오디오 클러스터가 같은 물리적 사운드·시각 객체를 나타낸다고 가정한다.

- **3.3. 학습 목표**

- 멀티모달 중심 간의 코사인 유사도를 이용해 max‑margin(트리플릿) 손실을 정의한다. 양성 쌍은 같은 비디오에서 추출된 영상·오디오 클러스터 중심이며, 음성 쌍은 서로 다른 비디오에서 무작위로 매칭된 중심이다.

- 손실 L = Σ

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기