실제 영상에서 추출한 제어 가능한 캐릭터

초록

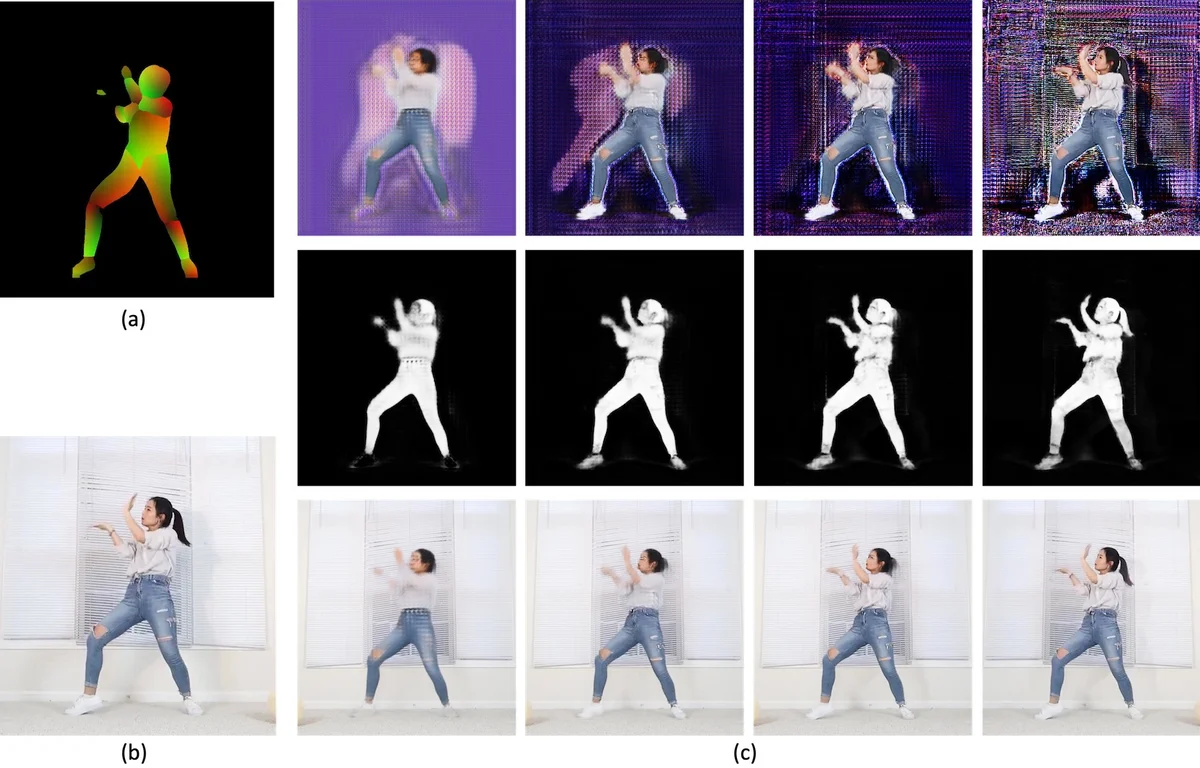

Vid2Game은 기존 동영상에서 사람을 자동으로 분리하고, 2D 이동 신호(조이스틱 등)만으로 자세를 생성·제어할 수 있게 만든 시스템이다. Pose2Pose 네트워크가 현재 자세와 사용자가 입력한 이동 벡터를 기반으로 다음 자세를 예측하고, Pose2Frame 네트워크가 이전·현재 자세와 원하는 배경을 이용해 고해상도 프레임과 알파 마스크를 합성한다. 이를 통해 배경을 자유롭게 교체하면서도 인물의 동작과 외관을 사실적으로 재현한다.

상세 분석

Vid2Game은 두 단계의 GAN 기반 네트워크를 결합한 파이프라인으로, 기존 비디오에서 인물을 추출하고 사용자가 정의한 저차원 제어 신호에 따라 고품질의 새로운 영상을 생성한다. 첫 번째 단계인 Pose2Pose(P2P) 네트워크는 pix2pixHD 구조를 변형하여 입력 자세와 2차원 이동 벡터(s₁) 를 결합한다. 핵심은 중간 residual block에 제어 신호를 선형 투영한 텐서를 더해 조건화하는 ‘조건부 residual block’이며, 이는 완전한 bypass를 차단해 자세 변화를 보다 자연스럽게 만든다. 또한, P2P는 512×512 해상도로 자세만을 예측함으로써 학습 효율성을 높이고, 이후 단계에서 고해상도 합성을 담당하도록 설계되었다. 손실 함수는 LSGAN 손실, 판별기 feature‑matching 손실, 그리고 VGG 기반 퍼셉추얼 손실을 결합해 자세의 구조적 일관성과 시각적 사실성을 동시에 최적화한다.

두 번째 단계인 Pose2Frame(P2F) 네트워크는 역시 pix2pixHD를 기반으로 하며, 입력으로 이전 자세와 현재 자세(및 손에 든 물체)를 결합한 6채널 텐서를 사용한다. P2F는 RGB 이미지(zᵢ)와 알파 마스크(mᵢ)를 동시에 출력하고, 이를 사용자가 제공한 배경(bᵢ)와 선형 블렌딩해 최종 프레임(fᵢ)을 만든다. 여기서 마스크는 0~1 값을 갖는 연속적인 알파 채널로, 배경과 인물 사이의 경계와 그림자 같은 환경 효과를 부드럽게 처리한다. P2F의 판별기는 다중 스케일 구조와 이진 마스크에 초점을 맞춘 별도 디스크리미네이터를 포함해, 인물 윤곽과 배경 디테일을 각각 정밀하게 평가한다. 손실 구성은 LSGAN, feature‑matching, VGG 퍼셉추얼 손실을 포함해, 고해상도(최대 1024p)에서도 텍스처와 조명 일관성을 유지한다.

시스템 전체는 자동 회귀 방식으로 동작한다. 사용자는 초기 자세(p₀)와 원하는 2D 이동 시퀀스(s₁…s_T), 그리고 배경 이미지 시퀀스(b₁…b_T)를 제공하면, P2P가 자세 시퀀스를 생성하고 P2F가 각 프레임을 합성한다. 중요한 설계 포인트는 (1) 배경 분리를 위한 마스크 기반 블렌딩, (2) 저차원 제어 신호를 고차원 자세로 확장하는 조건부 residual block, (3) 자세와 이미지 생성 사이의 오류 누적을 억제하기 위한 두 단계의 GAN 및 퍼셉추얼 손실, (4) DensePose와 손 객체 세그멘테이션을 활용한 풍부한 입력 표현이다. 실험에서는 댄서, 테니스 선수 등 다양한 도메인에서 기존 영상‑투‑영상 방법들(

댓글 및 학술 토론

Loading comments...

의견 남기기