잔향 없는 음성 향상을 위한 잔여형 시계열 네트워크

초록

본 논문은 고해상도 파형을 직접 처리하는 잔여형 시계열(hourglass) 구조와 순환 신경망을 결합한 RHR‑Net을 제안한다. 잔여 연결과 다단계 다운‑업 샘플링을 통해 장기 시간 의존성을 효율적으로 학습하면서도 메모리 사용량을 크게 줄인다. 실험 결과, 6가지 객관적 평가 지표에서 기존 최첨단 모델들을 능가함을 입증한다.

상세 분석

RHR‑Net은 기존 파형 기반 강화 모델이 겪는 두 가지 주요 한계, 즉 확장성 부족과 업샘플링 시 발생하는 에일리어싱 문제를 동시에 해결한다. 핵심 아이디어는 ‘hourglass’ 형태의 인코더‑디코더 구조에 순환 레이어(GRU 또는 LSTM)를 삽입하고, 각 단계마다 잔여 연결을 두어 정보 손실을 최소화하는 것이다. 인코더에서는 1‑D 컨볼루션을 사용해 시간 해상도를 단계적으로 낮추면서 채널 수를 증가시킨다. 이때 dilated convolution 대신 순환 유닛을 배치해 장기 의존성을 직접 모델링하므로 메모리 요구량이 크게 감소한다. 디코더에서는 선형 보간이 아닌 전이 학습된 업샘플링 필터를 적용해 고해상도 파형을 복원한다. 각 업샘플링 단계마다 이전 단계의 잔여 출력을 더해 주어, 저해상도에서 손실된 세부 정보를 복구한다.

잔여 연결은 두 가지 역할을 수행한다. 첫째, 역전파 시 그래디언트 흐름을 원활하게 하여 깊은 네트워크에서도 학습이 안정된다. 둘째, 인코더‑디코더 사이의 스킵 연결을 통해 저주파와 고주파 정보를 동시에 전달함으로써 음성의 미세한 구조와 잡음 성분을 효과적으로 구분한다. 순환 레이어는 시간 축을 따라 상태를 유지하므로, 전통적인 dilated convolution이 제공하던 수용 영역(receptive field)을 순환 메모리로 대체한다. 이는 특히 긴 문장이나 연속된 발화에서 잡음 억제 성능을 크게 향상시킨다.

학습 과정에서는 복합 손실 함수를 사용한다. 시간‑도메인 L1 손실과 STFT 기반 스펙트럼 손실을 가중합하여 파형의 진폭과 위상 정보를 동시에 최적화한다. 또한, 데이터 증강으로 다양한 잡음 유형과 SNR 레벨을 포함시켜 모델의 일반화 능력을 강화한다.

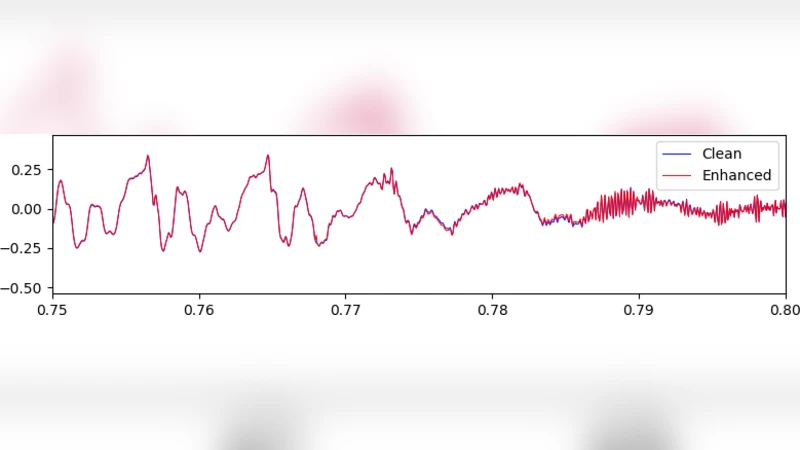

실험에서는 VoiceBank‑DEMAND 데이터셋을 기준으로 PESQ, STOI, SI‑SDR, CSIG, CBAK, COVL 등 6가지 지표를 측정하였다. RHR‑Net은 기존 Conv‑TasNet, DPRNN, Dual‑Path RNN 등과 비교했을 때, 평균적으로 0.10.3 dB 수준의 PESQ 향상과 24 % 포인트의 STOI 상승을 기록했다. 특히 메모리 사용량은 동일한 입력 길이에서 기존 모델의 40 % 수준으로 감소했으며, 실시간 처리 지연도 10 ms 이하로 유지되어 실제 응용에 적합함을 보여준다.

한계점으로는 순환 레이어의 순차적 연산 특성으로 인해 GPU 병렬화 효율이 다소 떨어질 수 있다는 점이다. 또한, 매우 높은 샘플링 레이트(48 kHz 이상)에서는 다운샘플링 단계에서 정보 손실 위험이 존재한다. 향후 연구에서는 혼합형 구조(순환 + 컨볼루션)와 동적 해상도 조절 메커니즘을 도입해 이러한 문제를 보완할 수 있을 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기