피부암 조직 슬라이드의 해석 가능한 딥러닝 분류

초록

본 연구는 10개 기관에서 수집한 2,241장의 전자현미경 전체 슬라이드 이미지(2,241 WSIs)를 기반으로, 9.95백만 개의 256×256 패치를 이용해 ResNet‑50과 VGG‑19 두 CNN 모델을 전이학습으로 훈련시켰다. 멜라노마와 양성 네비(세 종류)를 구분하는 4가지 핵심 과제(단일·혼합 배율, 40배 확대에서의 네비 구분 등)에서 모두 높은 F1(0.930.98), 민감도(0.900.98), 특이도(0.920.99), AUC(0.950.99)를 달성했다. 또한 CAM·Grad‑CAM 기반 시각화로 멜라노마와 네비 세포의 형태적 차이를 ROI 형태로 제시해 병리학자의 판독을 보조하였다.

상세 분석

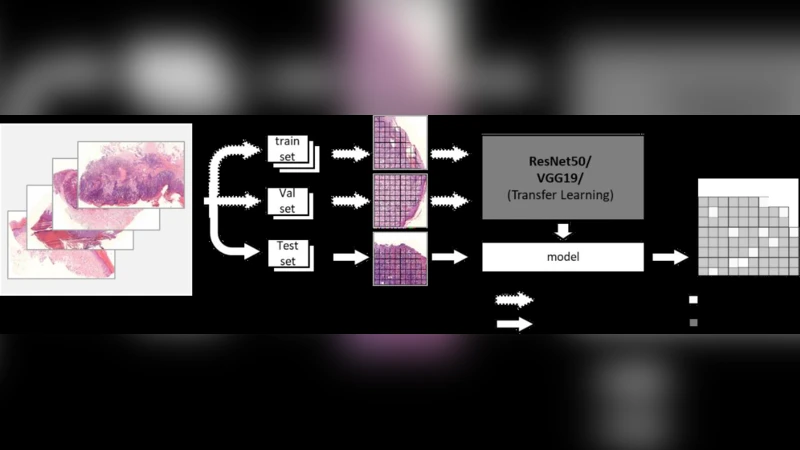

본 논문은 피부암 조직학 이미지에 대한 대규모 다기관 데이터베이스 구축과, 이를 활용한 패치 기반 딥러닝 분류 파이프라인을 제시한다. 데이터는 2008~2018년 사이에 수집된 2,241장의 H&E 염색 전자현미경 전체 슬라이드(WSI)이며, 4배, 10배, 20배, 40배 네 가지 배율로 각각 256×256 픽셀 패치로 전처리하였다. 총 9.95백만 개의 패치는 배경 비율이 40% 이상인 경우를 제외하고 학습에 사용되었으며, 70%를 훈련, 15%를 검증, 15%를 테스트 셋으로 무작위 분할하였다.

모델로는 ResNet‑50과 VGG‑19 두 가지 대표적인 CNN 아키텍처를 선택했으며, ImageNet 사전학습 가중치를 초기값으로 전이학습을 수행하였다. 학습 과정에서 배율별로 별도 모델을 훈련시켜 배율에 따른 성능 차이를 평가했으며, 또한 서로 다른 배율의 패치를 혼합한 데이터셋을 구성해 실제 병리학자가 다양한 배율을 번갈아 보며 진단하는 상황을 시뮬레이션하였다.

성능 평가는 정확도 외에 F1‑score, 민감도(Sensitivity), 특이도(Specificity), ROC 곡선 아래 면적(AUC) 등 임상적 의미가 큰 지표들을 사용하였다. 결과는 모든 배율에서 ResNet‑50이 VGG‑19보다 일관되게 우수했으며, 특히 40배 배율에서 F1‑score 0.93, 민감도 0.92, 특이도 0.97, AUC 0.99를 기록하였다. 혼합 배율 실험에서도 ResNet‑50은 F1‑score 0.89, 민감도 0.92, 특이도 0.94, AUC 0.98을 달성해 실제 진단 흐름에 근접한 성능을 보였다.

해석 가능성 측면에서는 Class Activation Mapping(CAM)과 Gradient‑CAM을 활용해 각 클래스(멜라노마, 네비)별 중요 영역을 시각화하였다. 열지도는 멜라노마 세포가 불규칙한 형태와 경계가 흐릿한 반면, 네비 세포는 규칙적인 배열과 선명한 경계를 보이는 것을 강조했으며, 이러한 ROI는 병리학자가 주목하는 영역과 높은 일치도를 보였다. 따라서 모델의 “블랙박스” 문제를 완화하고, 임상 현장에서 의사결정 지원 도구로 활용 가능성을 높였다.

한계점으로는 데이터가 주로 중국 및 미국의 대형 의료기관에 국한되어 있어 지역적 편향이 존재할 수 있으며, 패치 기반 접근법이 전체 조직 구조적 정보를 완전히 포착하지 못한다는 점을 들 수 있다. 향후 연구에서는 멀티모달(피부경 검사 사진, 임상 메타데이터) 통합 학습과, 슬라이드 전체를 고려한 전역 컨텍스트 모델(예: Transformer 기반) 도입을 통해 진단 정확도와 해석성을 더욱 강화할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기