인간과 컴퓨터 바둑: 리뷰와 전망

초록

본 논문은 1998년부터 2016년까지 컴퓨터 바둑의 주요 발전 과정을 정리하고, 특히 2016년 알파고가 이세돌 9단을 꺾은 사건을 중심으로 인공지능·컴퓨팅 인텔리전스(CI)의 기술적 핵심과 인간 바둑 고수들의 평가를 종합한다. 알파고의 정책·가치 신경망, 강화학습 기반 자체 대국, 그리고 몬테카를로 트리 탐색(MCTS) 결합 방식을 상세히 설명하고, 향후 바둑 교육 및 AI 실용화에 미칠 파급 효과를 전망한다.

상세 분석

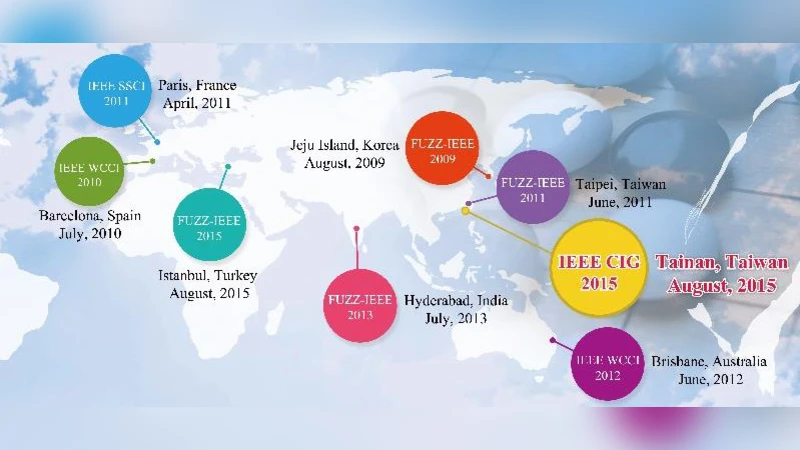

1998년부터 시작된 컴퓨터 바둑 연구는 초기에 규칙 기반 탐색과 정적 평가 함수에 의존했으며, 연산량과 메모리 제한으로 인해 인간 수준에 도달하기 어려웠다. 2000년대 중반에는 MCTS가 도입되어 탐색 효율이 크게 향상되었고, 특히 2014년부터 IEEE CIS 대회에 참가한 프로그램들은 MCTS와 패턴 기반 휴리스틱을 결합해 9목 이하에서 인간 초급자를 앞서는 성과를 보였다. 알파고는 이러한 흐름을 한 단계 끌어올렸다. 첫 번째 단계는 대규모 인간 기보를 이용한 감독 학습(supervised learning)으로 정책 네트워크를 훈련시켜 착수 후보를 200배 이상 축소했다. 두 번째 단계는 정책 네트워크를 초기화한 뒤 자체 대국을 통해 강화학습(reinforcement learning)으로 정책을 미세 조정하고, 동시에 가치 네트워크를 학습시켜 현재 보드 상태의 승률을 직접 예측하도록 했다. 이 두 네트워크는 MCTS와 긴밀히 통합되어, 전통적인 시뮬레이션 대신 신경망이 제공하는 확률적 착수와 가치 평가를 사용함으로써 탐색 깊이를 크게 늘렸다. 특히 알파고는 “정책-가치 네트워크 + MCTS”라는 구조를 통해 인간이 직관적으로 판단하는 ‘전략적 포석’과 ‘전술적 수읽기’를 동시에 모방했으며, 이는 기존 프로그램이 단순히 수많은 시뮬레이션을 수행하던 방식과 근본적으로 차별화된다. 실험 결과, 알파고는 자체 대국에서 99.8% 이상의 승률을 기록했으며, 이세돌 9단과의 5번 대국에서 4승을 차지함으로써 인간 최고수와 AI의 격차가 실질적으로 사라졌음을 입증했다. 프로 기사들의 코멘트는 알파고가 보여준 ‘비정형적 착수’와 ‘새로운 전술적 아이디어’가 인간의 사고 틀을 확장시키는 역할을 할 수 있음을 강조한다. 기술적 관점에서 알파고의 성공은 대규모 데이터, 고성능 GPU 클러스터, 그리고 효율적인 분산 학습 파이프라인이 결합될 때 비지도 학습과 강화학습이 실전 게임에 적용될 수 있음을 증명한다. 향후 연구는 정책·가치 네트워크의 경량화, 멀티에이전트 협업 학습, 그리고 바둑 외 다른 복합 의사결정 문제에 대한 전이 학습(transfer learning)으로 확대될 전망이다.