VAE로 잡아내는 목소리: 딥 스피커 임베딩의 가우시안 정규화 기술

딥러닝 기반 스피커 임베딩(x-vector)은 우수한 성능을 보이지만, 그 분포가 가우시안을 따르지 않아 표준 PLDA 백엔드 처리 시 성능이 저하되는 문제가 있습니다. 본 연구는 변분 오토인코더(VAE)를 활용해 x-vector를 더 규칙적이고 가우시안에 가까운 잠재 코드(v-vector, c-vector)로 변환하는 정규화 기법을 제안합니다. 이를 통해 단순 코사인 유사도 점수만으로도 성능이 크게 향상되었으며, PLDA와 결합 시 최첨단 성…

저자: Yang Zhang, Lantian Li, Dong Wang

본 논문은 딥 스피커 임베딩 시스템에서 x-vector의 비가우시안 분포 문제를 해결하기 위해 변분 오토인코더(VAE) 기반 정규화 방법을 제안하고 그 유효성을 입증합니다.

서론에서는 화자 검증 기술의 발전 흐름을 GMM-UBM, i-vector를 거쳐 현재의 딥 스피커 임베딩(x-vector)으로 설명합니다. i-vector는 그 생성 과정이 선형 가우시안 모델에 기반하여 PLDA의 가정과 자연스럽게 부합했지만, x-vector는 비선형 DNN으로부터 학습되므로 사전 분포와 조건부 분포 모두 제약이 없어 PLDA 모델링에 어려움을 준다는 문제를 지적합니다.

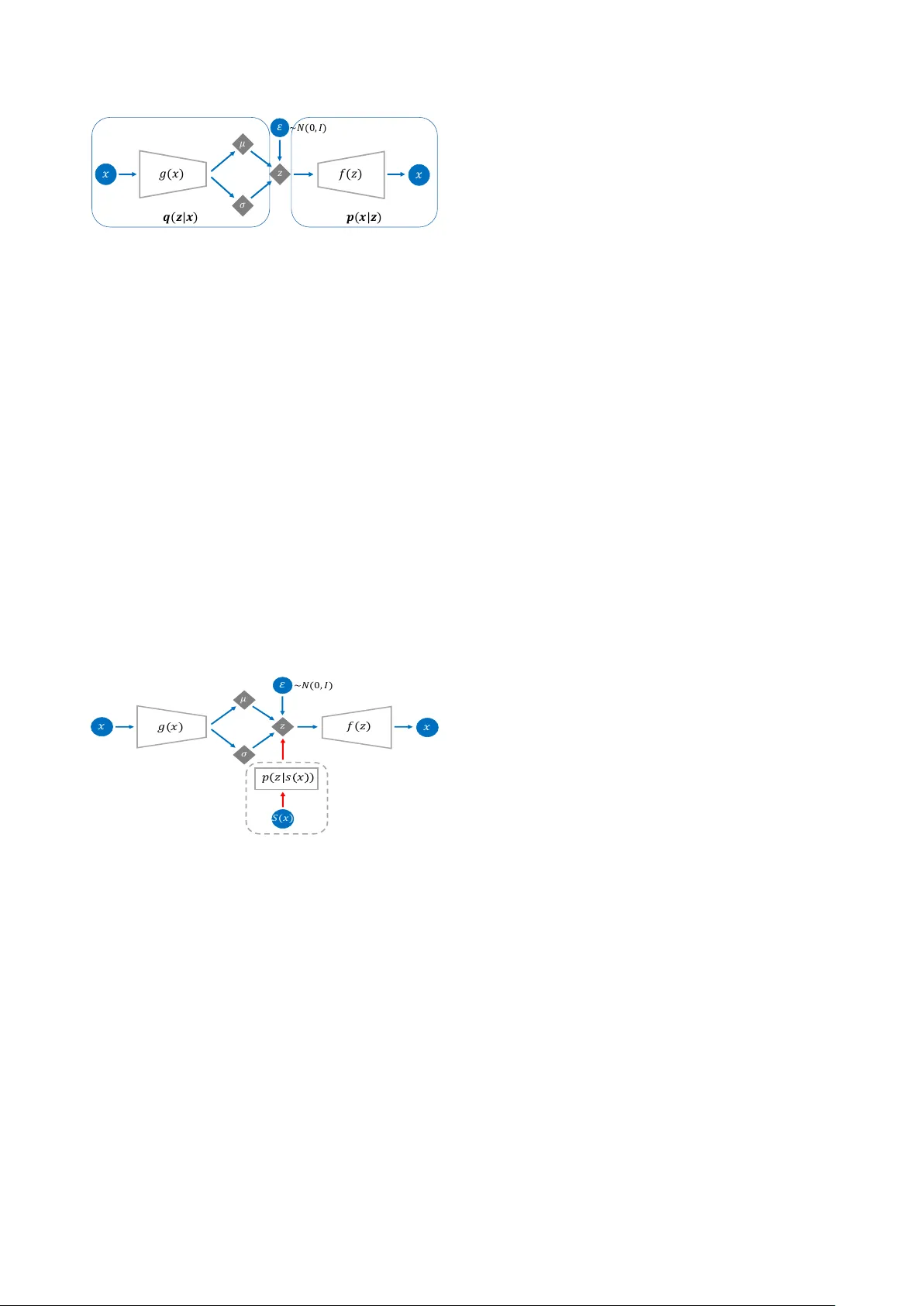

본론에서는 제안 방법론을 상세히 설명합니다. 먼저 PLDA가 화자 임베딩의 변동을 화자 간 변동과 화자 내 변동으로 분해하는 선형 가우시안 모델임을 재확인합니다. 이후 핵심 해결책으로 VAE를 도입합니다. VAE는 간단한 잠재 변수 분포 p(z)(예: 표준 정규분포)를 복잡한 관측 데이터 분포 p(x)로 매핑하는 생성 모델입니다. 본 연구에서는 이 매핑의 역과정, 즉 인코더 네트워크 g(x)를 통해 x-vector를 잠재 공간의 정규화된 코드 z(v-vector)로 변환합니다. 이때 인코더는 잠재 코드의 사후 분포 q(z|x)를 근사하며, 훈련 목표는 재구성 손실과 q(z|x)를 p(z)에 가깝게 만드는 KL 발산 정규화 항의 결합입니다. 더 나아가, 화자 레이블 정보를 활용하여 동일 화자의 잠재 코드들이 서로 가까워지도록 유도하는 '응집 손실'을 목적 함수에 추가한 'Cohesive VAE' 모델도 제안하여 c-vector를 생성합니다.

실험 섹션에서는 VoxCeleb 데이터로 x-vector 추출기, PLDA, VAE 모델을 훈련하고, SITW(도메인 내)와 CSLT-SITW(도메인 외) 데이터셋으로 평가합니다. 프론트엔드로 x-vector, v-vector, c-vector 및 비교를 위한 일반 AE 기반 a-vector를, 백엔드로 코사인 거리, PCA, PLDA 등을 조합해 테스트합니다.

주요 결과는 다음과 같습니다. 1) VAE 정규화된 v-vector와 c-vector는 x-vector보다 왜도와 첨도가 현저히 낮아 더 가우시안에 가까운 분포를 보였습니다. 2) 정규화된 벡터는 PLDA 없이 코사인 거리만으로도 x-vector + PLDA 조합에 버금가는 성능(약 9-10% EER)을 달성하여, PLDA의 주요 역할이 분별이 아닌 정규화에 가깝다는 것을 입증했습니다. 3) Cohesive VAE로 얻은 c-vector는 코사인 점수에서 v-vector보다 더 나은 성능을 보였습니다. 4) VAE 정규화 후 PLDA를 적용하면 최종적으로 SITW Eval Core에서 3.64%(v-vector) 및 3.77%(c-vector)의 우수한 EER을 기록하여 최첨단 성능을 확인했습니다. 5) 일반 AE나 PCA는 VAE와 같은 수준의 정규화 성능을 내지 못해 VAE의 확률적 모델링의 중요성을 부각시켰습니다.

결론적으로, 이 연구는 VAE를 이용해 딥 스피커 임베딩의 통계적 속성을 사전에 정규화함으로써 백엔드 모델의 가정과 잘 맞추어 전체 시스템 성능을 향상시키는 효과적인 방법을 제시했습니다. 이는 프론트엔드 임베딩 학습과 백엔드 통계 모델링의 시너지를 위한 새로운 방향을 제시한다는 점에서 의미가 있습니다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기