다중화자 TTS를 위한 불균형 음성 데이터 활용 방안

본 논문은 화자별 데이터 양이 크게 차이 나는 상황에서, 모든 화자의 데이터를 그대로 결합한 다중화자 TTS 모델이 기존 화자‑종속 모델보다 우수함을 확인하고, 각 서브모델을 서로 다른 샘플링 데이터로 학습시킨 앙상블 방식을 도입하면 특히 데이터가 적은 화자에 대해 합성 음성 품질을 크게 향상시킬 수 있음을 입증한다.

저자: Hieu-Thi Luong, Xin Wang, Junichi Yamagishi

1. 서론

최근 신경망 기반 음성 합성 기술은 대규모 고품질 코퍼스를 이용하면 사람과 구분이 어려운 자연스러운 음성을 생성한다. 그러나 다수의 화자를 대상으로 시스템을 구축하려면 각각의 화자마다 충분한 데이터가 필요하므로 비용이 크게 증가한다. 데이터가 부족한 상황에서는 여러 화자의 데이터를 결합해 다중화자 모델을 학습하는 것이 일반적이며, 기존 연구에서는 화자별 데이터 양이 대체로 균형을 이루는 경우에 좋은 성능을 보고했다. 본 논문은 화자별 데이터 양이 크게 차이 나는 ‘불균형 코퍼스’를 대상으로, 어떤 학습 전략이 가장 효율적인지를 체계적으로 조사한다.

2. 관련 연구 및 배경

클래스 불균형 문제를 해결하기 위한 오버샘플링, 언더샘플링, SMOTE 등 다양한 기법이 분류 문제에서 활용되어 왔다. 음성 합성에서도 데이터 불균형을 완화하기 위해 데이터 선택, 필터링, 다중화자 학습 등이 제안되었지만, 다수와 소수 화자 간 데이터 비율이 크게 차이날 때 최적의 전략은 명확히 규명되지 않았다. 또한 앙상블 학습은 여러 모델의 예측을 결합해 성능을 향상시키는 방법으로, 음성 인식 분야에서 성공적으로 적용된 바 있다.

3. 방법론

3.1 다중화자 모델 설계

기존 연구와 동일한 자동회귀 신경망을 사용한다. 입력 언어학적 특징(265 차원)과 화자 식별을 위한 10‑차원 원‑핫 벡터를 결합해 첫 은닉층에 화자‑특정 바이어스를 추가한다. 이 구조는 대부분의 파라미터를 공유하면서도 화자별 특성을 반영한다.

3.2 데이터 샘플링 전략

- UN(Under‑sampling): 다수 화자의 데이터를 감소시켜 모든 화자가 동일한 발화 수(735개)만 사용.

- OV(Over‑sampling): 소수 화자의 데이터를 복제해 모든 화자가 동일한 발화 수(8,750개)로 맞춤.

- E1·E2·E3: 각 화자당 3,000개의 발화를 무작위로 복제·샘플링해 세 개의 독립적인 서브코퍼스를 생성.

- MU: 원본 전체 데이터(32,076개) 그대로 사용.

3.3 앙상블 모델(EN)

세 개의 서브모델(E1, E2, E3)을 각각 위의 샘플링 코퍼스로 학습한다. 합성 단계에서 MGC는 세 모델의 출력 평균을, F0는 보팅 후 평균을 취한다. 이 비파라메트릭 결합은 구현이 간단하면서도 서브모델 간 다양성을 활용한다.

4. 실험 설정

- 데이터: 일본어 여성 화자 10명, 각 화자당 1,000~10,000개의 발화.

- 특징: 60‑차원 MGC, 511‑bin 양자화 F0(비음성 프레임은 별도 플래그).

- 모델: SAR(2×512‑FF + 2×256‑BiRNN) → MGC, DAR(2×512‑FF + 256‑BiRNN + 128‑UniRNN) → F0.

- 보코더: 화자‑독립 WaveNet(40 dilated layers, 16 kHz, 10‑bit µ‑law).

5. 결과

5.1 객관적 평가

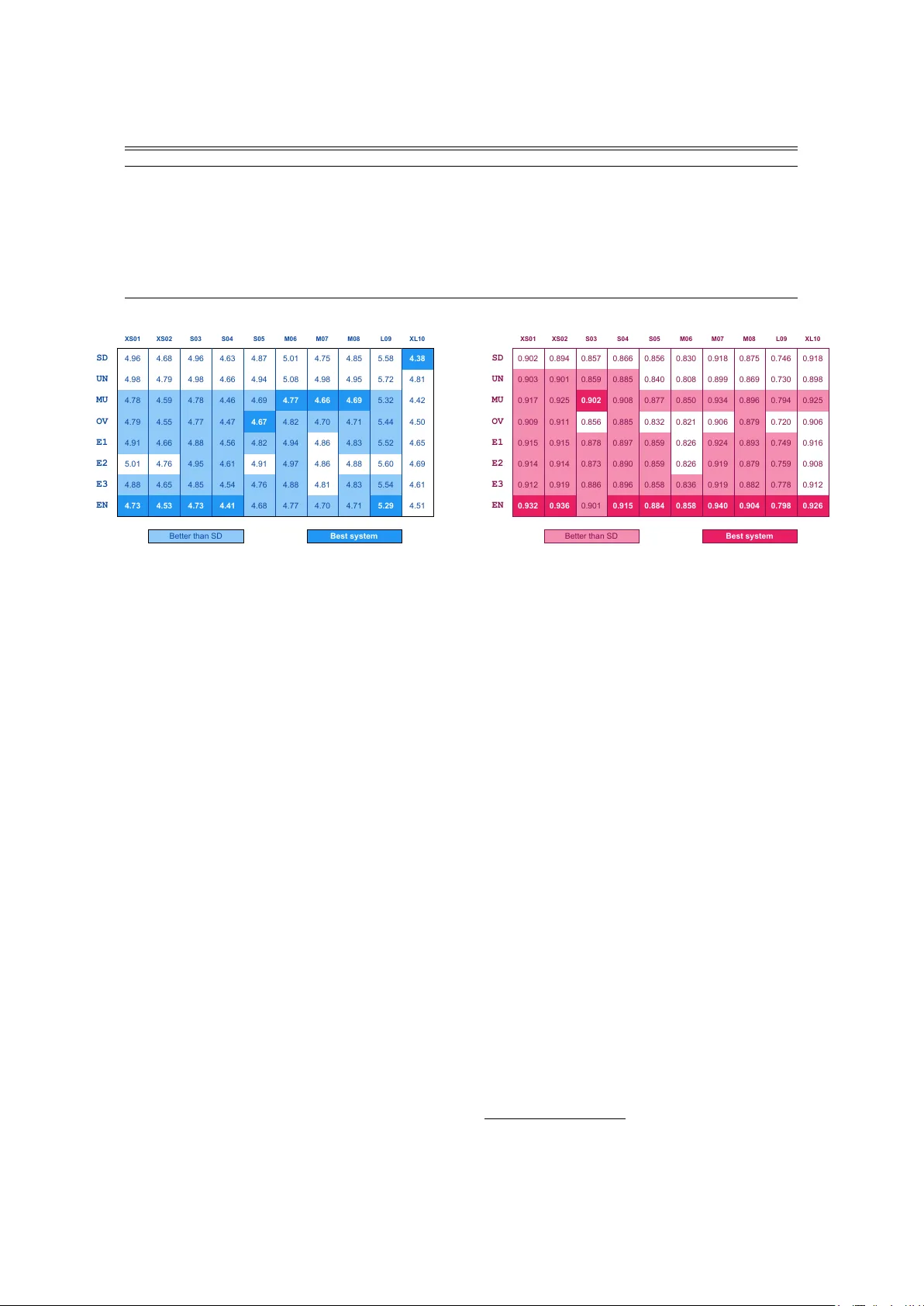

MCD와 F0 상관계수를 화자별로 측정했다. MU는 대부분의 화자에서 SD보다 낮은 MCD와 높은 F0 상관을 기록했으며, 특히 데이터가 적은 XS01에서 큰 개선을 보였다. OV는 전체적으로 개선했지만 다수 화자에서는 F0 상관이 다소 감소했다. E1·E2·E3는 MU보다는 못했지만 SD보다 우수했다. EN은 세 서브모델을 평균화함으로써 가장 낮은 MCD(전반적으로 0.02~0.04 정도 개선)와 가장 높은 F0 상관을 달성했다.

5.2 주관적 평가

AB 선호 테스트를 175명의 청취자(997세션)에게 진행했다. MU vs SD에서는 MU가 통계적으로 유의미하게 선호되었으며, EN vs SD, EN vs MU에서도 EN이 대부분의 화자에서 유의미하게 우수했다. 특히 저자원 화자(XS01, XS02)에서 EN의 선호도가 크게 높았다. 다만 M07 화자에서는 MU가 EN보다 약간 우수한 결과가 나왔다.

5.3 비용 분석

EN은 세 개의 모델을 동시에 유지·추론해야 하므로 파라미터 수와 연산량이 3배 증가한다. 그러나 품질 향상이 크게 나타나는 화자(특히 저자원 화자)에서는 이 비용이 정당화될 수 있다.

6. 논의 및 결론

- 전체 데이터를 그대로 결합한 MU는 가장 간단하면서도 대부분의 경우에 SD보다 우수한 기본 전략이다.

- 오버샘플링은 전체 성능을 끌어올리지만, 다수 화자에서 F0 정확도가 떨어지는 부작용이 있다.

- 앙상블(EN)은 서브모델 간 다양성을 활용해 특히 데이터가 부족한 화자에 대해 큰 품질 향상을 제공한다.

- 향후 연구는 서브모델의 구조적 다양성(예: 다른 네트워크 깊이, 다른 입력 특징)이나 자동 샘플링 비율 최적화, 그리고 파라미터 공유 방식을 도입해 EN의 효율성을 높이는 방향으로 진행될 수 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기