머신러닝 기반 시스템 보안 학습 추론 단계의 위협과 과제

초록

본 논문은 사이버‑물리 시스템에서 머신러닝이 차지하는 비중이 커짐에 따라 발생하는 새로운 보안 위협을 정리하고, 학습 단계와 추론 단계에서 나타나는 공격 유형·위협 모델을 제시한다. LeNet과 VGGNet을 이용해 MNIST와 GTSRB 데이터셋에 대한 실험을 통해 데이터 중독, 백도어, 회피 공격 등을 시연하고, 학습 과정에서 정확도 저하가 거의 없는 새로운 저영향 공격을 제안한다. 마지막으로 현재 연구의 난관과 방어 기술 동향을 논의한다.

상세 분석

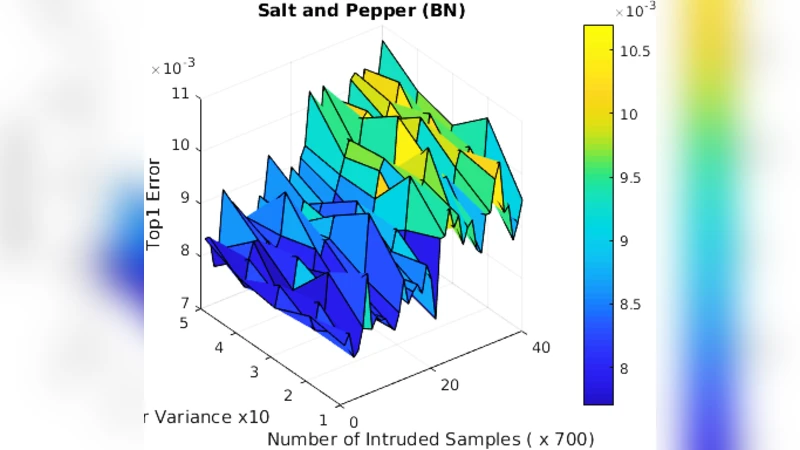

논문은 머신러닝 기반 시스템이 데이터 양의 폭발적 증가와 실시간 처리 요구에 대응하기 위해 핵심 인프라로 자리 잡음에 따라, 기존의 방화벽·IDS와 같은 전통적 보안 메커니즘으로는 탐지·방어가 어려운 새로운 위협 표면이 형성된다고 지적한다. 위협 모델은 크게 학습(Training) 단계와 추론(Inference) 단계로 구분되며, 각각 데이터 중독(Poisoning), 백도어 삽입(Backdoor), 모델 역공학(Model Extraction) 등으로 세분화된다. 학습 단계에서는 공격자가 훈련 데이터셋에 악의적인 레이블이나 패턴을 주입해 모델 파라미터를 왜곡시키는 것이 핵심이며, 이는 모델이 정상 데이터에 대해 높은 정확도를 유지하면서도 특정 트리거 입력에 대해 오작동하도록 만든다. 논문은 LeNet을 MNIST에, VGGNet을 GTSRB에 적용해 라벨 변조와 트리거 삽입을 수행했으며, 결과적으로 목표 라벨에 대한 성공률이 90% 이상이면서 전체 정확도 저하가 1% 미만에 그치는 저영향 공격을 구현했다.

추론 단계에서는 적대적 예제(Adversarial Example) 생성이 주요 위협이다. 작은 노이즈를 가해도 고차원 특성 공간에서 경계가 얇아져 모델이 오분류하게 된다. 또한, 모델 스틸링(Model Stealing) 공격을 통해 공격자는 API 호출만으로도 원본 모델의 구조와 파라미터를 근사화할 수 있다. 논문은 이러한 공격이 하드웨어 가속기(예: FPGA, ASIC)와 결합될 경우, 전력·시간 측면에서 탐지 회피가 더욱 용이해진다는 점을 강조한다.

보안 대책으로는 데이터 검증·샘플링, 견고한 학습(Robust Training) 기법, 모델 압축 시 발생하는 정보 손실을 이용한 방어, 그리고 하드웨어 수준에서의 무결성 검증이 제시된다. 그러나 논문은 현재 방어 기술이 공격자의 적응형 전략에 비해 뒤처져 있으며, 특히 저영향 공격처럼 정확도 손실을 최소화한 경우 기존 방어 메커니즘이 거의 무력화된다는 한계를 지적한다. 따라서 공격·방어의 공생적 연구가 필요하고, 표준화된 위협 모델링과 실험 재현성을 확보하는 것이 향후 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기