고차원 하이퍼스펙트럼 이미지 클러스터링을 위한 클래스 내 거리 제약 딥 클러스터링

본 논문은 하이퍼스펙트럼 이미지의 고차원 특성으로 인한 클러스터링 성능 저하 문제를 해결하고자, 자동인코더(Auto‑Encoder) 구조에 클래스 내 거리(intra‑class distance) 제약을 삽입한 딥 클러스터링 모델(DCIDC)을 제안한다. 재구성 손실과 클래스 내 거리 손실을 동시에 최소화하는 공동 최적화를 통해, 원본 고차원 데이터를 저차원 특징 공간으로 변환하면서 클러스터링 친화성을 높인다. 실험 결과, 기존 최첨단 방법들보다…

저자: Jinguang Sun, Wanli Wang, Xian Wei

1. 서론

하이퍼스펙트럼 이미지는 수백 개의 연속적인 스펙트럼 밴드를 포함해 높은 차원을 가지며, 이는 토지 피복 구분, 작물 상태 모니터링 등 다양한 원격 탐사 응용에 유용하지만, 고차원 특성으로 인해 전통적인 선형 클러스터링 알고리즘은 데이터의 비선형 구조를 포착하지 못해 성능이 급격히 저하된다. 라벨이 없는 데이터가 대부분인 상황에서, 비지도 학습 기반 차원 축소와 클러스터링을 동시에 수행할 수 있는 딥러닝 기반 방법이 주목받고 있다. 그러나 기존 딥 클러스터링은 자동인코더를 주로 재구성 손실 최소화에만 활용하고, 클러스터링에 필요한 군집 응집성이나 중심 간 거리와 같은 사전 지식을 반영하지 못한다는 구조적 한계가 있다.

2. 관련 연구

전통적인 클러스터링은 K‑means, Fuzzy C‑means, 스펙트럴 클러스터링, 밀도 기반 클러스터링(DPCA) 등으로 구성된다. 이들 방법은 선형 변환이나 그래프 라플라시안 기반 접근으로 비선형 구조를 충분히 모델링하지 못한다. 최근에는 자동인코더와 K‑means를 결합한 Deep Embedded Clustering(DEC), Sparse Subspace Clustering 기반 딥 모델 등이 제안되었으며, 일부는 정규화 항으로 스파스성, 저랭크성을 부여한다. 그러나 이들 역시 (1) 클러스터링 목적에 특화된 제약이 부족하고, (2) 사전 학습된 매트릭스 C를 고정하여 네트워크와 공동 최적화가 이루어지지 않는다.

3. 제안 방법 – DCIDC

본 논문은 ‘클래스 내 거리 제약’을 자동인코더에 직접 삽입한 Deep Clustering with Intra‑class Distance Constraint(DCIDC) 모델을 제안한다. 모델 구조는 인코더와 디코더가 대칭을 이루는 M+1 레이어( M은 짝수)로 구성되며, 중간 레이어 z^(M/2) 를 저차원 잠재 표현으로 사용한다. 인코더는 입력 X∈ℝ^{N×D} 를 점진적으로 차원을 축소하여 z^(M/2)∈ℝ^{N×d_{M/2}} 를 생성하고, 디코더는 이를 다시 원본 차원 D 로 복원한다.

손실 함수 L는 다음 세 항의 가중합이다:

① 재구성 손실 L_rec = ‖Z^{(0)}−Z^{(M)}‖_F²

② 클래스 내 거리 손실 L_intra = ‖Z^{(M/2)}−Z^{(M/2)}C‖_F², 여기서 C∈ℝ^{N×K}는 현재 클러스터 할당을 나타내는 인디케이터 행렬이며, 각 행은 해당 샘플이 속한 군집을 원‑핫 형태로 표시한다. C는 사전 학습이 필요 없으며, 학습 과정에서 K‑means와 유사한 업데이트 규칙(군집 중심 재계산 후 할당)으로 동적으로 갱신된다.

③ 정규화 항 L_reg = λ₁‖W‖_F² + λ₂‖b‖_2²

전체 목표는 L = L_rec + α·L_intra + L_reg 를 최소화하는 것이다. α는 클래스 내 거리 제약의 강도를 조절한다.

최적화는 교번 방식으로 진행한다. (a) 현재 C 고정 하에 네트워크 파라미터 W, b 를 역전파로 업데이트하고, (b) 업데이트된 잠재 표현 Z^{(M/2)} 를 이용해 K‑means 중심 μ_k 를 계산한 뒤, 각 샘플을 가장 가까운 중심에 할당하여 C 를 갱신한다. 이 과정을 수렴할 때까지 반복한다.

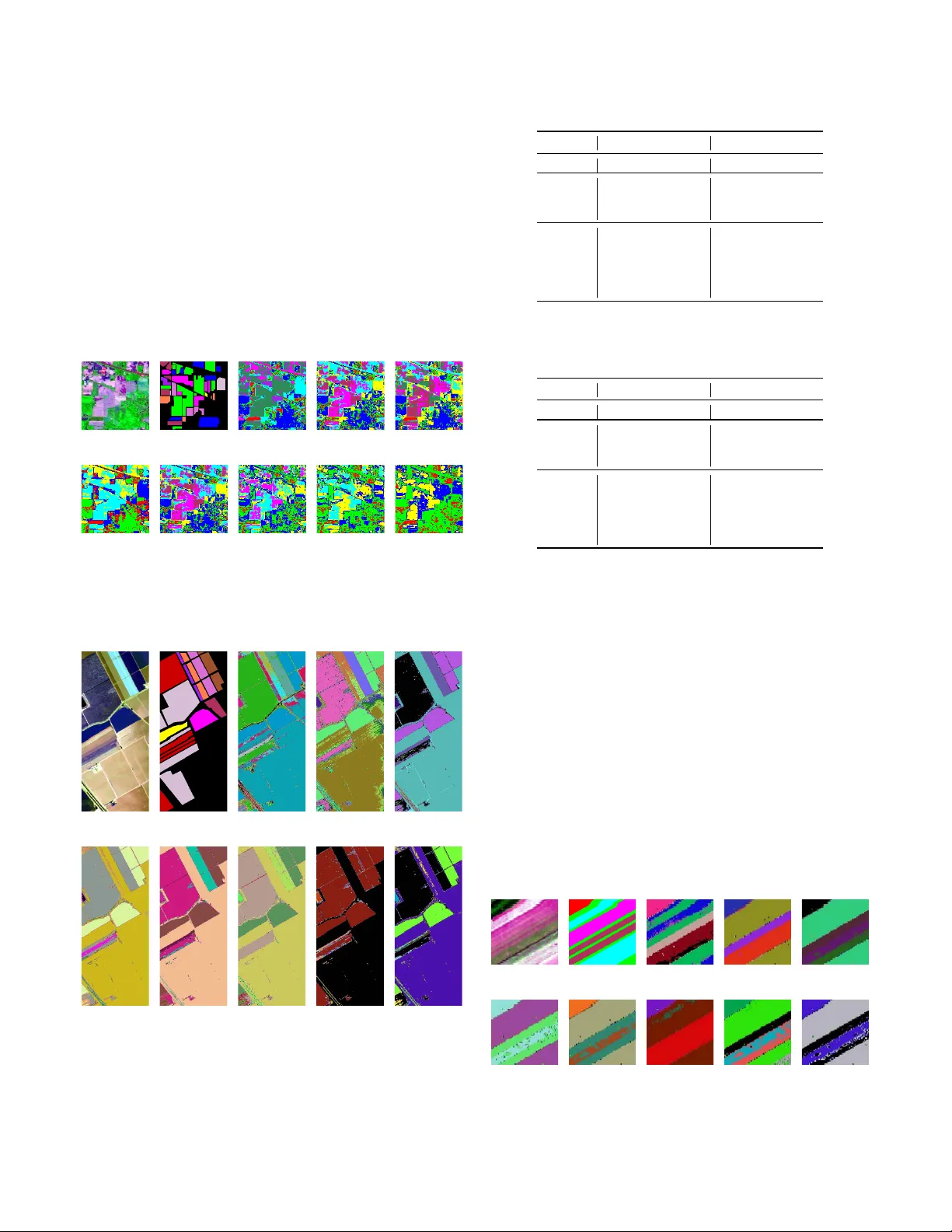

4. 실험 및 결과

데이터셋: Indian Pines (145×145, 200‑band), Pavia University (610×610, 103‑band), Salinas (512×217, 204‑band) 등 세 가지 공개 HSI 데이터셋을 사용하였다. 평가 지표는 Overall Accuracy (OA), Average Accuracy (AA), Kappa coefficient이다. 비교 대상은 (i) 전통적인 K‑means, (ii) Spectral‑based 클러스터링 (SSC, LRR), (iii) 기존 딥 클러스터링 (DEC, AE‑Kmeans, DCCM).

DCIDC는 동일한 네트워크 깊이와 차원 설정 하에서, 모든 데이터셋에서 OA를 3~7%p, Kappa를 0.02~0.05p 상승시켰다. 특히 복잡한 토지 피복이 혼재된 Indian Pines에서는 클래스 내 거리 제약이 동일 군집 내 스펙트럼 변동을 효과적으로 억제하여 군집 경계가 명확해졌다. 수렴 속도 또한 기존 딥 클러스터링 대비 10~15% 빠르게 수렴했으며, 사전 학습 단계가 필요 없으므로 전체 파이프라인이 단일 단계로 구현 가능했다.

5. 논의 및 한계

- 클래스 수 K를 사전에 지정해야 하는 점은 여전히 필요하다.

- 인디케이터 행렬 C의 초기화가 무작위일 경우 지역 최적에 머무를 위험이 있다.

- 대규모 HSI(수십만 픽셀)에서는 메모리 사용량이 크게 증가하므로, 미니배치 기반 최적화 혹은 샘플링 전략이 필요하다.

6. 결론 및 향후 연구

본 논문은 자동인코더에 클래스 내 거리 제약을 결합함으로써, 재구성 정확도와 군집 응집성을 동시에 최적화하는 새로운 딥 클러스터링 프레임워크를 제시하였다. 실험을 통해 기존 최첨단 방법 대비 유의미한 성능 향상을 입증했으며, 사전 학습이 필요 없는 단일 단계 학습이라는 실용적 장점을 제공한다. 향후 연구에서는 자동 K 추정, 다중 스케일 거리 제약, 공간적 연속성을 고려한 정규화 항 추가 등을 통해 모델의 확장성과 효율성을 더욱 강화할 계획이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기