뇌종양 등급 및 1p/19q 코델리션 예측을 위한 멀티시퀀스 MRI 딥 라디오믹스

본 연구는 다중 시퀀스 MRI 데이터를 이용해 고도(High‑Grade)와 저도(Low‑Grade) 교모세포종을 구분하고, 저도 교모세포종의 1p/19q 코델리션 여부를 자동으로 판별하는 딥러닝 기반 프레임워크를 제안한다. 패치‑단위, 슬라이스‑단위, 다중 평면 볼륨‑단위의 세 가지 입력 형태에 맞춘 PatchNet, SliceNet, VolumeNet을 처음부터 학습시켰으며, ImageNet 사전학습 모델인 VGGNet과 ResNet을 전이학…

저자: Subhashis Banerjee, Sushmita Mitra, Francesco Masulli

본 논문은 뇌종양, 특히 교모세포종의 등급 구분과 저도 교모세포종(LGG)의 1p/19q 코델리션 상태를 비침습적으로 예측하기 위한 딥러닝 기반 프레임워크를 제시한다. 연구 배경으로는 교모세포종이 전체 뇌암의 80%를 차지하고, 등급에 따라 치료 전략과 예후가 크게 달라진다는 점을 들며, 기존 조직생검이 위험하고 샘플링 오류가 발생할 수 있기에 MRI와 같은 비침습적 영상이 중요한 대안이 된다. 그러나 전통적인 라디오믹스 접근법은 ROI(Region of Interest) 혹은 VOI(Volume of Interest)를 수동 혹은 반자동으로 분할하고, 수백 개의 손수 설계된 텍스처·형태·강도 특징을 추출한 뒤, 별도의 차원 축소·선택 과정을 거쳐 머신러닝 분류기에 입력한다는 복잡한 파이프라인을 필요로 한다. 이러한 과정은 도메인 전문지식에 크게 의존하고, 인간 편향과 재현성 문제를 야기한다.

이에 저자들은 ‘딥 라디오믹스’를 도입해, 원시 다중 시퀀스 MRI(전처리된 T1‑post‑contrast, T2, FLAIR 등)를 그대로 ConvNet에 입력함으로써 특징 추출과 분류를 하나의 엔드‑투‑엔드 모델로 통합한다. 데이터는 TCGA‑GBM(고도 교모세포종)과 TCGA‑LGG(저도 교모세포종)에서 확보했으며, 각 환자마다 4채널(시퀀스) 3D 볼륨을 정규화하였다. 입력 형태는 세 가지로 구분한다. ① 패치‑기반: 종양 영역을 64×64×64 픽셀 크기의 3D 패치로 추출, 작은 영역에 집중해 학습 효율을 높임. ② 슬라이스‑기반: 전체 뇌를 축, 관상, 시상 2D 슬라이스로 사용해 종양 위치 추정 능력을 부여. ③ 볼륨‑기반: 다중 평면(축·관상·시상) 3D 볼륨을 결합해 전체 뇌 구조와 종양 주변 조직을 동시에 학습. 각각에 맞춰 PatchNet, SliceNet, VolumeNet이라는 맞춤형 ConvNet을 설계했으며, 모두 5~7개의 컨볼루션 레이어와 배치 정규화·드롭아웃을 포함한다.

학습은 Stochastic Gradient Descent(SGD) with learning rate = 0.001, momentum = 0.9, 배치 크기 = 32로 진행했으며, 20%를 검증 셋으로 활용해 조기 종료와 과적합 방지를 수행했다. 데이터 증강으로는 회전(±10°), 평행 이동, 좌우·상하 뒤집기 등을 적용해 실제 환자 수가 제한적인 상황에서도 모델이 일반화될 수 있도록 했다. 전이학습 실험으로는 ImageNet 사전학습 VGGNet(16‑layer)과 ResNet(50‑layer)를 3채널 MRI(채널 합성) 형태로 입력하고, 마지막 Fully‑Connected 레이어만 재학습했다.

성능 평가는 두 가지 방식으로 수행했다. 첫째, Leave‑One‑Patient‑Out(LOPO) 교차검증으로 각 환자를 한 번씩 테스트 셋에 두고 나머지 환자를 학습에 사용해 환자 수준의 일반화 능력을 측정했다. 둘째, 독립 hold‑out 테스트 셋을 별도로 확보해 최종 모델의 실제 적용 가능성을 검증했다. 평가 지표는 정확도(Accuracy)와 F1‑Score이며, 데이터 불균형을 고려해 F1‑Score를 주요 지표로 삼았다.

결과는 다음과 같다. VolumeNet이 가장 높은 성능을 보였으며, LOPO에서 94.8% 정확도와 0.94 F1‑Score, hold‑out 테스트에서 95% 정확도와 0.96 F1‑Score를 기록했다. PatchNet과 SliceNet도 각각 90%대의 정확도를 달성했지만, 볼륨 정보를 활용하지 못해 약간 낮은 성능을 보였다. 전이학습 모델인 VGGNet과 ResNet은 초기 수렴이 빠르고 85~88% 수준의 정확도를 보였으나, 멀티채널 MRI 특성에 최적화되지 않아 VolumeNet에 비해 2~3% 낮았다.

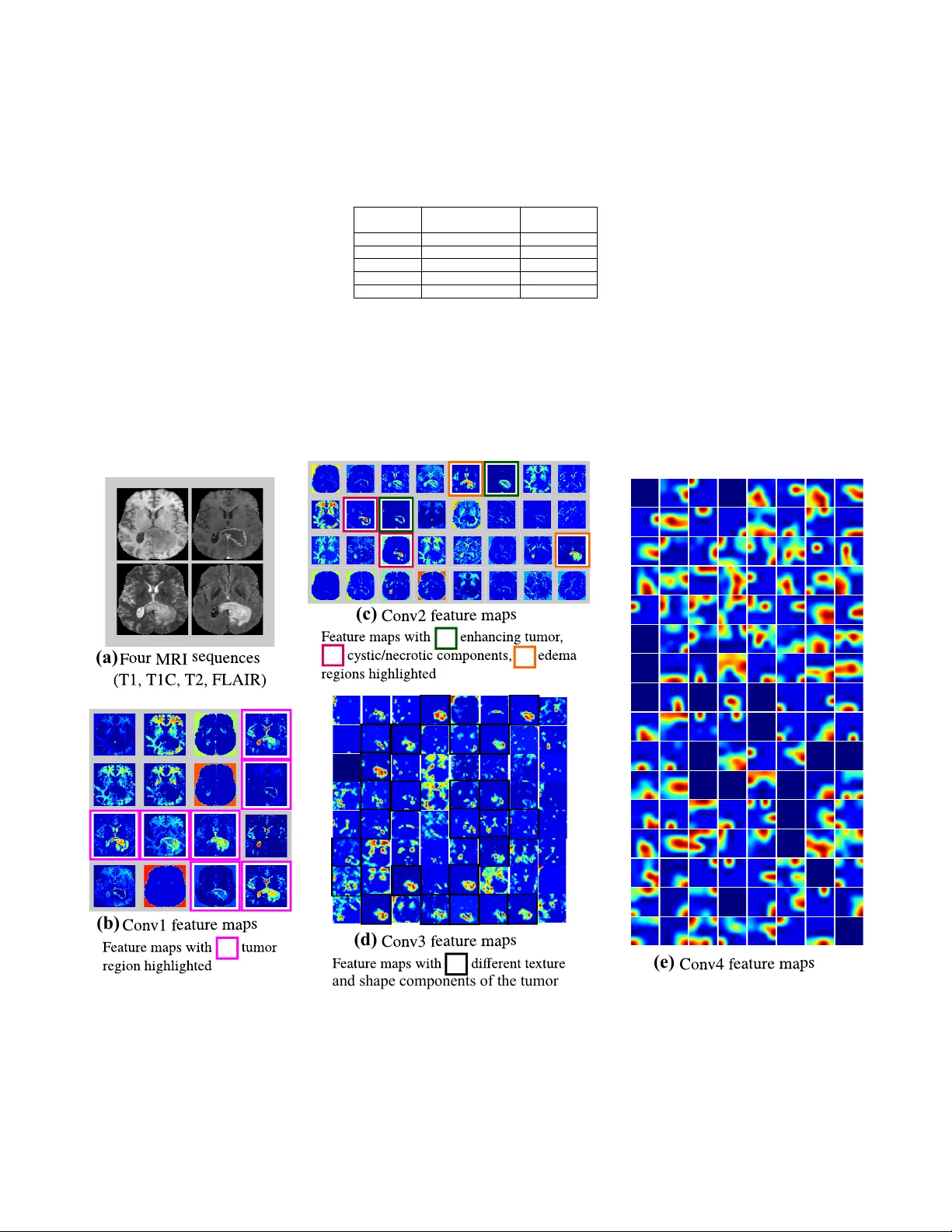

또한, 저자들은 중간 레이어 활성화 맵을 시각화해 네트워크가 종양 경계, 혈관 구조, 백질·회백질 대비 등 의학적으로 의미 있는 패턴을 자동으로 학습함을 확인했다. 초기 레이어는 에지와 텍스처를, 깊은 레이어는 종양 내부 이질성 및 주변 부종을 강조하는 특징을 포착한다는 점에서, 기존 라디오믹스에서 손수 설계하던 특징과 유사한 정보를 자체적으로 추출한다는 결론을 내렸다.

1p/19q 코델리션 예측 실험에서도 동일한 VolumeNet 구조를 적용했으며, LGG 환자 159명(코델리션 102명, 비코델리션 57명) 데이터를 3D 슬라이스로 변환해 학습·검증했다. 결과는 97% 정확도와 0.97 F1‑Score로, 기존 87~90% 수준을 크게 상회했다.

논문의 주요 기여는 다음과 같다. (1) 다중 시퀀스 MRI를 직접 입력으로 하는 딥 라디오믹스 프레임워크 제시, (2) 수동 ROI/VOI 분할 및 특징 추출 없이 등급 및 분자 마커를 자동 예측, (3) PatchNet·SliceNet·VolumeNet이라는 세 가지 스케일 맞춤형 ConvNet 설계, (4) 전이학습을 통한 기존 사전학습 모델의 MRI 적용 방법론 제시, (5) 모델 내부의 학습된 필터 시각화를 통해 의료 영상에서 의미 있는 패턴을 자동 학습함을 입증.

한계점으로는 데이터가 TCGA에 국한돼 다기관·다스캐너 환경에서의 검증이 부족하고, 1p/19q 라벨이 상대적으로 적은 LGG 서브셋에만 적용됐다는 점을 들 수 있다. 또한, 현재 모델은 등급·코델리션 예측에 초점을 맞추었으며, 실제 임상에서 요구되는 종양 영역 정확한 세그멘테이션이나 수술 계획 지원까지는 포함되지 않는다.

향후 연구 방향은 (1) 다기관·다스캐너 데이터셋을 포함한 대규모 멀티센터 검증, (2) 세그멘테이션·위치 추정 모듈을 통합한 end‑to‑end 파이프라인 구축, (3) 다른 분자 마커(예: IDH 변이)와의 다중 라벨 예측 모델 확장, (4) 모델 설명 가능성 및 의사결정 지원을 위한 시각화·해석 기법 강화 등이 있다. 이러한 발전을 통해 딥 라디오믹스가 뇌종양 진단·치료 계획에 실질적인 보조 도구로 자리매김할 수 있을 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기