야생 환경에서의 안와 주변 인식: RGB와 색채 기반 텍스처를 결합한 듀얼 스트림 CNN

본 논문은 RGB 이미지와 새롭게 제안한 색채 기반 텍스처 기술인 Orthogonal Combination‑Local Binary Coded Pattern(OC‑LBCP)을 동시에 입력으로 받는 듀얼 스트림 CNN을 설계하고, 두 개의 late‑fusion 레이어(max, sum)를 통해 특징을 통합한다. 또한 다양한 인종을 포함한 야생 환경 이미지로 구성된 Ethnic‑ocular 데이터셋을 공개하고, UBIPr 데이터셋과 비교 실험을 수행해…

저자: Leslie Ching Ow Tiong, Andrew Beng Jin Teoh, Yunli Lee

본 논문은 ‘야생 환경’에서의 안와 주변(퍼리오큘러) 인식 문제를 해결하기 위해 두 가지 주요 기술을 제안한다. 첫 번째는 색채 기반 텍스처 디스크립터인 Orthogonal Combination‑Local Binary Coded Pattern(OC‑LBCP)이며, 두 번째는 RGB 이미지와 OC‑LBCP를 동시에 입력받아 late‑fusion을 수행하는 듀얼 스트림 Convolutional Neural Network(dual‑stream CNN)이다.

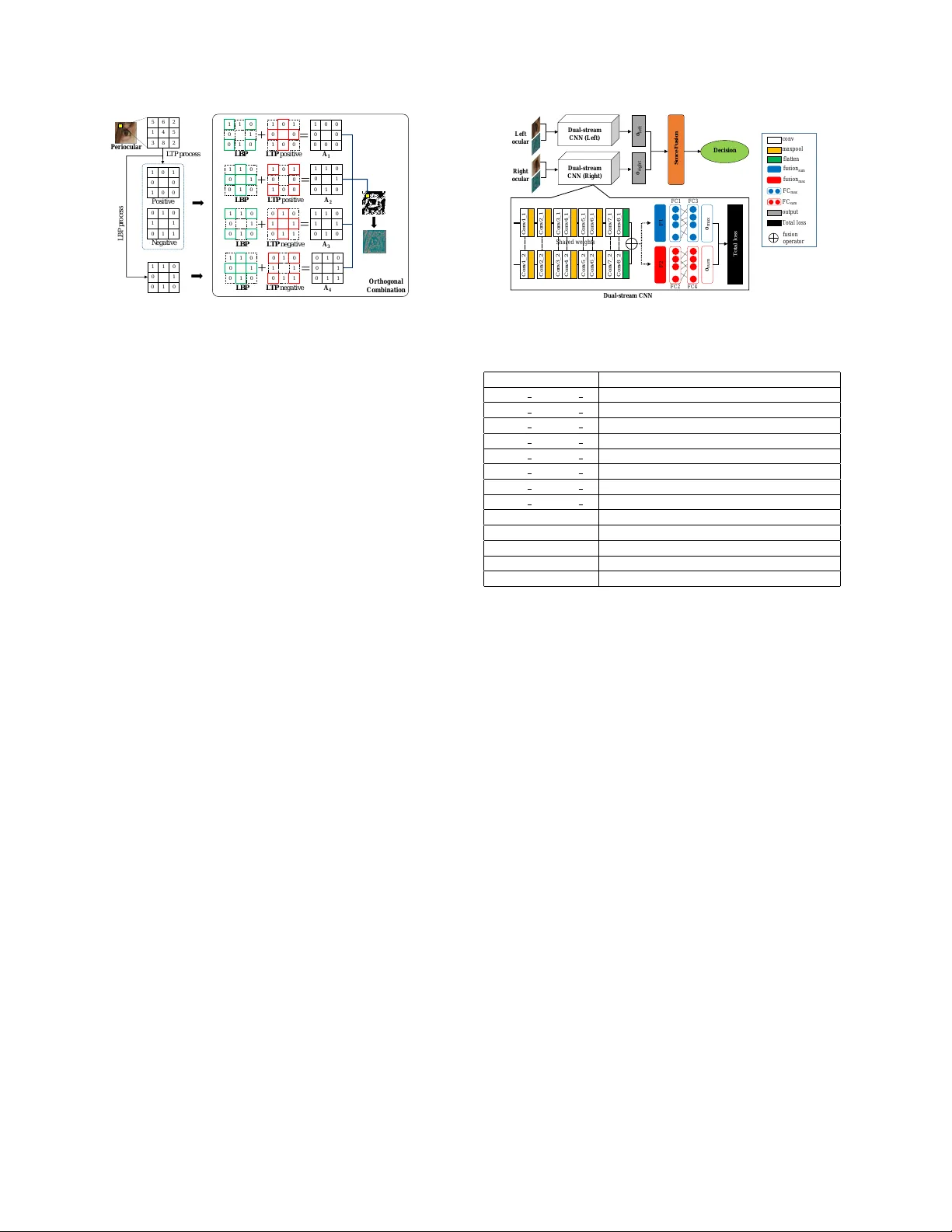

OC‑LBCP는 기존 Local Binary Pattern(LBP)과 Local Ternary Pattern(LTP)을 결합해 만든다. LBP는 3×3 이웃 픽셀을 중심 픽셀과 비교해 8비트 이진 코드를 생성하고, LTP는 동일 이웃을 세 단계(양·음·중립)로 구분해 두 개의 이진 패턴(양·음)으로 변환한다. 저자들은 LTP의 양·음 이진 패턴과 LBP 코드를 교차 선택해 네 개의 직교 조합(A1~A4)을 만든 뒤, 각 픽셀에서 가장 큰 바이너리 값을 선택해 최종 OC‑LBCP 코드를 만든다. 이렇게 얻은 코드는 색채 정보를 반영하기 위해 Earth Mover’s Distance 기반 색상 패턴 매트릭스와 다차원 스케일링(MDS)으로 3차원 색공간에 매핑된다. 이 과정은 조명 변화와 잡음에 대한 강인성을 높이며, 기존 흑백 텍스처 디스크립터가 놓치기 쉬운 색채 차이를 포착한다.

다음으로 제안된 듀얼 스트림 CNN은 두 개의 입력 스트림—RGB와 OC‑LBCP—을 동일한 구조의 합성곱 블록에 통과시키면서 모든 가중치를 공유한다. 각 블록은 두 개의 합성곱 레이어와 max‑pool 레이어로 구성되며, 총 8개의 블록이 연속된다. 마지막 합성곱 레이어 뒤에서 flatten된 두 특징 맵(F1, F2)은 각각 max‑fusion 레이어와 sum‑fusion 레이어에 전달된다. max‑fusion은 두 스트림 중 더 큰 활성값을 선택하고, sum‑fusion은 두 활성값을 합산한다. 두 fusion 결과는 별도의 완전 연결(FC) 레이어를 거쳐 각각 softmax 출력(y_max, y_sum)을 만든다. 전체 손실 함수는 두 softmax에 대한 cross‑entropy 손실을 합산한 형태이며, 이는 모델이 두 fusion 경로 모두에서 최적화를 수행하도록 유도한다.

학습은 TensorFlow 기반으로 진행되며, 초기 학습률 1e‑3에서 10 epoch마다 0.1배씩 감소시켜 최소 1e‑5까지 학습한다. Adam 옵티마이저와 weight decay 5e‑4, momentum 0.9를 사용하고, 배치 크기 64, 총 200 epoch 동안 NVIDIA Titan Xp GPU에서 훈련한다.

데이터 측면에서 저자들은 기존 퍼리오큘러 데이터셋이 인종 다양성 및 야생 환경을 충분히 반영하지 못한다는 점을 지적하고, 새로운 Ethnic‑ocular 데이터셋을 구축했다. 이 데이터셋은 FaceScrub, BBC News, CNN News, Naver News 등에서 수집한 1,034명의 인물에 대해 85,394장의 좌·우 안구 이미지(80×80 픽셀)를 포함한다. 인종은 아프리카, 아시아, 라틴 아메리카, 중동, 백인 5가지로 균등하게 배분했으며, 이미지들은 조명, 포즈, 해상도, 안경·메이크업·마스크 등 다양한 변수를 포함한다. 훈련‑테스트 분할은 623명 훈련, 411명 테스트이며, 테스트에서는 갤러리와 프로브를 1:1 비율로 50%씩 나누어 3회 반복한다.

실험에서는 제안 모델을 Ethnic‑ocular와 공개된 UBIPr 데이터셋에 적용해 기존 딥러닝 기반 방법들과 비교했다. 성능 평가는 Cumulative Matching Characteristic(CMC) 곡선과 Rank‑1 정확도로 측정했다. 결과는 다음과 같다. 단일 스트림 CNN(RGB)만 사용했을 때 Rank‑1 정확도는 80.8%±1.4%, OC‑LBCP만 사용했을 때는 66.6%±2.2%에 그쳤다. 두 스트림을 결합했지만 가중치를 공유하지 않은 모델은 82.1%±1.6%를 기록했고, 제안한 가중치 공유 + 두 단계 late‑fusion 구조는 85.0%±1.9%로 가장 높은 정확도를 달성했다. 또한 UBIPr 데이터셋에서도 AlexNet, VGG‑16, FaceNet, LCNN‑29, DeepIrisNet‑A/B, Multi‑abstract fusion CNN 등 7개 베이스라인을 모두 앞섰으며, 특히 조명·포즈 변동이 큰 ‘야생’ 이미지에서 성능 격차가 두드러졌다.

이러한 결과는 색채 기반 텍스처와 RGB 정보를 효과적으로 결합함으로써, 전통적인 색상·형태 정보가 서로 보완되는 메커니즘을 확인시켜준다. 파라미터 공유와 두 단계의 late‑fusion 설계는 모델 복잡도는 크게 증가시키지 않으면서도 일반화 성능을 크게 향상시킨다. 저자들은 향후 연구로 OC‑LBCP를 다른 바이오메트릭(홍채, 얼굴)과 결합하거나, attention 메커니즘을 도입해 스트림 간 가중치를 동적으로 조정하는 방안을 제시하고 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기