보이지 않는 장애물 거리 추정: 2D 레이저 데이터로 로봇 시야 확장

초록

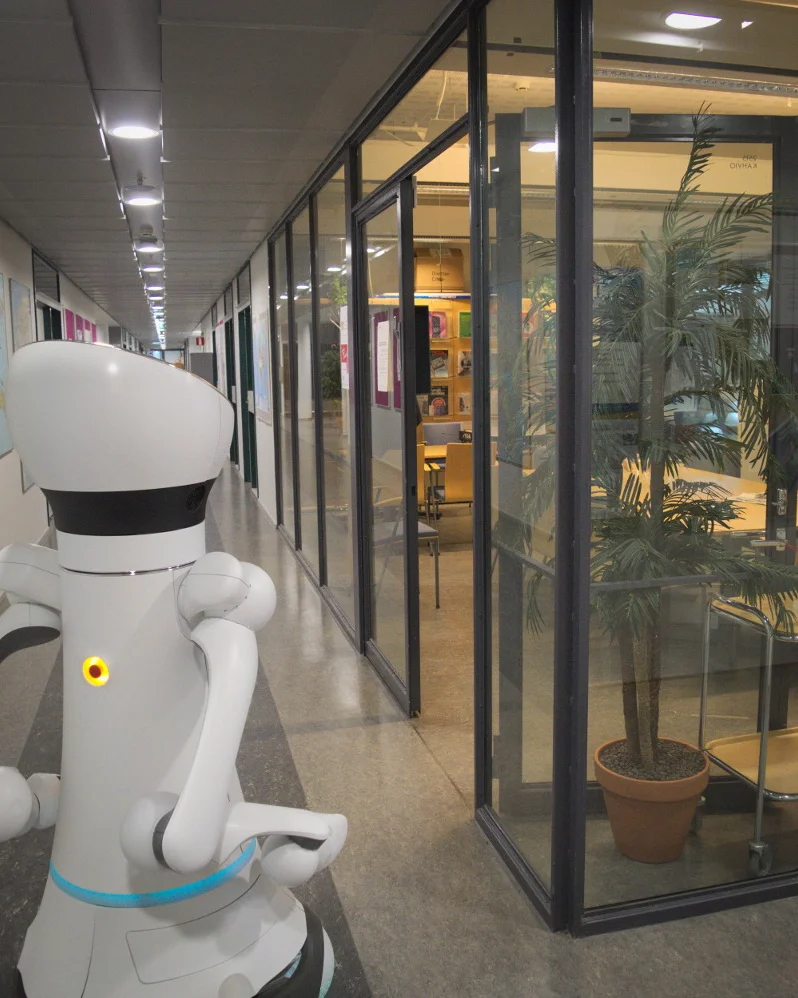

본 논문은 2D 레이저 스캔만으로 유리판·테이블 등 레이저가 감지하지 못하는 장애물까지의 실제 충돌 거리를 추정하는 방법을 제안한다. 완전합성곱(auto‑encoder) 신경망에 스킵 연결, γ‑스케일링, RMSLE 손실을 적용하고, 깊이 카메라와 레이저 데이터를 융합해 만든 라벨을 이용해 학습한다. 실험은 Care‑O‑bot 4에서 수행했으며, 실시간으로 보이지 않는 장애물을 “환각”해 보여준다.

상세 분석

이 연구는 기존 2D 레이저가 제공하는 거리 정보가 로봇 높이와 동일한 평면에 존재하는 물체만을 반영한다는 한계를 인식하고, 레이저가 놓치는 상부 구조물(유리, 테이블 상판 등)의 충돌 위험을 보완하고자 한다. 핵심 아이디어는 레이저 스캔을 입력으로, 실제 충돌 가능 거리(로봇‑to‑obstacle distance)를 출력으로 매핑하는 지도학습 문제로 전환하는 것이다. 이를 위해 저자들은 1‑D 완전합성곱(auto‑encoder) 구조를 설계했으며, 네트워크는 128 차원의 입력을 4개의 컨볼루션‑배치정규화‑ReLU 블록을 거쳐 잠재 공간(z)으로 압축하고, 대칭적인 디컨볼루션 블록을 통해 동일 차원의 출력 ˆy를 복원한다.

특히 두 가지 설계 선택이 주목할 만하다. 첫째, 스킵 연결을 통해 인코더와 디코더의 동일 레이어 출력을 직접 더함으로써 고주파 디테일이 손실되지 않게 하고, 역전파 흐름을 개선한다. 이는 레이저 데이터가 갖는 급격한 거리 변화를 보존하는 데 유리하다. 둘째, 출력에 γ‑스케일링을 적용해 작은 거리 영역에 더 높은 해상도를 할당한다. γ>1이면 ˆy₀에 비선형 확대가 가해져 0~2 m 구간에서 정밀도가 크게 향상된다. 이는 로봇 안전에 핵심적인 근거리 오류를 최소화하려는 목적과 일치한다.

손실 함수로는 RMSLE(Root Mean Squared Logarithmic Error)를 채택했는데, 이는 로그 변환을 통해 큰 거리 오차가 전체 손실에 과도히 기여하는 것을 억제한다. γ‑스케일링과 손실 함수의 조합은 작은 거리에서의 정밀도 향상을 효과적으로 지원한다.

데이터 라벨링은 혁신적으로 수행되었다. 로봇에 장착된 RGB‑D 카메라의 깊이 이미지를 1‑D 거리 프로파일로 변환하고, 레이저 스캔과 동일한 시야(≈90°)로 제한한 뒤, 각 방향에서 레이저와 카메라 중 최소 거리를 선택해 y를 만든다. 이렇게 하면 수동 라벨링 없이도 “보이는 레이저 거리”와 “보이는 깊이 거리” 중 더 보수적인 값을 ground‑truth 로 사용할 수 있다.

학습에는 입력에 σₙ=0.02 m 표준편차의 가우시안 노이즈를 추가하는 데이터 증강을 적용했으며, 이는 레이저 센서의 본래 해상도와 일치한다. 실험 결과, 스킵 연결과 γ‑스케일링, 노이즈 증강이 각각 RMSE와 MAE를 유의하게 감소시켰으며, 특히 근거리(0‑2 m)에서 오류가 크게 줄어들었다.

실시간 테스트는 Care‑O‑bot 4에 구현되어, 레이저가 놓친 유리문, 테이블 상판 등을 빨간 선으로 “환각”해 보여준다. 시스템은 30 Hz 레이저 주사율에 맞춰 실시간으로 추론하며, 기존 레이저 데이터에 추가적인 안전 정보를 제공한다.

전체적으로 이 논문은 2D 레이저만을 이용해 보이지 않는 장애물까지 인식하도록 하는 데이터‑드리븐 접근법을 제시하며, 네트워크 설계와 라벨링 방법론, 손실 함수 선택까지 실용적인 세부 사항을 체계적으로 검증한다. 향후 다중 환경 확장과 다른 로봇 플랫폼 적용이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기