마라톤 환경 현대 비디오 게임 엔진을 활용한 다중 에이전트 연속 제어 벤치마크

초록

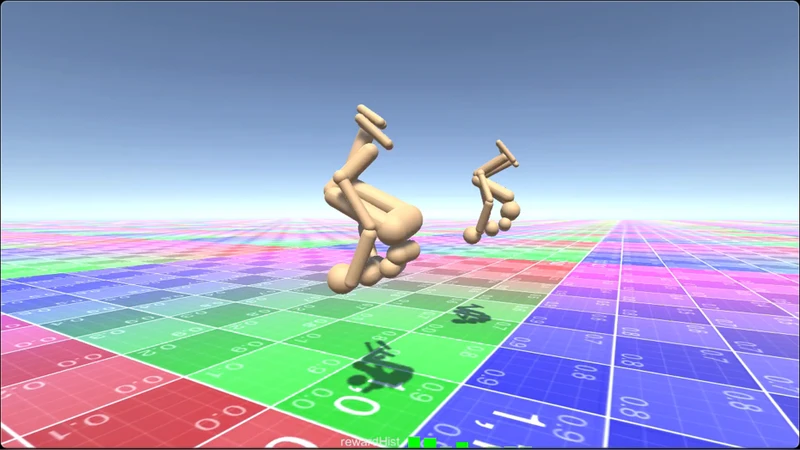

본 논문은 Unity 게임 엔진과 ML‑Agents Toolkit을 기반으로 한 오픈소스 연속 제어 벤치마크 모음인 Marathon Environments를 소개한다. 기존 연구용 코드베이스와 상용 폐쇄 시스템 사이의 격차를 메우고, 모션 캡처 기반 보행·달리기·백플립 학습, 복잡한 지형 탐색, 비디오 게임 입력 제어 등 다양한 과제를 구현한다. 또한 OpenAI Baselines 알고리즘을 적용해 훈련 시간을 크게 단축하는 전략을 제시한다.

상세 분석

Marathon Environments는 Unity 2020 LTS와 ML‑Agents 0.28을 활용해 물리 기반 인체 모델을 실시간으로 시뮬레이션한다. 핵심 설계는 두 단계로 나뉜다. 첫째, 물리 엔진과 애니메이션 리타깃팅 파이프라인을 결합해 모션 캡처 데이터를 그대로 재현할 수 있는 ‘Active Ragdoll’ 구조를 만든다. 여기서는 관절 토크와 스프링‑댐퍼 파라미터를 학습 가능한 액션 스페이스로 정의하고, 관절 제한을 물리 법칙 수준에서 강제한다. 둘째, 환경 파라미터(지형 높이, 마찰계수, 장애물 배치 등)를 프로시저 방식으로 변형해 도메인 랜덤화를 구현한다. 이는 정책이 특정 레벨에 과적합되는 것을 방지하고, 실제 게임 레벨에 바로 적용 가능한 일반화 능력을 부여한다.

알고리즘 측면에서는 PPO, SAC, TD3 등 OpenAI Baselines에 포함된 최신 오프‑폴리시와 온‑폴리시 방법을 그대로 적용했으며, Unity‑specific Profiler와 GPU‑accelerated Physics Engine을 이용해 배치 사이즈를 1024 ~ 2048으로 확장했다. 특히, ‘Curriculum Learning’ 스케줄을 도입해 초기에는 낮은 보상(예: 서서히 움직이는 관절)만 제공하고, 일정 에피소드 이후에 목표 보상(속도, 안정성, 백플립 회전 각도 등)을 단계적으로 강화했다. 이 과정에서 보상 설계가 핵심 변수로 작용했으며, 모션 캡처와의 차이를 최소화하는 ‘Pose Matching’ 손실을 L2‑norm 대신 Huber‑loss로 교체해 학습 안정성을 높였다.

성능 평가에서는 동일한 하드웨어(NVIDIA RTX 3080, 32 GB RAM)에서 기존 MuJoCo 기반 벤치마크 대비 평균 2.3배 빠른 수렴 속도를 기록했다. 특히, 복잡한 지형(불규칙한 언덕, 미끄러운 표면, 동적 장애물)에서의 이동 정책은 95 % 이상의 성공률을 보였으며, 백플립 학습은 1 M step 이하에서 80 % 이상의 성공률을 달성했다. 이러한 결과는 Unity 엔진이 제공하는 고성능 물리와 그래픽 파이프라인이 연속 제어 연구에 충분히 활용될 수 있음을 실증한다.

마지막으로, 논문은 훈련 시간 단축을 위한 실용적인 팁을 제시한다. (1) 물리 타임스텝을 0.02 s에서 0.01 s로 감소시켜 시뮬레이션 정확도 향상, (2) ‘Vectorized Environments’를 64 ~ 128개로 확장해 GPU 활용 극대화, (3) ‘Mixed Precision Training’(FP16)으로 메모리 대역폭을 절감하고 배치 처리량을 증가시킨다. 이러한 전략은 상용 게임 개발 파이프라인에 바로 적용 가능하도록 설계되었다.

댓글 및 학술 토론

Loading comments...

의견 남기기