프레임 수준 악기 인식을 위한 멀티태스크 학습

초록

본 논문은 합성 멀티트랙 음악 데이터셋(MuseScore)을 구축하고, 피치와 악기 정보를 동시에 예측하도록 설계된 U‑Net 기반 멀티태스크 네트워크를 제안한다. 피치 롤, 악기 롤, 멀티트랙 피아노롤을 각각 BCE 손실로 학습시켜 상호 보완적인 정보를 활용함으로써 기존 단일태스크 모델보다 프레임 수준 악기 인식 성능이 크게 향상됨을 실험을 통해 입증한다. 또한 합성 데이터만으로도 실제 음악에 대한 멀티피치 스트리밍이 가능한 점을 시연한다.

상세 분석

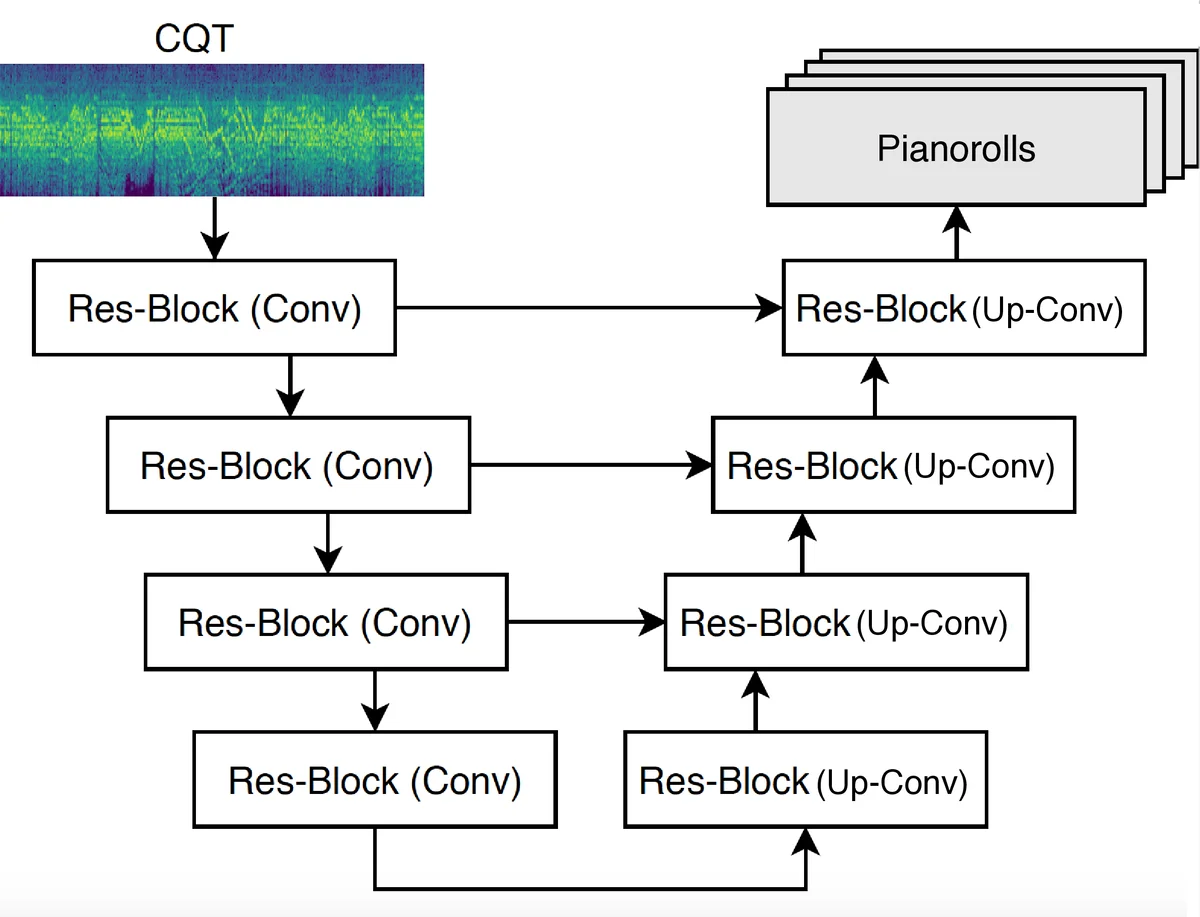

이 연구는 두 가지 핵심 문제를 동시에 해결한다. 첫째, 프레임 수준 악기 라벨이 부족한 현황을 극복하기 위해 MuseScore 웹사이트에서 344,166개의 MIDI‑오디오 쌍을 자동 수집하고, DTW 기반 정렬을 통해 정확한 시간 동기화를 수행한다. MIDI 스펙에 정의된 128개의 악기 클래스를 그대로 사용함으로써 라벨의 다양성을 확보했으며, 합성 음원임에도 불구하고 다양한 장르와 연주 스타일을 포함한다는 점이 큰 장점이다. 둘째, 피치와 악기(음색) 사이의 내재적 상관관계를 활용하기 위해 멀티태스크 학습 프레임워크를 설계했다. 입력은 16 kHz 샘플링 레이트의 CQT 스펙트로그램(88개의 주파수 빈, 512‑샘플 홉)이며, 이를 2‑D 컨볼루션 기반 U‑Net 구조에 통과시켜 (F × T × M) 형태의 멀티트랙 피아노롤을 직접 예측한다. 피치 롤(Yₚ)과 악기 롤(Yᵢ)은 각각 피아노롤을 축소(sum)함으로써 파생되며, 세 개의 BCE 손실 Lₚ, Lᵢ, Lᵣ을 동일 스케일로 가중합해 전체 손실을 구성한다. 이렇게 하면 모델이 피치와 악기 정보를 공유된 표현 공간에서 동시에 학습하게 되어, 피치 정보가 악기 존재 판단에, 악기 정보가 피치 추정에 보조적으로 작용한다.

네트워크는 인코더와 디코더 각각 4개의 Residual 블록으로 이루어졌으며, 각 블록은 3개의 Conv‑BN‑LeakyReLU 레이어로 구성된다. 스킵 연결을 통해 저수준 시간‑주파수 정보를 보존함으로써 희소한 바이너리 피아노롤을 효과적으로 복원한다. 최적화는 SGD(learning rate = 0.005)로 진행했으며, 미니배치 크기는 10 초 길이의 CQT 세그먼트 단위다.

실험은 두 단계로 나뉜다. 첫 번째는 MuseScore 데이터셋 내에서 9개의 대표 악기(피아노, 어쿠스틱·일렉기타, 트럼펫, 색소폰, 바이올린, 첼로, 플루트 등)를 대상으로 멀티태스크 모델과 각각 Lₚ, Lᵢ, Lᵣ만 사용한 단일태스크 모델를 비교한 것이다. 결과는 악기 인식 F1‑score에서 0.947(멀티) vs 0.623(Lᵣ only) 등 현저한 차이를 보였으며, 피치 정확도와 피아노롤 정확도에서도 멀티태스크가 우수했다. 두 번째는 기존 최첨단 모델 3종(

댓글 및 학술 토론

Loading comments...

의견 남기기