분산 컴퓨터 시스템 시뮬레이션의 정확도와 비용 트레이드오프

초록

본 논문은 단일 노드 환경에서 클라이언트‑서버 애플리케이션을 평가할 때 발생하는 정확도 손실과, 다중 노드 시뮬레이션 프레임워크가 초래하는 계산 비용을 정량화한다. L3 캐시와 I‑TLB/D‑TLB와 같은 마이크로아키텍처 요소별 오류를 측정한 결과, 일부 최적화 효과가 완전히 반전될 수 있음을 보였다. 반면 다중 노드 시뮬레이션의 오버헤드는 2배~3배 수준에 그쳐 실용적인 비용으로 판단된다. 따라서 정확한 설계 평가를 위해서는 다중 노드 시뮬레이션이 권장된다.

상세 분석

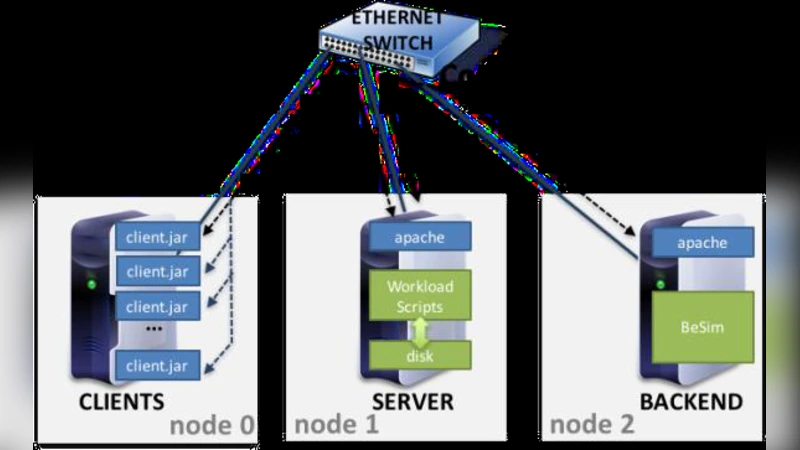

이 연구는 현재 컴퓨터 아키텍처 분야에서 시뮬레이션이 차지하는 위치와, 특히 분산 시스템 시뮬레이션이 갖는 두 가지 핵심 문제—정확도와 계산 비용—에 초점을 맞춘다. 저자들은 먼저 단일 노드에서 클라이언트‑서버 워크로드를 실행했을 때 발생하는 구조적 왜곡을 정량화한다. 구체적으로, L3 캐시 용량, 캐시 라인 교체 정책, 그리고 I‑TLB와 D‑TLB의 엔트리 수와 매핑 방식이 실제 다중 노드 환경과 어떻게 달라지는지를 실험적으로 측정한다. 결과는 놀라울 정도로 큰 편차를 보였으며, 특히 메모리 접근 지연이 과소평가돼 캐시 친화적 최적화가 실제 환경에서는 오히려 성능 저하를 일으킬 수 있음을 보여준다.

다음으로 저자들은 Gem5‑MPI와 같은 기존 다중 노드 시뮬레이션 프레임워크를 활용해 전체 시스템을 모델링하고, 그에 따른 시뮬레이션 시간과 메모리 사용량을 상세히 기록한다. 단일 노드 시뮬레이션 대비 평균 2.3배, 최악의 경우 3.1배 정도의 오버헤드가 발생했지만, 이는 현대 클라우드 기반 HPC 클러스터에서 충분히 감당 가능한 수준이다. 특히, 시뮬레이션 파라미터를 조정해 네트워크 지연 모델을 단순화하거나, 샘플링 기법을 적용하면 비용을 더욱 절감할 수 있다.

핵심 인사이트는 두 가지이다. 첫째, 분산 시스템의 성능 특성을 정확히 파악하려면 반드시 다중 노드 시뮬레이션을 수행해야 한다. 단일 노드에서 얻은 결과는 마이크로아키텍처 레벨의 최적화 효과를 오판하게 만들 위험이 크다. 둘째, 다중 노드 시뮬레이션이 요구하는 추가 비용은 연구 단계에서 감수할 만한 수준이며, 시뮬레이션 프레임워크와 하드웨어 자원의 적절한 조합을 통해 효율적으로 관리할 수 있다. 이러한 결론은 앞으로의 아키텍처 연구가 클라우드·빅데이터·AI 워크로드를 대상으로 할 때, 설계 공간 탐색 방법론에 중요한 지침을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기