다중 데이터셋을 위한 비선형 차원축소와 차별적 PCA

초록

본 논문은 목표 데이터와 하나 이상의 배경 데이터 사이의 차별적 정보를 추출하기 위해 새로운 차별적 PCA(dPCA)와 그 커널 확장(KdPCA, KMdPCA)을 제안한다. dPCA는 목표 데이터의 분산을 최대화하고 배경 데이터의 분산을 최소화하는 비율 최적화 문제로 정의되며, 일반화된 고유값 분해 한 번으로 해를 얻는다. 다중 배경 데이터에 대해서는 다중‑배경 dPCA(MdPCA)를 도입하고, 비선형 관계를 다루기 위해 커널 트릭을 적용한다. 이론적 최적성 증명과 합성·실험 데이터를 통한 성능 검증이 포함된다.

상세 분석

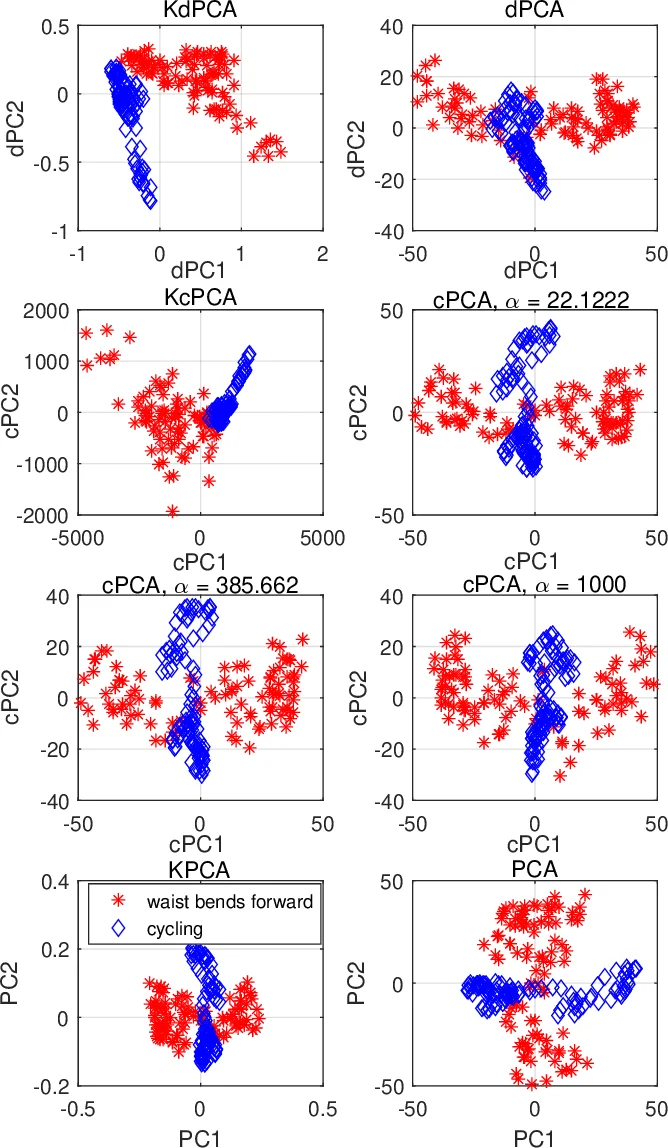

논문은 먼저 기존 PCA와 대비하여 목표 데이터와 배경 데이터가 동시에 존재할 때 발생하는 “공통” 변동과 “특이” 변동을 구분할 필요성을 강조한다. 기존 대비적 PCA(cPCA)는 하이퍼파라미터 α를 통해 목표 데이터의 분산을 크게, 배경 데이터의 분산을 작게 만드는 방향을 찾지만, α 선택이 어려워 실용성이 떨어진다. 이에 저자들은 파라미터 없이 목표‑배경 분산 비율을 직접 최적화하는 dPCA를 제안한다. 수식 (3)에서 목표 공분산 C_xx와 배경 공분산 C_yy의 비율을 최대화하는 문제를 정의하고, 라그랑주 승수법을 적용해 일반화 고유값 문제 C_xx u = λ C_yy u 로 변환한다. C_yy가 비특이이면 C_yy⁻¹C_xx의 가장 큰 고유벡터가 해가 된다. 이는 기존 PCA가 C_yy = I인 특수 경우와 일치함을 보여, dPCA가 PCA의 자연스러운 확장임을 확인한다.

다중 배경 상황에서는 여러 배경 공분산 행렬을 가중합(또는 합)하여 C_bg = ∑_ℓ C_yy^ℓ 로 만든 뒤 동일한 비율 최적화를 수행한다. 이렇게 하면 목표 데이터가 여러 종류의 잡음·공통 변동으로부터 동시에 정화된다.

비선형 구조를 다루기 위해 커널 트릭을 적용한 KdPCA를 도입한다. 원본 데이터 x_i, y_j 를 고차원 특성 공간 φ(·) 로 매핑하고, 매핑된 공분산을 커널 행렬 K_xx, K_yy 로 표현한다. 이후 동일한 일반화 고유값 문제 K_xx α = λ K_yy α 를 풀어 α 를 구하고, 최종 투영은 αᵀK_x 로 얻는다. 커널 차원은 데이터 수에 비례하므로, 고차원 원본 차원 D와 무관하게 효율적으로 계산된다.

이론적으로 저자들은 dPCA가 특정 선형 혼합 모델(목표 데이터 = 배경 성분 + 목표 고유 성분) 하에서 최소제곱 최적성을 갖는 것을 증명한다. 즉, 배경 공분산을 정확히 추정하면 dPCA는 목표 고유 성분을 완벽히 복원한다. 또한, cPCA와 dPCA는 α = λ* (dPCA에서 얻은 최적 라그랑주 승수) 일 때 동일한 방향을 찾음으로, 파라미터 선택 문제를 dPCA가 자동으로 해결한다는 점을 강조한다.

계산 복잡도 측면에서 dPCA와 KdPCA는 각각 O(D³)와 O(N³) (N은 데이터 샘플 수) 수준의 일반화 고유값 분해만 필요하므로, 대규모 데이터에도 Lanczos 등 효율적인 반복법을 적용할 수 있다.

실험에서는 (1) 합성 2‑클러스터 데이터에서 배경 잡음이 강한 경우, (2) 유전자 발현 데이터(암 환자 vs. 정상)에서 암 특이 서브타입을 발견, (3) 얼굴 이미지 데이터에서 조명·표정 변동을 배경으로 제거하고 인물 고유 특징을 추출하는 사례를 제시한다. 모든 경우에서 dPCA/KdPCA가 기존 PCA, cPCA, LDA 등에 비해 목표 특성을 더 명확히 분리함을 시각적·정량적으로 입증한다.

요약하면, 논문은 파라미터 프리, 해석 가능, 커널 확장 가능이라는 세 가지 장점을 갖는 차별적 차원축소 프레임워크를 제시하고, 이론적 최적성 및 실험적 유효성을 충분히 뒷받침한다.

댓글 및 학술 토론

Loading comments...

의견 남기기