데이터 품질은 얼마나 좋은가 보안 사고 대응 조사에서 생성된 데이터

초록

본 연구는 포춘 500대 기업의 보안 사고 대응팀이 조사 과정에서 생성하는 데이터의 품질 문제를 사례 연구로 탐색한다. 데이터 수집, 검증, 기록 단계에서 발생하는 정확성·완전성·일관성·시의성 결함을 식별하고, 이러한 결함이 위협 인텔리전스 활용에 미치는 영향을 논의한다. 연구 결과는 사고 대응 조직이 데이터 관리 프로세스를 개선하고, 위협 인텔리전스와의 연계를 강화하기 위한 실무적·학술적 과제를 제시한다.

상세 분석

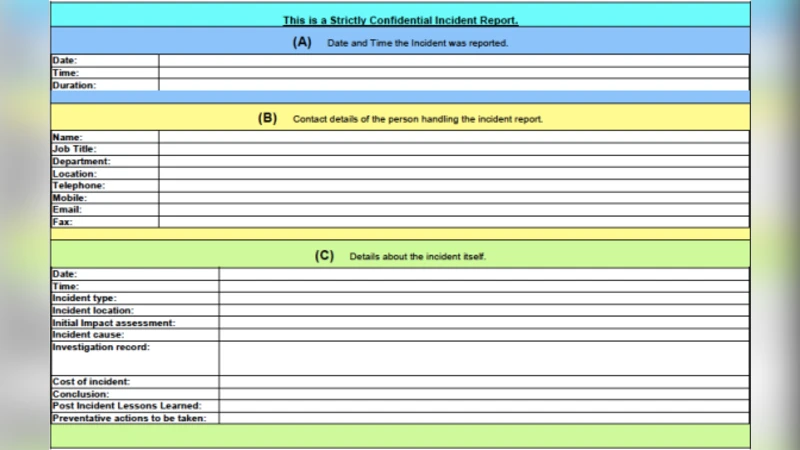

이 논문은 사이버 보안 사고가 급증함에 따라 조직이 위협 인텔리전스(Threat Intelligence, TI) 프로그램을 도입하려는 흐름 속에서, 사고 대응팀이 생성하는 데이터의 품질이 TI의 효과성을 좌우한다는 가설을 검증한다. 연구자는 Fortune 500 기업의 내부 사고 대응 프로세스를 현장 관찰, 인터뷰, 로그 분석을 통해 정밀히 조사했으며, 데이터 품질을 평가하기 위해 일반적으로 인정되는 4가지 차원—정확성, 완전성, 일관성, 시의성—을 적용하였다.

첫 번째로 정확성 측면에서, 조사 담당자는 사건 현장의 기술적 증거(예: 로그 파일, 네트워크 트래픽 캡처)를 수집하지만, 수작업 입력 과정에서 오탈자와 잘못된 필드 매핑이 빈번히 발생한다는 점을 발견했다. 특히, 공격자 IP 주소나 파일 해시값이 잘못 기록되면 후속 분석에서 오탐이 늘어나고, TI 공유 시 신뢰성을 크게 훼손한다.

두 번째 완전성에서는, 사건 전후의 컨텍스트 정보—예를 들어, 초기 탐지 시점, 영향을 받은 비즈니스 프로세스, 복구 조치의 상세 내역—가 누락되는 경우가 다수 관찰되었다. 이는 사고 대응 팀이 ‘복구’에 집중하면서 기록을 최소화하는 문화적 요인과, 기존 티켓 시스템이 자유로운 메타데이터 입력을 지원하지 않는 기술적 제약이 복합적으로 작용한 결과이다.

세 번째 일관성 측면에서는, 동일 사건에 대해 여러 담당자가 서로 다른 템플릿이나 용어를 사용함으로써 데이터베이스 내 레코드 간 형식이 불일치한다는 문제가 드러났다. 예를 들어, ‘악성코드’와 ‘멀웨어’가 별도 카테고리로 분류되거나, 시간 표기 방식이 UTC와 현지시간이 혼재되는 경우가 있었다. 이러한 비표준화는 자동화된 분석 파이프라인에서 데이터 정제 비용을 급증시킨다.

네 번째 시의성에서는, 사건 종료 후 데이터가 정리·검증되는 데 평균 2주 이상이 소요되는 것으로 나타났다. 이 기간 동안 최신 위협 정보와의 매칭이 지연되어, 동일한 공격 패턴이 다른 조직에 재발했음에도 불구하고 공유가 늦어지는 ‘시차 효과’가 발생한다.

연구자는 이러한 품질 결함이 TI 프로그램의 핵심 목표인 ‘예방·탐지·대응’ 사이클을 약화시킨다고 주장한다. 특히, 부정확하거나 불완전한 데이터가 피드백 루프에 들어가면, 머신러닝 기반 위협 모델이 잘못 학습될 위험이 있다. 따라서 논문은 데이터 품질 관리가 단순히 기록의 문제가 아니라, 조직 전체 보안 성숙도와 직결된 전략적 과제임을 강조한다.

마지막으로, 저자는 데이터 품질 향상을 위한 실무적 권고안을 제시한다. 첫째, 표준화된 입력 템플릿과 자동화된 검증 스크립트를 도입해 인간 오류를 최소화한다. 둘째, 사건 전후 모든 단계에서 메타데이터를 강제 수집하도록 정책을 개정한다. 셋째, 중앙화된 데이터 거버넌스 팀을 설립해 일관성 검토와 시의성 모니터링을 담당하게 한다. 넷째, 사고 대응과 TI 팀 간의 정기적인 교차 리뷰를 통해 피드백 루프를 활성화한다. 이러한 조치는 궁극적으로 데이터 신뢰성을 회복하고, 위협 인텔리전스의 가치를 극대화하는 기반이 될 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기