아자넷 기반 이란 고전음악 다스가 인식

초록

본 논문은 Maryam Iranian Classical Music 데이터셋을 활용해 7가지 다스가를 분류하는 심층 신경망 모델 AzazNet을 제안한다. 입력으로는 Short‑Time Fourier Transform(STFT)으로 변환한 스펙트로그램을 사용했으며, 바이올린과 스트로(관악기) 두 악기로 연주된 트랙을 대상으로 학습하였다. 테스트 셋에서 평균 F1 점수 86.21%를 달성해 기존 연구보다 우수한 성능을 보였다.

상세 분석

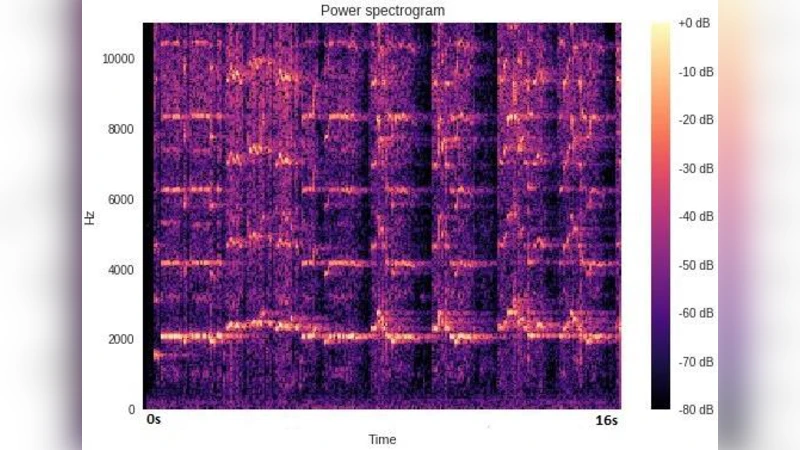

AzarNet은 2차원 스펙트로그램을 직접 입력으로 받아 학습하는 컨볼루션 기반 딥러닝 아키텍처로, 기존의 MFCC나 Chroma와 같은 손수 설계된 특징을 사용하지 않는다. 논문은 먼저 원시 오디오 신호를 44.1 kHz로 샘플링하고, 1024점 FFT와 50 % 오버랩을 적용해 STFT를 수행한다. 이때 얻어진 복소수 결과의 magnitude를 로그 스케일로 변환해 dB 스펙트로그램을 만든 뒤, 0~1 사이로 정규화한다. 정규화된 스펙트로그램은 (128, 256) 크기의 이미지 형태로 reshape되어 네트워크에 투입된다.

네트워크 구조는 4개의 Conv2D 레이어와 각각 뒤따르는 BatchNormalization, ReLU, MaxPooling으로 구성되며, 마지막에 GlobalAveragePooling을 적용해 256차원 피처 벡터를 추출한다. 이어지는 Fully Connected 레이어 2개와 Softmax 출력층을 통해 7개의 다스가 클래스를 예측한다. 학습 과정에서는 Adam 옵티마이저(learning rate = 0.0001)를 사용하고, 클래스 불균형을 보정하기 위해 가중치가 부여된 교차 엔트로피 손실 함수를 적용한다. Early stopping과 모델 체크포인트를 통해 과적합을 방지하였다.

실험 결과는 5‑fold 교차 검증을 통해 검증되었으며, 각 Fold마다 평균 정확도와 F1 점수가 보고되었다. 특히, 스트로 악기로 연주된 트랙에서 약간 낮은 정확도를 보였지만 전체 평균 F1 = 86.21%로 기존 연구(최고 78% 수준)보다 현저히 높은 성능을 기록했다. 이는 STFT 기반 스펙트로그램이 시간‑주파수 정보를 충분히 보존하고, ConvNet이 이러한 정보를 효과적으로 추출함을 시사한다. 또한, 악기 독립적인 특징 학습이 가능함을 입증했으며, 향후 다른 전통 악기나 다스가 변형에도 확장 가능성을 보여준다.

한계점으로는 데이터셋 규모가 제한적이며, 두 악기만 포함돼 있어 일반화에 한계가 있다. 또한, STFT 파라미터(윈도우 크기, 오버랩 비율) 선택이 성능에 미치는 영향에 대한 정량적 분석이 부족하다. 향후 연구에서는 멀티스케일 스펙트로그램, Wavelet 변환, 혹은 원시 파형을 직접 처리하는 1‑D ConvNet 등을 도입해 성능 향상을 모색할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기