연합학습의 범위 확대를 위한 클라이언트 자원 절감 전략

초록

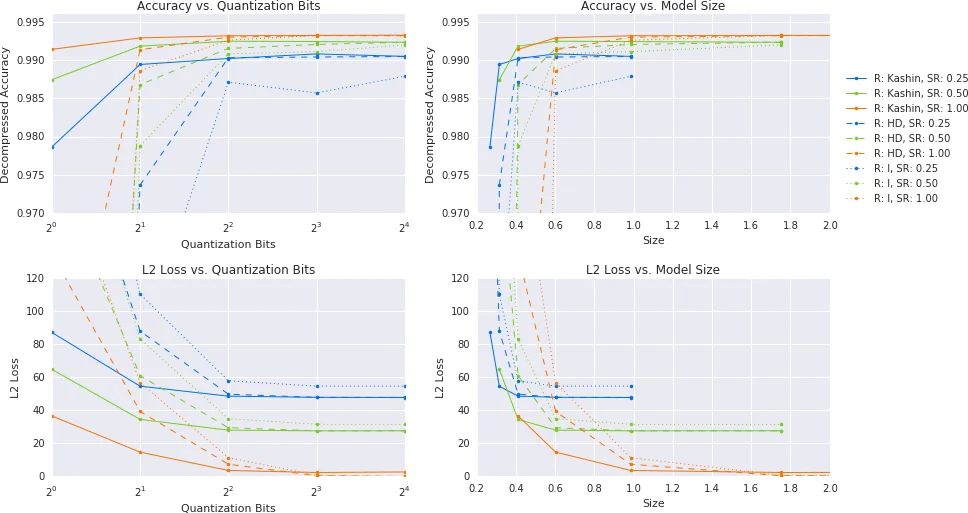

본 논문은 서버‑클라이언트 간 통신량과 클라이언트 연산량을 동시에 감소시키는 두 가지 기법, 즉 전역 모델의 손실 압축과 Federated Dropout을 제안한다. 실험 결과, 모델 정확도 손실 없이 서버‑클라이언트 전송량을 최대 14배, 업로드량을 28배, 로컬 연산을 1.7배 줄일 수 있음을 보여준다.

상세 분석

이 연구는 연합학습(Federated Learning, FL)에서 가장 큰 병목 중 하나인 서버‑클라이언트 전송량을 감소시키기 위해 두 가지 상호 보완적인 방법을 설계하였다. 첫 번째는 전역 모델 자체를 손실 압축(lossey compression)하는 것으로, 기존 연구가 주로 클라이언트‑서버 업로드에 초점을 맞춘 것과 달리 다운로드 단계에서도 압축을 적용한다. 구체적으로 가중치 행렬을 벡터화한 뒤, 무작위 Hadamard 변환이나 이론적으로 최적의 Kashin 표현을 적용해 정보가 고르게 분산되도록 만든다. 이후 일정 비율(s)만큼 샘플링하고, 균일 확률 양자화(1‑bit 혹은 q‑bit)를 수행한다. 역변환을 통해 복원된 모델은 약간의 노이즈를 포함하지만, 실험에서는 정확도 저하가 미미함을 확인하였다. 두 번째 기법인 Federated Dropout은 전통적인 dropout 개념을 시스템 관점에서 재해석한다. 각 클라이언트는 사전에 정의된 비율만큼의 뉴런(또는 필터)을 고정적으로 제외한 서브 모델을 받아 학습한다. 이렇게 하면 전송해야 할 파라미터 수가 감소하고, 로컬 연산에서도 행렬 곱셈 차원이 작아져 FLOPS가 크게 줄어든다. 중요한 점은 서브 모델의 업데이트가 원래 전체 모델에 그대로 매핑될 수 있다는 점이다. 즉, 서버는 서브 모델 업데이트를 받아 전체 모델에 적용함으로써 일관성을 유지한다. 두 기법은 서로 독립적으로 적용 가능하며, 기존의 클라이언트‑서버 압축 기법(예: Konečný et al., 2016b)과도 자연스럽게 결합된다. 실험에서는 MNIST, CIFAR‑10, EMNIST 세 데이터셋과 1M 파라미터 규모의 CNN을 사용했으며, 압축 비율을 조절하면서도 최종 테스트 정확도가 비압축 기준과 차이가 거의 없음을 보였다. 특히 서버‑클라이언트 다운로드 크기를 14배, 업로드 크기를 28배, 로컬 연산을 1.7배 절감했음에도 불구하고 수렴 속도는 약간의 라운드 증가 정도만 보였다. 이러한 결과는 고용량 모델을 제한된 네트워크 환경에서도 효과적으로 배포할 수 있음을 시사한다. 또한, Federated Dropout은 클라이언트 디바이스의 메모리와 전력 소모를 동시에 낮출 수 있어, 저사양 기기나 네트워크가 열악한 지역에서도 참여를 확대할 수 있다. 향후 연구에서는 동적 dropout 비율 조정, 비동형 모델 구조 지원, 그리고 압축 후 모델 재학습(retraining) 전략 등을 탐색함으로써 더욱 실용적인 FL 시스템 구축이 가능할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기