희소 데이터 극복을 위한 의사 암시적 피드백 기반 TopK 추천 모델 PsiRec

초록

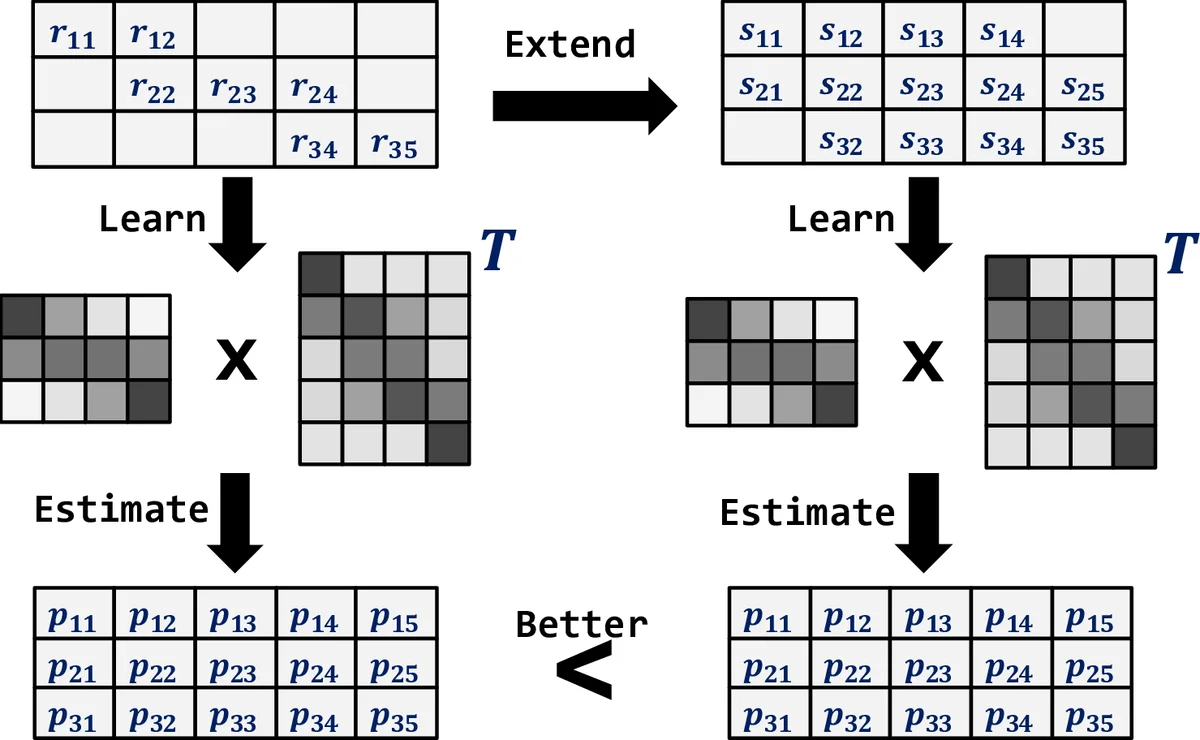

PsiRec은 사용자‑아이템 이중 그래프에서 무작위 워크를 수행해 간접 연결을 추출하고, 이를 점별 상호 정보(PMI) 기반의 의사 암시적 피드백으로 변환한다. 변환된 피드백을 행렬분해에 적용해 기존의 희소 암시적 데이터보다 20% 이상 높은 Precision@10과 Recall@10을 달성한다.

상세 분석

본 논문은 기존 협업 필터링이 직면한 “극단적 희소성” 문제를 두 가지 관점—그래프 기반 전파와 잠재 요인 모델—을 결합함으로써 해결하고자 한다. 첫 단계에서는 사용자‑아이템 상호작용을 이분 그래프 G( V=U∪I, E) 로 모델링하고, 각 사용자와 아이템 사이에 존재하는 직접 및 간접 경로를 탐색한다. 이를 위해 β개의 시작점마다 길이 γ인 truncated random walk를 수행하고, 윈도우 크기 σ를 설정해 walk 내에서 사용자와 아이템 쌍을 샘플링한다. 이 과정은 DeepWalk와 유사하지만, 이분 그래프 특성상 사용자와 아이템이 번갈아 등장하도록 설계되어 전이 확률이 자연스럽게 “사용자‑아이템 근접성”을 반영한다.

샘플링된 (u,i) 쌍에 대해 두 가지 피드백 측정 방식을 제안한다. 첫 번째는 단순 동시 발생 횟수(#(u,i))를 이용한 co‑occurrence 방식이다. 그러나 이 방식은 고빈도 사용자·아이템에 편향되는 단점이 있다. 두 번째는 Skip‑gram with Negative Sampling(SGNS)에서 영감을 얻은 PMI 기반 방법이다. SGNS의 목적함수를 전개하고, 각 (u,i) 쌍에 대해 최적화 조건을 풀면

s′ui = log( #(u,i)·|C| / ( #(u)·#(i) ) ) – log k

가 도출된다. 여기서 k는 네거티브 샘플 수이며, 로그 항은 바로 점별 상호 정보(PMI)를 의미한다. PMI는 빈도 편향을 보정하고, 실제 연관성이 높은 쌍에 높은 값을 부여한다. PMI가 음수이거나 0인 경우는 의미가 없으므로 max(s′ui,0)으로 클리핑해 최종 의사 암시적 피드백 s_ui를 얻는다.

이렇게 구성된 피드백 행렬 S는 원본 상호작용 행렬 R보다 훨씬 밀도가 높으며, 직접 관측되지 않은 사용자‑아이템 관계까지 포함한다. 이후 전통적인 행렬분해 모델을 적용해

p̂_ui = x_u^T y_i

를 예측한다. 손실 함수는 (s_ui – p̂_ui)^2에 L2 정규화를 더한 형태이며, ALS(Alternating Least Squares) 알고리즘으로 효율적으로 최적화한다. ALS 단계에서 x_u와 y_i는 각각

x_u = (Y^T Y + λD)^{-1} Y^T s_u, y_i = (X^T X + λD)^{-1} X^T s_i

로 업데이트된다.

실험에서는 Amazon과 Tmall의 두 대규모 희소 데이터셋을 사용했으며, 비교 대상은 대표적인 행렬분해 기반 모델, 그래프 전파 기반 모델, 그리고 최신 Collaborative Denoising Auto‑Encoder(CDAE)이다. PsiRec‑PMI 버전은 Precision@10에서 21.5%, Recall@10에서 22.7%의 상대적 향상을 기록했다. 특히 데이터 희소도가 높을수록 개선 폭이 크게 나타났으며, 이는 간접 관계를 효과적으로 활용한 결과로 해석된다. 또한, PsiRec‑CO(동시 발생 횟수 기반)보다 PMI 기반이 일관되게 우수함을 보여, 피드백 측정 단계에서 PMI가 핵심적인 역할을 함을 입증한다.

본 연구의 주요 기여는 다음과 같다. (1) 사용자‑아이템 이분 그래프에서 무작위 워크를 이용해 직접·간접 관계를 정량화하는 프레임워크 제시, (2) SGNS와 PMI를 연결해 피드백 신뢰도를 수학적으로 정의하고, 이를 행렬분해에 자연스럽게 통합, (3) 극단적 희소성 상황에서도 경쟁 모델 대비 현저한 성능 향상을 실증. 한계점으로는 워크 파라미터(β,γ,σ)의 민감도가 존재하고, 대규모 그래프에서 워크 샘플링 비용이 증가할 수 있다는 점이다. 향후 연구에서는 메타‑학습을 통한 파라미터 자동 튜닝, 그리고 동적 그래프(시간에 따라 변하는 상호작용) 확장 등을 고려할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기