환자를 위한 인공지능 연구 투명성 및 효과성 체크리스트

초록

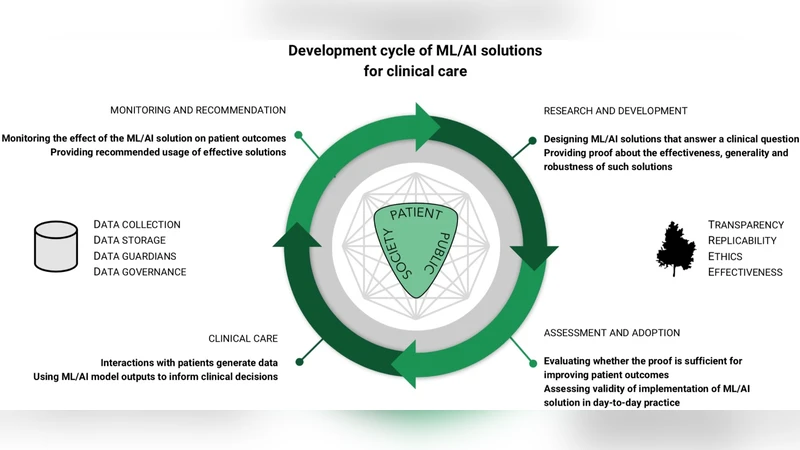

본 논문은 의료 분야에서 머신러닝·인공지능 연구가 환자에게 실질적 혜택을 주기 위해 반드시 갖추어야 할 투명성, 재현성, 윤리성, 효과성 네 가지 핵심 요소를 진단한다. 이를 위해 연구 전·중·후 단계별로 답변해야 할 20가지 질문을 제시하고, 이러한 질문이 국제적 합의 기반의 AI‑TREE 프레임워크 형성에 어떻게 기여할 수 있는지를 논의한다.

상세 분석

이 논문은 현재 의료 AI 연구가 직면한 구조적 문제를 체계적으로 진단하고, 실질적인 해결책으로 ‘질문 기반 체크리스트’를 제안한다. 첫째, 투명성 부족은 데이터 출처, 전처리 과정, 모델 설계 등에 대한 상세 보고가 결여된 데서 비롯된다. 저자들은 각 단계별로 구체적인 문서화 요구사항을 제시함으로써 독립적인 검증이 가능하도록 한다. 둘째, 재현성 결여는 코드와 모델 파라미터, 실험 환경을 공유하지 않아 발생한다. 논문은 오픈소스 코드와 컨테이너화된 실행 환경 제공을 권고하고, 버전 관리와 메타데이터 표준화를 강조한다. 셋째, 윤리적 고려사항은 데이터 프라이버시, 편향성, 공정성, 환자 동의 절차 등을 포괄한다. 특히, 데이터 수집 단계에서의 윤리 검토와 모델 결과에 대한 사회적 영향 평가를 필수 항목으로 설정한다. 넷째, 효과성 검증은 임상 적용 전후의 실제 환자 결과를 측정하고, 비교 대조군을 통한 통계적 유의성을 확보하는 것을 의미한다. 이를 위해 무작위 대조시험(RCT) 설계 혹은 실제 세계 데이터(real‑world data) 활용을 권장한다. 전체적으로 20개의 질문은 프로젝트 기획, 데이터 관리, 모델 개발·평가, 배포·모니터링 단계에 걸쳐 구체적이고 실천 가능한 지침을 제공한다. 이러한 질문 중심 접근법은 다학제 팀이 공동으로 검토하고, 국제 표준화 작업에 기여할 수 있는 기반을 마련한다는 점에서 학술적·실무적 의의가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기