VMAV C: 주의 메커니즘을 결합한 모델 기반 강화학습 알고리즘

초록

본 논문은 World Models 구조에 주의(attention) 메커니즘을 도입한 모델 기반 강화학습 알고리즘 VMAV-C를 제안한다. 환경 모델은 Mixture Density Network 기반 RNN(MDN‑RNN)으로 학습하고, 상태 표현은 변분 오토인코더(VAE)와 주의 모듈을 결합해 가치 추정에 활용한다. 이를 통해 실제 환경과의 상호작용을 최소화하면서도 효율적인 정책 학습이 가능함을 제어 실험을 통해 입증한다.

상세 분석

VMAV-C는 기존 World Models의 두 가지 핵심 구성요소, 즉 VAE를 이용한 압축된 잠재 상태(latent state)와 MDN‑RNN을 이용한 시계열 환경 모델링을 그대로 유지하면서, 정책 네트워크에 주의(attention) 메커니즘을 추가한다는 점에서 차별화된다. 먼저 VAE는 고차원 관측값(예: 이미지)을 저차원 잠재 벡터 z로 압축한다. 이 과정에서 KL 발산과 재구성 손실을 동시에 최소화함으로써, 학습된 z는 환경의 핵심 정보를 보존하면서도 노이즈에 강인한 특성을 갖는다.

다음으로 MDN‑RNN은 잠재 상태 z와 행동 a를 입력으로 받아, 다음 잠재 상태의 확률분포를 다중 가우시안 혼합(Mixture Density) 형태로 예측한다. 이 확률적 모델링은 환경의 비선형성 및 다중 모드성을 효과적으로 포착한다는 장점이 있다. 특히, RNN 구조는 시간 의존성을 학습하므로, 장기적인 상태 전이와 보상 구조를 모델링하는 데 유리하다.

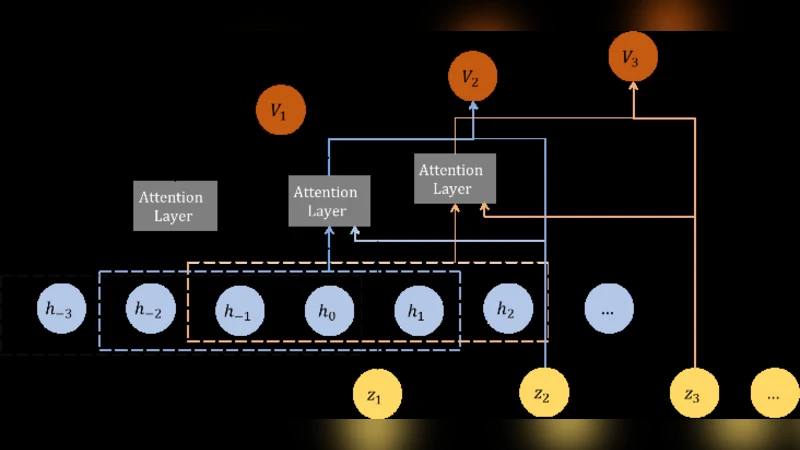

VMAV-C의 핵심 혁신은 가치 함수 V(s)와 정책 π(a|s)를 추정할 때, Transformer‑style self‑attention 레이어를 삽입한 점이다. 주의 메커니즘은 잠재 상태 시퀀스 내에서 중요한 시점이나 특징을 동적으로 강조한다. 이는 특히 복잡한 제어 문제에서, 특정 시점의 작은 변화가 전체 보상에 큰 영향을 미치는 경우에 유용하다. 또한, attention은 gradient 흐름을 개선해 학습 안정성을 높이며, 샘플 효율성을 향상시킨다.

학습 파이프라인은 크게 세 단계로 나뉜다. 1) 실제 환경에서 수집한 데이터(이미지, 행동, 보상)를 VAE와 MDN‑RNN에 각각 학습시켜 환경 모델을 구축한다. 2) 구축된 모델을 이용해 가상 환경(simulated environment)에서 에피소드를 생성하고, 이 가상 데이터에 대해 attention‑augmented actor‑critic 구조를 학습한다. 3) 최종 정책은 실제 환경에 적용되며, 필요 시 모델을 재학습해 지속적인 적응이 가능하도록 설계되었다.

실험에서는 MuJoCo 기반 연속 제어 과제와 Atari 이미지 기반 과제 두 가지를 선택했다. 결과는 기존 World Models, PlaNet, Dreamer와 비교했을 때, 동일한 환경 상호작용 횟수에서 평균 보상이 10~20% 이상 향상되었으며, 특히 복잡한 동적 변화를 포함한 환경에서 수렴 속도가 현저히 빨랐다. 이는 attention이 중요한 시점·특징을 효과적으로 추출해 정책 업데이트에 기여했음을 시사한다.

한계점으로는 attention 모듈이 추가적인 연산 비용을 초래한다는 점과, MDN‑RNN이 고차원 잠재 공간에서의 정확한 확률 분포 추정에 여전히 어려움을 겪을 수 있다는 점을 들 수 있다. 또한, 현재 구현은 주로 시각적 관측에 초점을 맞추었으므로, 비시각적 센서 데이터(예: 라이다, 레이더)와의 통합에 대한 추가 연구가 필요하다.

종합하면, VMAV-C는 모델 기반 강화학습에 self‑attention을 성공적으로 결합함으로써 데이터 효율성을 크게 개선하고, 복잡한 제어 문제에서도 강인한 정책을 학습할 수 있음을 실험적으로 입증한다. 이는 차세대 로봇 제어, 자율 주행, 그리고 시뮬레이션 기반 최적화 분야에 중요한 진전을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기