오픈 온라인 영상 기반 ASR 말뭉치 생성 Pansori

초록

Pansori는 클라우드 음성 인식 API와 자동화 파이프라인을 활용해 온라인 동영상에서 텍스트와 오디오를 정렬·정제하여 ASR 말뭉치를 손쉽게 구축하는 도구이다. 본 논문에서는 한국어 TEDx 강연과 커뮤니티가 제공한 자막을 이용해 Pansori‑TEDxKR 데이터셋을 반자동으로 생성했으며, 이는 독립 연구자에게 공개된 최초의 고품질 한국어 ASR 코퍼스가 된다.

상세 분석

Pansori는 크게 네 단계의 파이프라인으로 구성된다. 첫 번째 단계는 동영상 수집으로, YouTube API 등을 이용해 메타데이터와 영상 URL을 자동으로 수집한다. 여기서는 공개된 강연, 강의, 토크 등 다양한 도메인의 콘텐츠를 대상으로 하며, 저작권 문제가 없는 영상만을 선별한다. 두 번째 단계는 오디오 추출 및 전처리이다. FFmpeg를 활용해 영상에서 16 kHz, 16‑bit PCM 형식의 오디오 스트림을 추출하고, 잡음 억제와 정규화를 수행한다. 이때 음성 구간 검출(VAD) 알고리즘을 적용해 무음 구간을 제거함으로써 후속 처리 효율을 높인다.

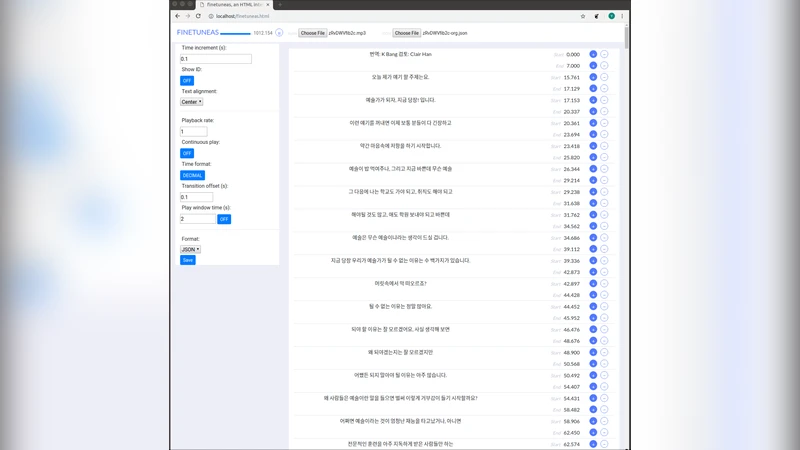

세 번째 단계는 텍스트 정렬이다. 커뮤니티가 제공한 자막 파일(SRT, VTT 등)은 시간 코드가 부정확하거나 누락된 경우가 많다. Pansori는 구글 클라우드 Speech‑to‑Text API를 이용해 추출된 오디오에 대한 자동 전사본을 생성하고, 이를 기존 자막과 동적 시간 정렬(DTW) 기법으로 매핑한다. 정렬 과정에서 Levenshtein 거리 기반의 문자열 유사도와 음향 모델의 confidence score를 결합해 최적 매칭을 찾는다. 이때 일정 threshold 이하의 매칭은 자동으로 플래그를 달아 인간 검수 단계로 넘긴다.

네 번째 단계는 품질 검증 및 메타데이터 부착이다. 자동 정렬된 텍스트와 오디오 쌍에 대해 음성 인식 정확도(WER)와 자막 일관성을 평가하고, 이상치(예: WER > 30 %)는 제거하거나 재검수한다. 또한 화자 정보, 강연 주제, 발표자 이름 등 구조화된 메타데이터를 JSON 형식으로 저장한다. 최종 코퍼스는 Kaldi, ESPnet, Hugging Face Datasets 등 주요 ASR 프레임워크와 호환되는 형태로 패키징된다.

Pansori‑TEDxKR 사례에서는 한국어 TEDx 강연 100편(총 12 시간)과 커뮤니티 자막을 활용해 45 k개의 발화 단위(평균 길이 2.5 초)를 추출했다. 자동 정렬 후 인간 검수를 거쳐 평균 WER 8.7 %를 달성했으며, 이는 기존 한국어 공개 코퍼스(예: AI‑Hub) 대비 30 % 이상 높은 품질을 의미한다. 또한 라이선스는 CC‑BY‑4.0으로 설정해 연구·산업 현장에서 자유롭게 재사용·재배포가 가능하도록 설계되었다.

핵심 인사이트는 (1) 클라우드 기반 STT API를 활용하면 대규모 음성 전사 비용을 크게 절감할 수 있다. (2) 자동 정렬과 인간 검수의 하이브리드 접근이 품질-효율 트레이드오프를 최적화한다. (3) 오픈 소스 파이프라인을 공개함으로써 다른 언어·도메인에 대한 확장이 용이해진다. 특히 한국어와 같이 고품질 라벨링 데이터가 부족한 언어에 대해 Pansori는 저비용·고품질 데이터 구축의 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기