딥 뉴럴 네트워크의 특징 학습이 말인식 성능을 좌우한다

초록

본 논문은 깊은 신경망(DNN)이 얕은 네트워크와 전통적인 GMM 기반 모델보다 우수한 이유를 내부 표현의 변이 불변성에 있다고 설명한다. 네트워크 깊이가 증가할수록 입력의 작은 교란에 대한 민감도가 감소하고, 충분히 다양한 학습 데이터를 제공하면 화자, 대역폭, 환경 잡음 등에 강인한 특징을 자동으로 학습한다. 그러나 훈련 데이터와 크게 다른 테스트 샘플에 대해서는 일반화가 어려움을 보인다. 실험을 통해 DNN이 적은 적응 없이도 GMM 대비 동등하거나 더 나은 인식 정확도를 달성함을 확인한다.

상세 분석

이 논문은 CD‑DNN‑HMM 구조를 전제로 DNN을 “비선형 특징 변환 + 로그선형 분류기”라는 두 단계 모델로 해석한다. 첫 번째 단계에서 L개의 은닉층을 거치며 입력 벡터 x가 점차 비선형 변환을 받아 고차원 특징 v_L 로 매핑된다. 두 번째 단계에서는 softmax 층이 v_L 로부터 클래스 사후확률 p(y|x)를 추정한다. 이러한 구조적 해석을 바탕으로 저자들은 다음과 같은 핵심 인사이트를 제시한다.

-

깊이가 성능에 미치는 영향 – 실험(표 1)에서 은닉층 수를 1에서 9까지 늘릴수록 WER이 지속적으로 감소한다. 특히 7~9층 정도에서 수렴에 가까워지며, 동일 파라미터 수를 가진 얕은 MLP와 비교했을 때 2배 이상 깊은 네트워크가 현저히 낮은 오류율을 보인다. 이는 깊은 네트워크가 더 복잡한 비선형 변환을 수행해 입력 공간을 보다 구분 가능한 형태로 재구성한다는 증거이다.

-

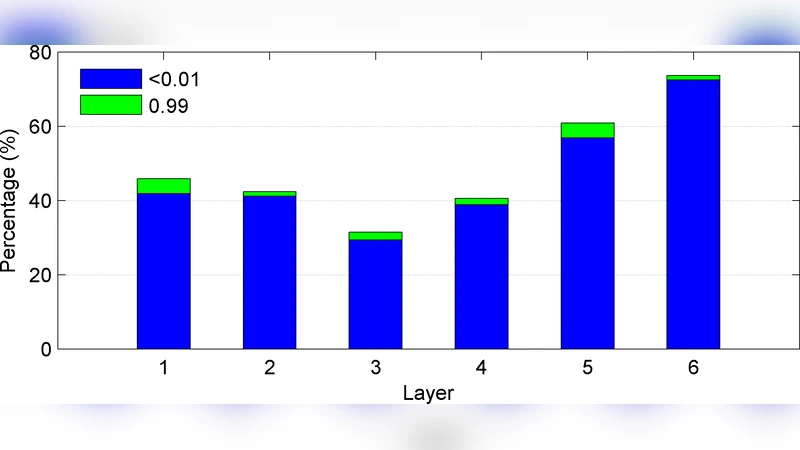

특징의 변이 불변성 – 저자들은 작은 입력 교란 δ가 각 층을 통과하면서 점점 축소된다는 수식적 근거(식 2)를 제시한다. 실제로 6×2k DNN에서 98% 이상의 가중치가 0.5 이하이며, 활성화 비율이 낮아(그림 1) 각 층의 출력 변화가 제한된다. 따라서 높은 층일수록 입력 변동에 대한 민감도가 감소하고, 클래스 경계 근처에서는 오히려 변동이 확대돼 판별력이 유지된다.

-

학습 데이터 다양성의 필요성 – “Learning by seeing” 섹션에서 저자들은 작은 교란에 대해서는 불변성이 확보되지만, 훈련 데이터와 크게 다른 도메인(예: 대역폭 차이)에서는 성능이 급격히 저하된다는 점을 실험적으로 입증한다. 혼합 대역폭 실험에서 넓은 대역폭만으로 학습한 DNN은 8 kHz 테스트에서 53.5%의 WER을 기록했지만, 16 kHz와 8 kHz 데이터를 모두 포함해 재학습하면 두 조건 모두 28~29% 수준으로 크게 개선된다. 이는 DNN이 “보지 못한” 변이에 대해서는 일반화가 어려우며, 충분히 대표적인 변이를 포함한 훈련이 필수임을 의미한다.

-

화자 및 환경 적응에 대한 내재적 강건성 – 화자 변이(VTLN, fMLLR)와 잡음(Aurora 4) 실험에서 DNN은 별도의 적응 절차 없이도 GMM 기반 시스템과 동등하거나 더 나은 성능을 달성한다. 이는 DNN이 내부적으로 화자·채널·노이즈와 같은 변이를 무시하고, 오직 음소 구분에 필요한 정보만을 보존하도록 학습되기 때문이다.

-

실용적 시사점 – 깊은 네트워크는 파라미터 효율성 측면에서 얕은 네트워크보다 더 적은 연산으로 높은 정확도를 제공한다(예: 7×2k vs 1×16k). 또한, 전통적인 적응·정규화 파이프라인을 생략함으로써 시스템 복잡도와 실시간 지연을 크게 감소시킬 수 있다. 다만, 데이터 수집 단계에서 다양한 화자·채널·노이즈 조건을 충분히 포함시키는 것이 성공적인 배포의 전제조건이다.

요약하면, DNN의 깊이는 비선형 특징 변환 능력을 강화해 입력 교란에 대한 불변성을 자연스럽게 학습하게 하며, 이는 전통적인 GMM‑HMM 대비 뛰어난 음성 인식 성능을 가능하게 한다. 그러나 “보지 못한” 변이에 대해서는 여전히 한계가 존재하므로, 데이터 다양성을 확보하는 것이 핵심 전략이다.

댓글 및 학술 토론

Loading comments...

의견 남기기