단어 기반 음성인식 모델의 편향과 데이터 규모가 최적화·일반화에 미치는 영향 분석

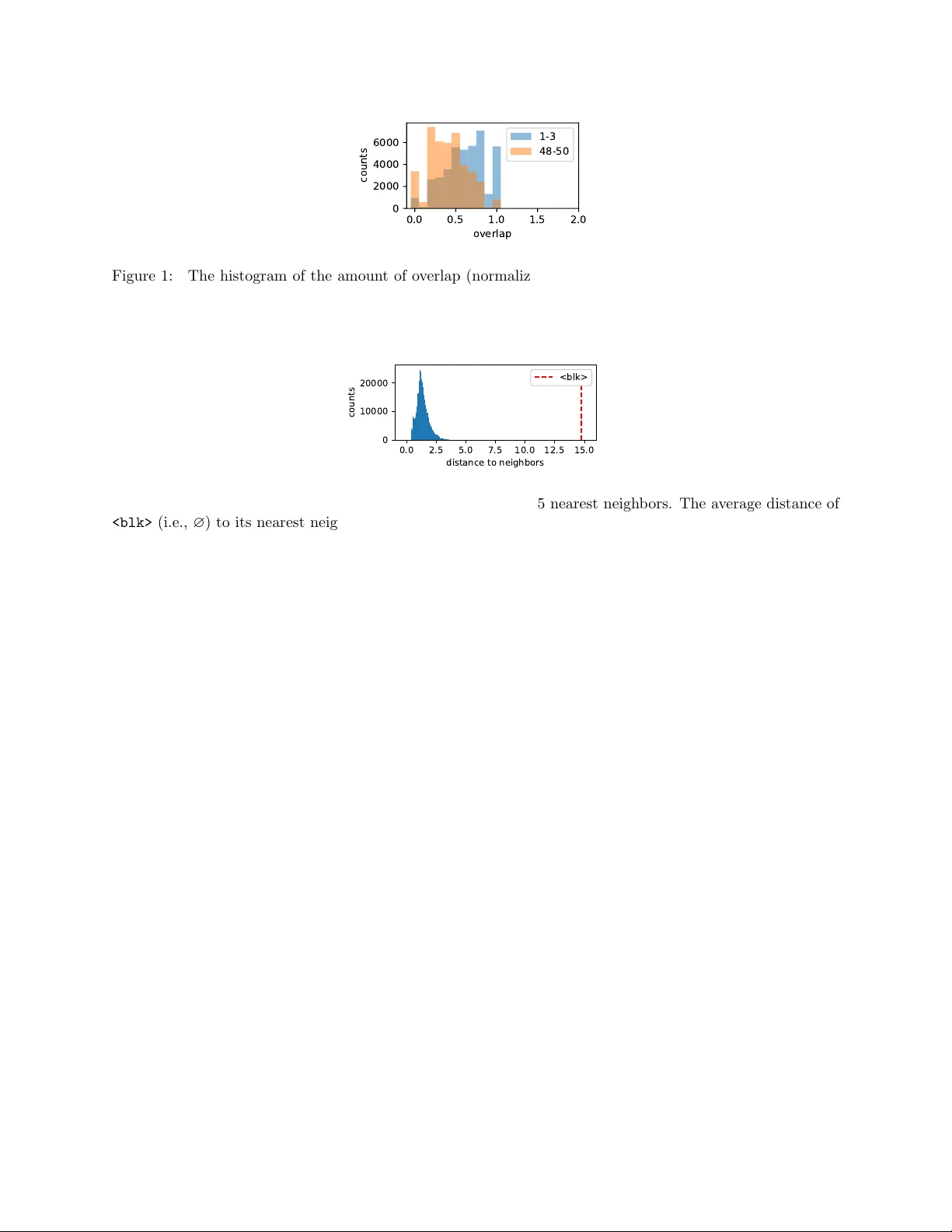

본 논문은 발음 사전·단어 경계·단어 길이 제약이라는 세 가지 인덕티브 바이어스를 도입해, 다양한 학습 데이터 양에서 Acoustics‑to‑Word(ATW) 모델의 학습·일반화 특성을 조사한다. 실험 결과, 다운샘플링을 통한 단어 길이 제약이 가장 큰 성능 향상을 가져왔으며, 학습된 단어 임베딩은 발음 유사도에 의해 군집되는 구조를 보였다. 이는 향후 ATW 모델의 인덕티브 바이어스가 음향‑발음보다 단어 간 의존성에 초점을 맞춰야 함을 시사한…

저자: Hao Tang, James Glass

본 논문은 Acoustics‑to‑Word(ATW) 모델, 즉 단어를 직접 출력 목표로 하는 엔드‑투‑엔드 음성 인식 시스템의 학습·일반화 특성을 체계적으로 조사한다. 기존 연구에서는 ATW 모델이 학습 데이터가 부족하면 최적화가 어려워 사전(lexicon)이나 발음 사전 기반 사전 학습이 필수적이라고 주장했지만, 저자들은 이러한 가정에 의문을 제기한다.

먼저, WSJ0/WSJ1(약 80시간) 데이터셋을 사용해 4‑계층 단방향 LSTM(각 층 500 유닛) 기반 CTC 모델을 구현하였다. 로그‑멜 80차원을 입력으로 사용하고, 출력은 13,635개의 단어와 blank 심볼(∅)이다. 학습은 SGD(초기 학습률 0.05, 20 epoch) 후 학습률 감소와 추가 20 epoch fine‑tuning을 거쳐 최적 모델을 선정한다.

**데이터 규모와 최적화**

학습 데이터 양을 5시간(시84‑half), 10시간(시84), 35시간(시284‑half), 70시간(시284) 네 단계로 나누어 실험하였다. 훈련 퍼플렉시티는 데이터가 늘어날수록 감소했으며, 35시간 이상에서는 거의 0에 수렴해 훈련 집합을 완전히 피팅함을 확인했다. 반면, 테스트(WER)와 개발 셋(dev93)에서는 데이터가 많을수록 일반화 오차가 감소했으며, 70시간 모델이 26.3 %(eval92)라는 최저 WER를 기록했다. 이는 ATW 모델이 충분한 데이터가 주어지면 사전 지식 없이도 학습이 가능함을 보여준다.

**인덕티브 바이어스 세 가지**

1. **발음 사전(lexicon) 기반 초기화**: 3‑계층 LSTM phoneme‑CTC 모델을 사전 학습하고, 하위 3층을 ATW 모델에 초기화했다. phoneme‑CTC 자체는 9.4 %(eval92) 수준의 PER을 달성했지만, 이를 ATW에 전이했을 때 오히려 WER가 상승했다.

2. **단어 경계(word boundary) 정보**: 4‑계층 LSTM word‑frame classifier(look‑ahead 1 frame)를 사전 학습하고, 하위 3층을 ATW에 초기화했다. 이 역시 성능 향상이 없으며, 일부 경우에 WER가 악화되었다.

3. **단어 지속시간 제약(word duration)**: 각 LSTM 층 사이에 프레임을 2배, 4배, 8배 등으로 다운샘플링하여 최소 단어 길이를 강제했다. 다운샘플링 비율이 4배일 때 dev93에서 18.6 %, eval92에서 24.6 %의 WER를 기록, 기존 베이스라인(≈27 %) 대비 약 10 % 절감했다. 이는 단어 경계 추정에 필요한 시간‑스케일 정보를 명시적으로 제공함으로써 CTC 손실의 프레임 독립 가정이 완화된 결과로 해석된다.

**임베딩 분석**

학습된 소프트맥스 가중치 행렬을 이용해 각 단어의 임베딩 벡터를 추출하고, L2 거리 기반 최근접 이웃을 조사했다. 발음이 유사한 단어(예: “cat” vs “bat”)가 서로 가까운 클러스터를 형성했으며, blank 심볼은 다른 단어와의 거리가 현저히 멀었다. 또한, 단어 빈도와 마진 사이에 상관관계가 존재함을 확인했다(빈도가 높을수록 주변 이웃과의 거리 감소). 이는 모델이 주로 음향‑발음 정보를 이용해 단어를 구분하고, 문맥적 의존성은 거의 활용하지 않음을 의미한다.

**결론 및 향후 과제**

- ATW 모델은 충분한 데이터가 있으면 최적화가 가능하지만, 현재 CTC 기반 구조는 라벨 간 의존성을 충분히 학습하지 못한다.

- 가장 효과적인 인덕티브 바이어스는 **시간‑스케일(단어 지속시간) 제약**이며, 이는 모델이 단어 경계를 더 정확히 추정하도록 돕는다.

- 발음 사전이나 단어 경계 정보는 현재 구현 방식으로는 성능 향상에 기여하지 않으며, 오히려 불필요한 편향을 도입한다.

- 향후 연구는 CTC의 독립 가정에서 벗어나 **단어 간 의존성**을 명시적으로 모델링하거나, 언어 모델과의 통합을 통해 라벨 의존성을 강화하는 방법을 모색해야 한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기