음성 퍼커션 자동 전사: 사용자 맞춤 적응 시스템

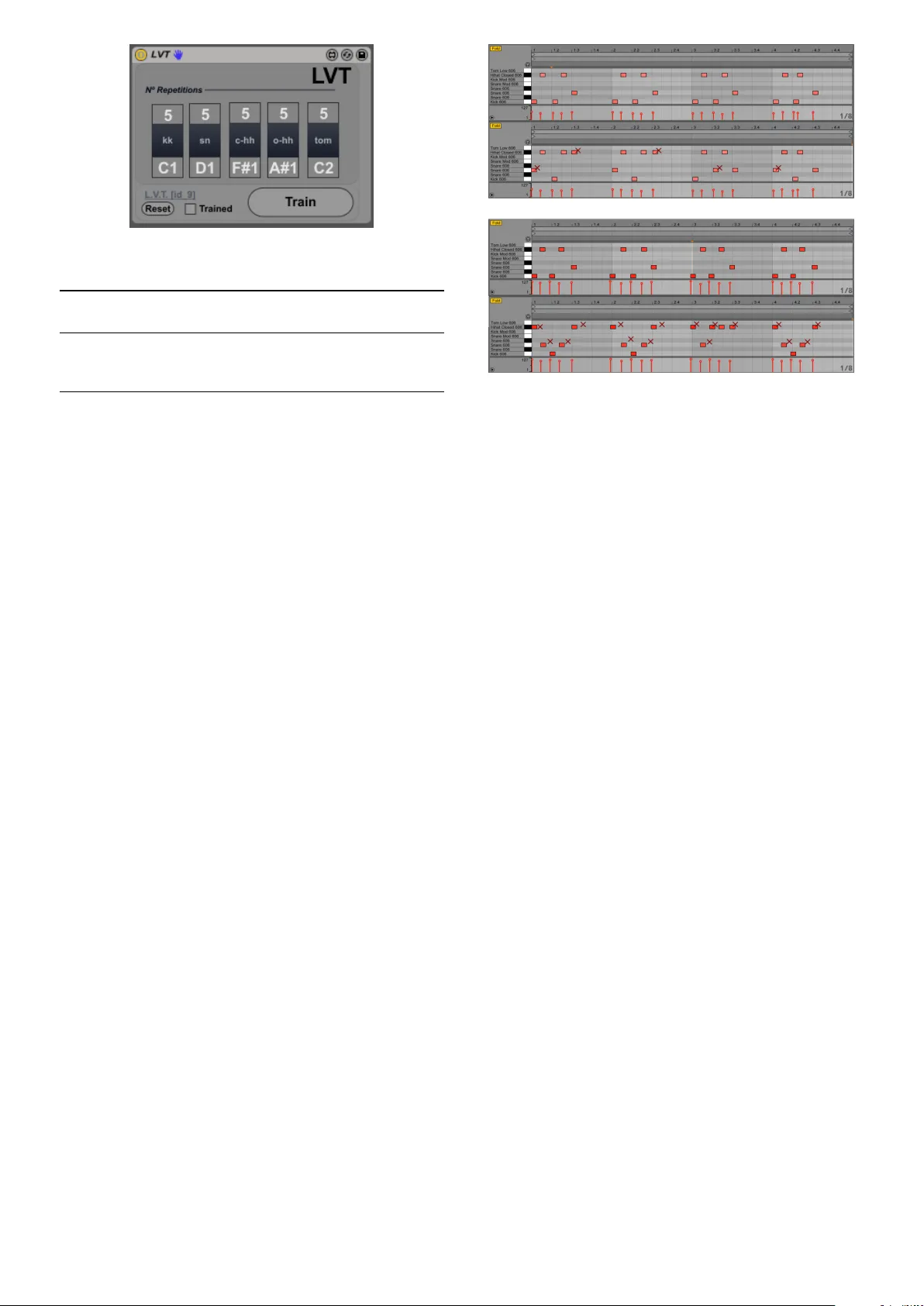

본 논문은 사용자가 자신의 목소리로 드럼 패턴을 입력할 수 있도록 Max for Live 환경에 구현된 LVT(Live Vocalised Transcription) 시스템을 제안한다. LVT는 onset 검출, 실시간 특징 추출, k‑NN 분류기의 3단계 구조로 이루어지며, 사용자가 직접 녹음한 음성 타악기 샘플을 기반으로 순차 전진 선택(SFS) 알고리즘을 통해 최적 특징을 선택한다. 사용자별 학습을 적용함으로써 기존 드럼 전사 알고리즘보다 …

저자: Antonio Ramires, Rui Penha, Matthew E. P. Davies

본 논문은 디지털 오디오 워크스테이션(DAW) 환경에서 사용자가 목소리만으로 드럼 패턴을 입력할 수 있도록 돕는 시스템, LVT(Live Vocalised Transcription)를 제안한다. 연구 배경으로는 기존 드럼 전사 알고리즘이 녹음된 실제 드럼 사운드에 최적화돼 있어, 비전문가가 보컬로 입력한 타악기 소리를 정확히 인식하기 어렵다는 점을 들었다. 이를 해결하기 위해 저자들은 사용자 맞춤형 학습 방식을 채택하고, Max for Live 플랫폼에 통합된 플러그인 형태로 구현하였다.

시스템 구조는 세 가지 핵심 모듈로 구성된다. 첫 번째는 Aubio 기반의 onset detector로, 음성 타악기의 시작점을 실시간으로 감지한다. 두 번째는 특징 추출 모듈로, Max 객체 Zsa.mfcc를 이용해 MFCC를, Zsa.descriptors를 통해 스펙트럼 중심, 스프레드, 슬로프, 감소, 롤오프 등을 추출하고, zerox 객체로 제로 크로싱 비율을 계산한다. 총 12개의 특징이 실시간으로 생성된다. 세 번째는 기계 학습 모듈로, timbreID 외부 객체를 이용한 k‑Nearest Neighbours(k‑NN) 분류기를 사용한다. 여기서 중요한 점은 Sequential Forward Selection(SFS) 알고리즘을 통해 사용자가 제공한 음성 샘플 집합에 가장 적합한 특징 조합을 자동으로 선택한다는 것이다. SFS는 초기 빈 집합에서 시작해, 현재 집합에 추가했을 때 분류 정확도가 가장 크게 향상되는 특징을 하나씩 더한다. 이 과정은 학습 단계에서만 수행되며, 최종 전사 단계에서는 선택된 소수의 특징만 사용해 연산 효율성을 확보한다.

데이터 수집은 20명의 참가자를 대상으로 진행되었다. 각 참가자는 동일한 기본 패턴과 즉흥 패턴을 세 가지 마이크(노트북 내장, iPad, 스튜디오 AKG c4000b)로 녹음했으며, Sonic Visualiser를 이용해 수동으로 온셋을 라벨링하였다. 참가자들의 비트박싱 경험은 전문가부터 초보자까지 다양했으며, 이는 시스템이 광범위한 사용자층에 적용 가능함을 보여준다.

성능 평가는 두 가지 측면에서 이루어졌다. 첫째는 전사 정확도이며, 이는 F‑measure로 측정했다. 둘째는 작업 흐름 효율성으로, 자동 전사 결과를 원하는 패턴으로 맞추기 위해 필요한 편집 작업(Modify, Add, Remove)의 수를 카운트했다. 비교 대상은 기존 오픈소스 드럼 전사 시스템 LDT와 Ableton Live 내장 “Convert Drums to MIDI” 기능이다.

실험 결과, 스튜디오 마이크를 사용한 경우 LVT는 킥(0.914), 스네어(0.691), 하이햇(0.802)의 평균 F‑measure에서 기존 시스템을 크게 앞섰다. 편집 작업 수 역시 LVT가 39, 7, 15번으로 LDT(52, 24, 206)와 Ableton(33, 12, 296)에 비해 현저히 적었다. 이는 LVT가 자동 전사 결과를 거의 그대로 사용할 수 있음을 의미한다. 교차 사용자 실험에서는 한 사용자의 모델을 다른 사용자에게 적용했을 때 정확도가 급격히 떨어지는 현상이 관찰되었으며, 이는 개인별 발음 차이가 크기 때문에 사용자 맞춤형 학습이 필수적임을 강조한다. 또한 LVT는 현재 단일 폴리포닉 이벤트만을 처리하도록 설계돼 있어, 다중 타악기 동시 입력을 지원하지 않는다. 이는 기존 시스템이 다중 이벤트를 과다 검출해 false positive가 늘어나는 현상과 대비된다.

논문의 결론은 LVT가 Max for Live 환경에 자연스럽게 통합돼, 사용자가 자신의 목소리로 만든 퍼커션을 실시간으로 MIDI 시퀀스로 변환함으로써 작업 흐름을 크게 단순화한다는 점이다. 사용자 맞춤형 특징 선택과 k‑NN 기반 분류기가 기존 시스템보다 높은 정확도와 적은 편집 작업을 제공한다. 저자들은 향후 다중 폴리포닉 이벤트 처리, 신경망 기반 분류기 도입, 실시간 적응형 학습 메커니즘 등을 연구 과제로 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기