다중채널 자동인코더 기반 음성 감정 인식

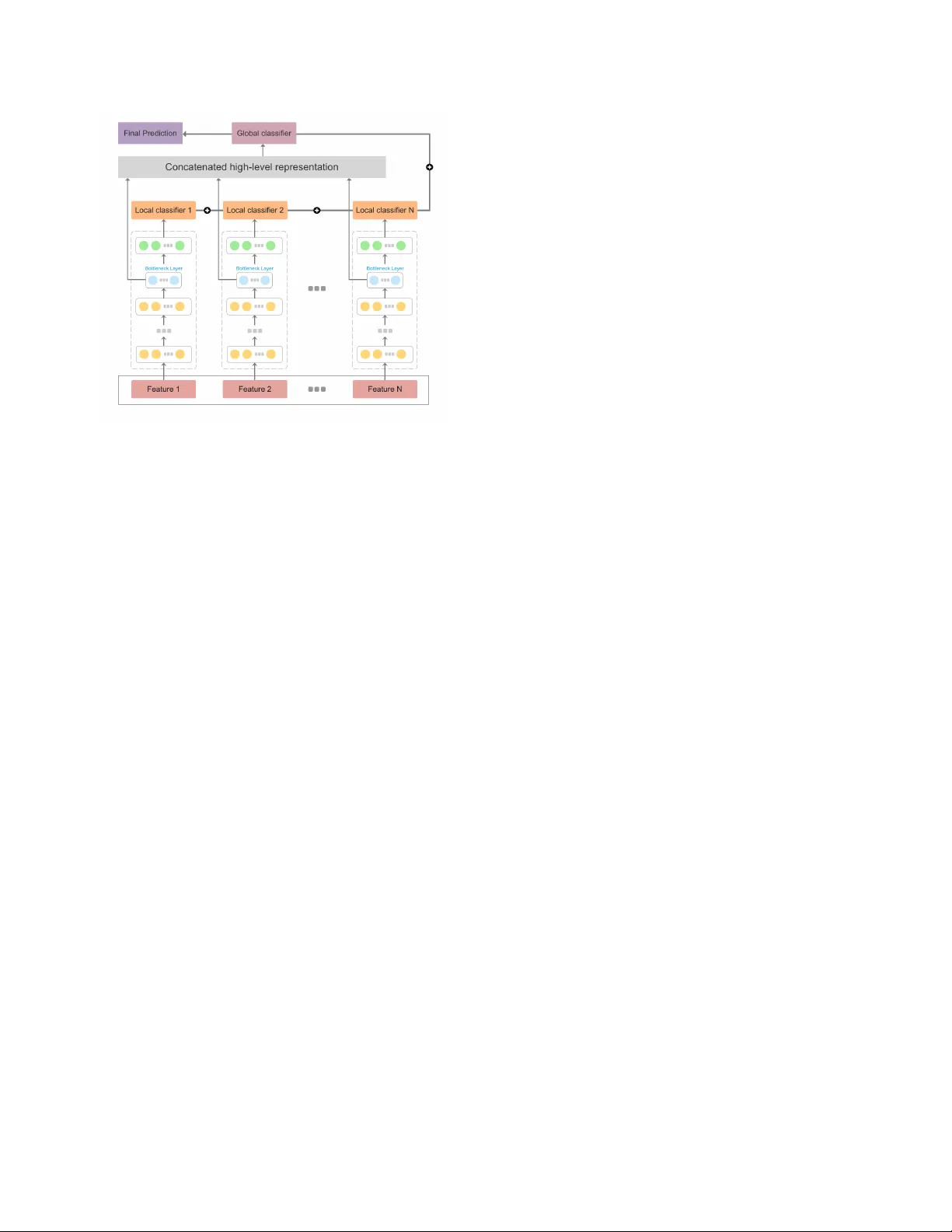

본 논문은 음성 감정 인식을 위해 서로 다른 저수준 특징(LLD)별로 독립적인 로컬 DNN을 구성하고, 각 네트워크의 bottleneck 출력을 결합해 전역 분류기를 학습하는 다중채널 자동인코더(MTC‑AE) 구조를 제안한다. 각 로컬 DNN는 스택드 디노이징 오토인코더(SDAE)로 사전학습되어 잡음에 강인하며, 전역 및 로컬 손실을 하나의 목적함수로 동시에 최적화한다. IEMOCAP 데이터셋에서 10‑fold LOSO 교차검증을 수행했을 때,…

저자: Zefang Zong, Hao Li, Qi Wang

**1. 서론 및 배경**

음성 기반 대화 시스템에서 사용자의 감정을 파악하는 것은 대화의 자연스러움과 효율성을 크게 향상시킨다. 기존 연구는 HMM‑GMM, SVM 기반 고수준 특징, 그리고 최근의 딥러닝 기반 접근법으로 크게 두 갈래로 나뉜다. 특히, 저수준 기술적 특징(LLD)을 직접 활용하거나 프레임‑레벨·원시 신호를 입력으로 하는 end‑to‑end 모델이 제안되었지만, (1) 모든 LLD를 단순히 연결해 고차원 입력으로 사용하는 경우 독립적인 특성 정보를 손실하고, (2) 데이터 양이 제한적인 상황에서 과적합 위험이 높아지는 문제가 있다.

**2. 제안 방법: 다중채널 자동인코더(MTC‑AE)**

본 논문은 위 문제를 해결하기 위해 두 단계의 설계를 도입한다.

- **2.1 로컬 DNN 및 SDAE 사전학습**: 38개의 LLD 각각에 대해 독립적인 로컬 DNN을 구성한다. 각 로컬 DNN는 두 층의 스택드 디노이징 오토인코더(SDAE)로 사전학습되며, 입력의 20%를 마스킹 노이즈로 변형해 원본 복원을 목표로 한다. ELU 활성화와 L2 정규화(β=10⁻⁴)를 적용해 학습 안정성을 확보한다. 사전학습이 끝난 뒤에는 bottleneck(30유닛) → 은닉층(100유닛) → 소프트맥스 분류층을 추가해 최종 로컬 분류기를 만든다.

- **2.2 전역 분류기와 특성 결합**: 모든 로컬 DNN의 bottleneck 출력을 단순히 연결해 1140 차원의 전역 특성 벡터를 만든다. 전역 분류기는 이 벡터를 입력으로 받아 은닉층(1000유닛)과 소프트맥스 레이어를 통해 감정 클래스를 예측한다.

- **2.3 공동 손실 함수**: 전역 손실과 로컬 손실을 가중합(λ)으로 결합한 단일 목적함수

L = λ·H(p, q_g) + (1‑λ)·∑_{i=1}^{N} H(p, q_{l,i})

를 사용해 전역 및 로컬 파라미터를 동시에 최적화한다. 여기서 H는 교차 엔트로피, λ는 0.1로 설정해 전역 손실에 약간 더 큰 비중을 둔다.

- **2.4 예측 단계의 앙상블**: 전역 분류기와 로컬 분류기의 출력 확률을 가중 평균(γ=0.95)으로 결합해 최종 예측을 만든다. 이는 전역 모델의 판단을 주로 따르면서도 로컬 모델이 제공하는 보완 정보를 활용한다.

**3. 실험 설정**

- **데이터셋**: IEMOCAP의 10명 화자를 대상으로 4가지 감정(행복, 분노, 슬픔, 중립)만을 사용해 실험을 진행했다. 총 5,531개의 발화가 포함된다.

- **특징 추출**: openSMILE을 이용해 38개의 LLD와 21개의 통계 함수를 결합, 1,582 차원의 고수준 특징을 만든 뒤 각 로컬 DNN에 38 차원만 입력한다.

- **네트워크 파라미터**: 각 로컬 DNN의 SDAE는 400‑400 유닛을 갖는 두 층으로 구성되고, bottleneck은 30유닛, 이후 은닉층은 100유닛이다. 전역 분류기의 은닉층은 1,000유닛으로 설정했다. 최적화는 Adam(learning rate=3e‑4)으로 1,000 epoch까지 진행했으며, 배치 크기는 64이다.

- **평가 방법**: 10‑fold LOSO(Leave‑One‑Speaker‑Out) 교차검증을 사용했으며, 클래스 불균형을 고려해 비가중 정확도(Unweighted Accuracy, UA)를 주요 지표로 삼았다.

**4. 결과 및 분석**

| 모델 | UA (%) |

|------|--------|

| Ensemble of SVM Trees (2012) | 60.9 |

| Replicated Softmax + SVM (2014) | 57.4 |

| CNN Feature + MKL (2016) | 61.3 |

| Contextual LSTM (2017) | 57.1 |

| Attention‑based RNN (2017) | 58.8 |

| Deep Multi‑layered NN (2017) | 60.9 |

| Multi‑task DBN + SVM (2017) | 62.4 |

| **MTC‑DNN (no SDAE)** | 62.7 |

| **MTC‑AE (with SDAE)** | **64.8** |

MTC‑AE는 기존 최고 성능(62.4%)보다 2.4%p 상승한 64.8% UA를 기록했다. SDAE를 사용하지 않은 MTC‑DNN도 62.7%로 기존 최첨단 수준에 근접했지만, 사전학습을 통해 잡음 감소와 수렴 속도 향상이 성능 차이를 만든 것으로 해석된다. 또한, 로컬‑전역 공동 학습이 과적합을 억제하고, 각 LLD의 독립적인 정보를 유지하면서도 전역 특성으로 통합하는 효과가 입증되었다.

**5. 논의 및 한계**

- **장점**: (1) 고차원 전체 특징을 한 번에 입력하지 않아 차원 폭발을 방지, (2) 각 LLD별 특성을 독립적으로 학습해 정보 손실 최소화, (3) 전역‑로컬 손실을 동시에 최적화해 시스템 일관성 확보, (4) SDAE 사전학습을 통한 잡음 강인성.

- **제한점**: 로컬 DNN가 38개라 파라미터 수가 급증해 학습 비용이 높으며, GPU 메모리 요구량이 크다. 또한, 음성만을 사용했기 때문에 멀티모달(텍스트·영상) 환경에서의 일반화 능력은 검증되지 않았다.

**6. 결론**

본 연구는 다중채널 자동인코더(MTC‑AE)라는 새로운 프레임워크를 제안하여, 로컬 DNN와 전역 DNN를 결합함으로써 음성 감정 인식에서 기존 최고 성능을 크게 뛰어넘는 결과를 얻었다. 독립적인 로컬 특성 학습과 전역 특성 통합을 동시에 수행함으로써 과적합을 억제하고, SDAE 기반 사전학습이 잡음에 강인한 표현을 제공한다는 점을 확인했다. 향후 연구에서는 파라미터 공유·경량화 기법을 도입해 효율성을 높이고, 텍스트·영상 등 다른 모달리티와의 융합을 통해 더욱 강력한 감정 인식 시스템을 구축할 수 있을 것으로 기대한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기