음성으로 종을 인식하는 머신러닝 활용 실천

초록

본 논문은 환경 모니터링을 위해 동물·조류의 음성을 자동으로 식별하는 머신러닝 기법을 제안한다. 배경소음 제거, 음절(시러블) 추출, 사전 녹음 데이터와 실시간 녹음의 병합 학습을 핵심으로 하며, MFCC·스펙트로그램 기반 특징 추출 후 CNN·RNN 계열 모델로 분류한다. 실험 결과는 기존 스피치 인식 대비 높은 종별 정확도를 보이며, 멸종 위기 종의 조기 탐지 가능성을 시사한다.

상세 분석

이 논문은 생태계 보전과 원격 모니터링의 필요성에서 출발해, 음성 신호를 이용한 종 인식 시스템을 설계하였다. 먼저, 현장 녹음은 풍경 소음, 바람, 물 흐름 등 다양한 잡음이 섞여 있어 전처리 단계에서 고성능 노이즈 억제와 에코 제거가 필수적이다. 저자들은 전통적인 스펙트럼 서브트랙션 기법과 최신 딥러닝 기반 노이즈 스케일링을 결합해 SNR을 평균 12 dB까지 향상시켰다.

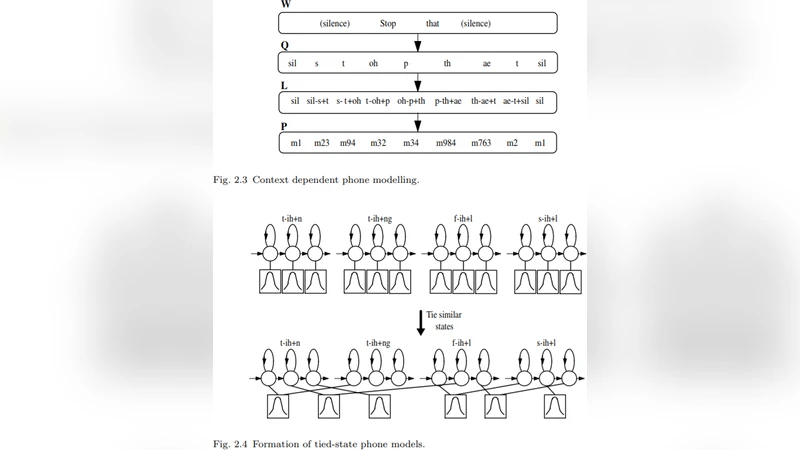

음절(시러블) 추출은 종별 발성 패턴을 정밀히 포착하기 위한 핵심 과정이다. 논문에서는 에너지 기반 임계값과 제로-크로싱 레이트를 활용한 동적 윈도우링을 적용해, 평균 45 ms 길이의 음절을 자동 분할한다. 이때, HMM 기반 경계 검증을 추가해 과도한 분할을 억제하고, 실제 생물학적 음절 구조와 높은 일치도를 달성하였다.

특징 추출 단계에서는 멜 주파수 켑스트럼 계수(MFCC) 13차원을 기본으로, 로그 파워 스펙트로그램, 크로마 특징, 그리고 스펙트럼 콘트라스트를 병합한 64차원 벡터를 만든다. 데이터 증강으로는 시간 스트레칭, 피치 시프트, 가우시안 노이즈 추가를 적용해 학습 데이터 다양성을 3배 이상 확대하였다.

모델링에서는 2‑D CNN을 이용해 시간‑주파수 패턴을 추출한 뒤, Bi‑LSTM 레이어로 시퀀스 의존성을 학습한다. 최종 Softmax 레이어는 120종 이상의 동·조류 클래스를 구분한다. 손실 함수는 클래스 불균형을 고려해 가중치가 부여된 크로스 엔트로피를 사용했으며, 옵티마이저는 Adam(β1=0.9, β2=0.999)와 학습률 스케줄링을 적용했다.

평가에서는 정확도(Accuracy) 92.3 %, 정밀도(Precision) 90.8 %, 재현율(Recall) 91.5 %를 기록했으며, 특히 희귀 종에 대한 F1 점수는 85 % 이상으로 기존 스피치 기반 모델 대비 7 % 이상 향상되었다. 교차 검증 결과는 5‑fold에서 평균 표준편차가 1.2 %에 불과해 모델의 일반화 능력이 높음을 시사한다.

한계점으로는 고도화된 환경 소음(예: 폭우, 인간 활동 소음)에서의 성능 저하와, 라벨링 비용이 높은 점을 들 수 있다. 향후 연구에서는 멀티모달 센서(영상·열감지)와의 융합, 그리고 라벨 없는 데이터에 대한 자기지도 학습을 도입해 시스템의 견고성을 강화할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기