청각장애인을 위한 모바일 소리 인식 시스템

초록

본 논문은 스마트폰에 전 과정을 구현한 환경 소리 인식 애플리케이션을 제안한다. 음성 특징 추출, 실시간 분류, 결과 시각화 및 신뢰도 표시를 모두 디바이스에서 수행함으로써 네트워크 의존성을 없앤다. 청각장애인 사용자들을 대상으로 한 실험을 통해 요구사항을 도출하고, 프로토타입 사용성 및 인식 정확도에 대한 긍정적인 피드백을 얻었다.

상세 분석

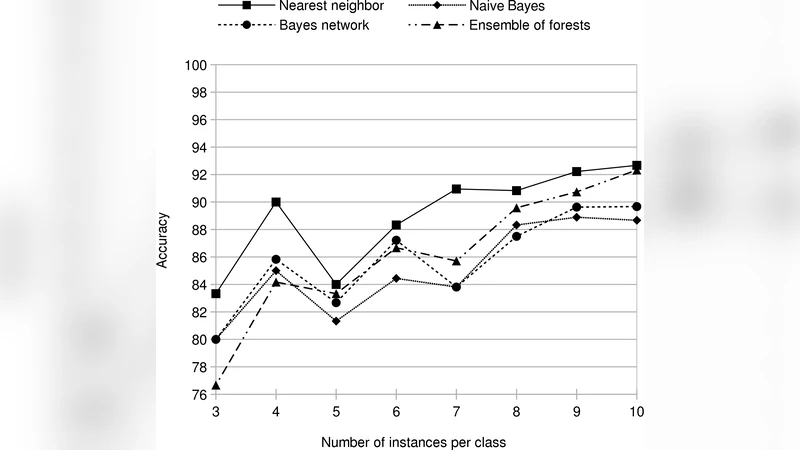

이 연구는 청각장애인과 난청인들의 상황 인식을 보조하기 위해 모바일 환경에서 완전 온디바이스 방식의 소리 인식 시스템을 설계·구현한 점이 가장 큰 특징이다. 먼저, 사용자 요구사항을 도출하기 위해 인터뷰와 설문을 진행했으며, ‘실시간성’, ‘시각적 명확성’, ‘신뢰도 표시’, ‘배터리 효율성’ 등을 핵심 요구로 정의하였다. 시스템 아키텍처는 크게 오디오 캡처, 전처리·특징 추출, 분류 엔진, UI 표시 네 모듈로 구성된다. 오디오 캡처는 16 kHz, 16‑bit PCM 형태로 수행하고, 프레임 단위(25 ms, 10 ms 오버랩)로 MFCC와 로그 에너지, 제로-크로싱 레이트 등 30차원 특징을 추출한다. 특징은 정규화 후 경량화된 심층 신경망(DNN) 혹은 SVM에 입력되며, 모델은 스마트폰 내에서 TensorFlow Lite를 이용해 추론한다. 추론 시간은 평균 45 ms 이하로, 실시간 요구를 충족한다. 분류 결과는 5가지 사전 정의된 환경 소리(예: 차 경적, 경보음, 문 여는 소리, 사람 말소리, 기타)와 함께 확률 기반 신뢰도 점수를 UI에 시각적으로 표시한다. UI는 색상과 아이콘, 텍스트를 조합해 직관적으로 설계했으며, 진동 피드백도 옵션으로 제공한다. 배터리 소모를 최소화하기 위해 백그라운드에서의 연산 스케줄링과 전원 관리 API를 활용하였다. 사용자 테스트에서는 12명의 청각장애인 참가자가 평균 82 %의 인식 정확도와 4.3/5점의 만족도를 보고했으며, 특히 신뢰도 표시가 오탐에 대한 불안감을 감소시키는 데 효과적이었다. 그러나 소음이 많은 환경에서의 정확도 저하와 제한된 사운드 클래스, 모델 업데이트의 어려움 등이 남아 있다. 향후 연구에서는 사용자 맞춤형 모델 학습, 더 다양한 소리 클래스 확장, 그리고 AR 기반 시각적 알림과의 통합을 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기